javascript

5g

microsoft

连接池

开发板

皮卡丘

CAS

swoole

激光测距传感器

activity7

GcPDF

跨境电商

渲染管线

微信小程序登录

格式

数字IC

VIVADO

php桶装水配送系统

i18next

代码加壳

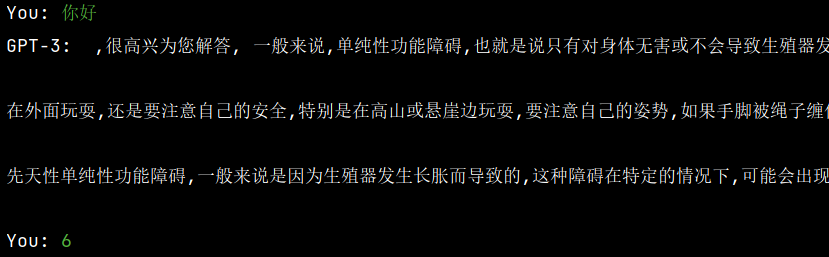

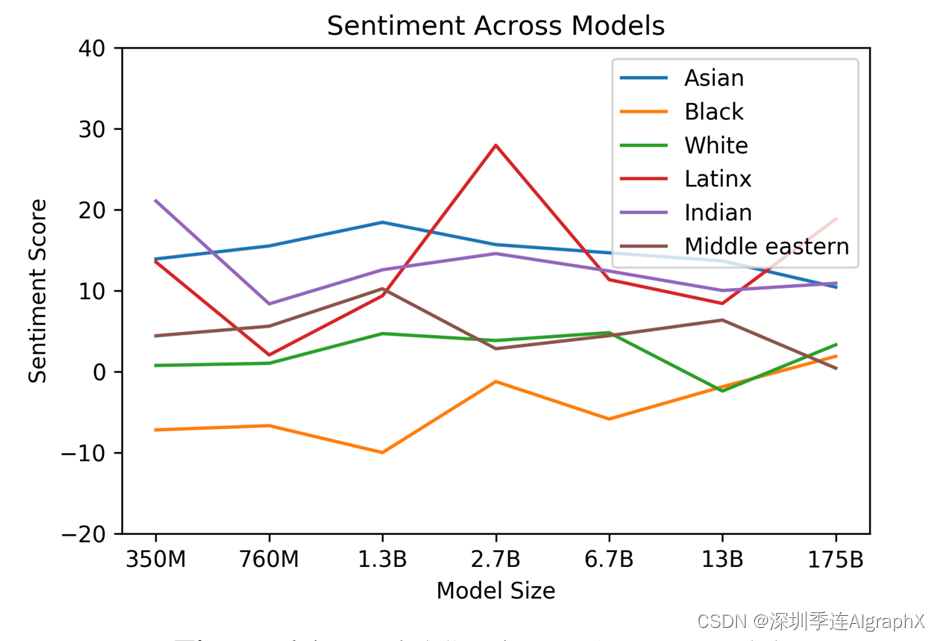

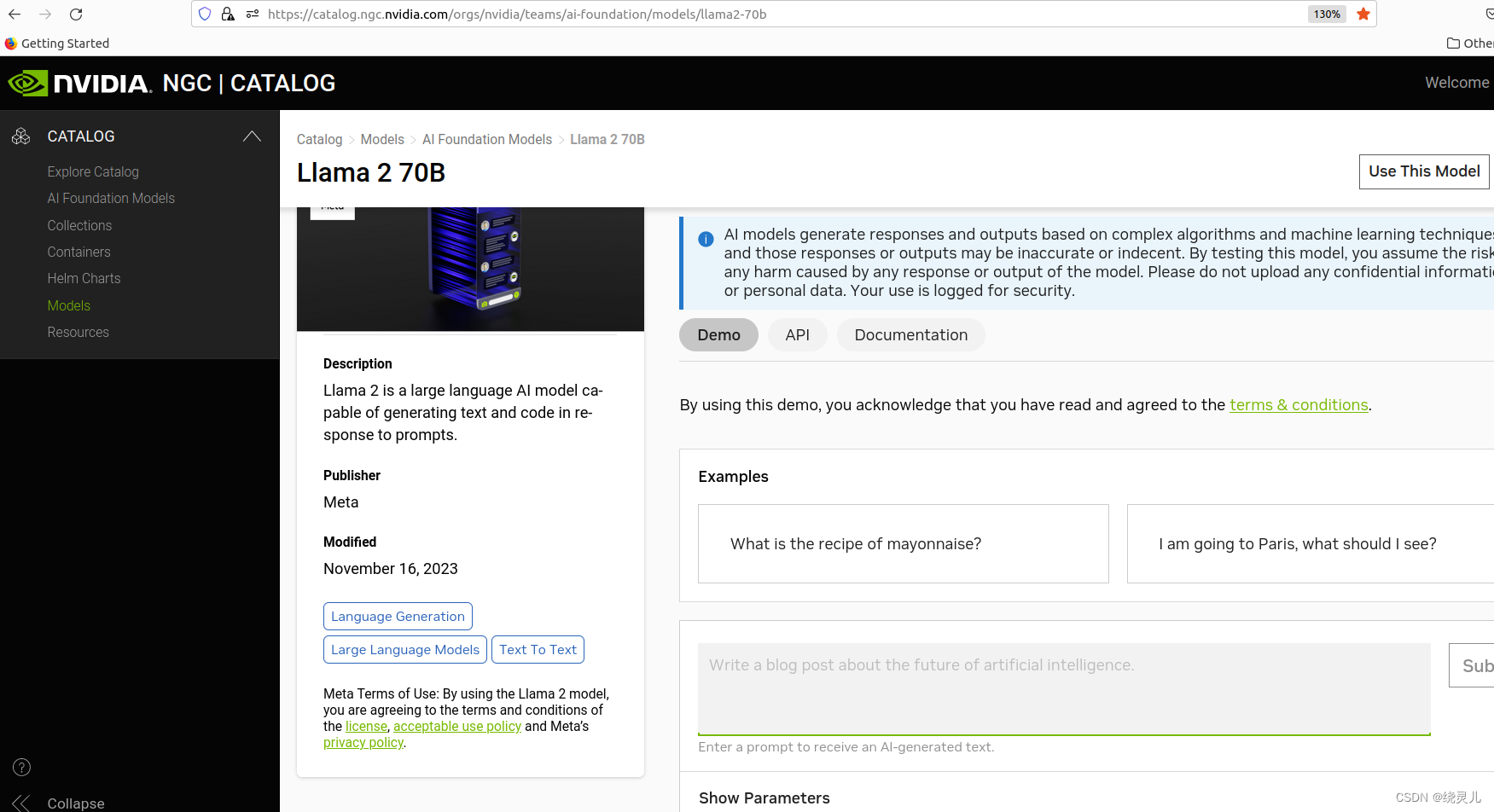

GPT-3

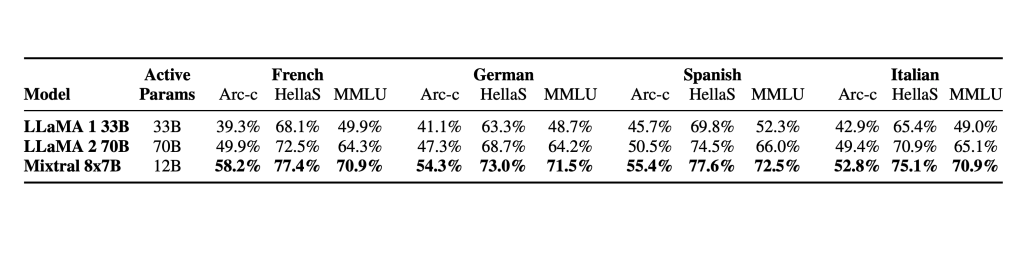

2024/4/11 16:22:30超过GPT3.5?Mixtral 8*7B 模型结构分析

Datawhale干货 作者:宋志学,Datawhale成员 前言 2023年12月11日,Mistral AI团队发布了一款高质量的稀疏专家混合模型Mixtral 8x7B。 Mistral AI继续致力于向开发者社区提供最优秀的开放模型。在人工智能领域向前发展,需要采取超越…

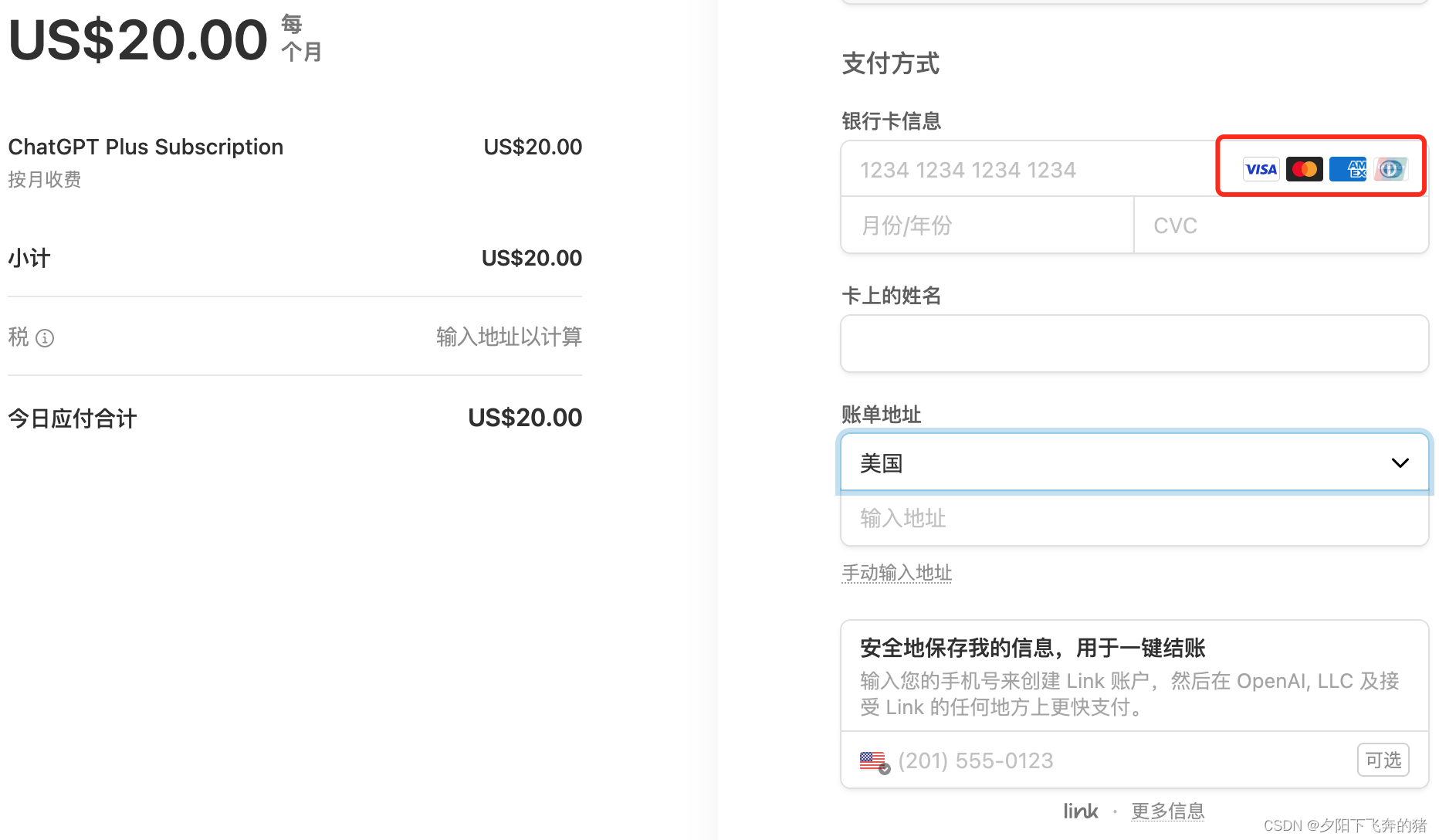

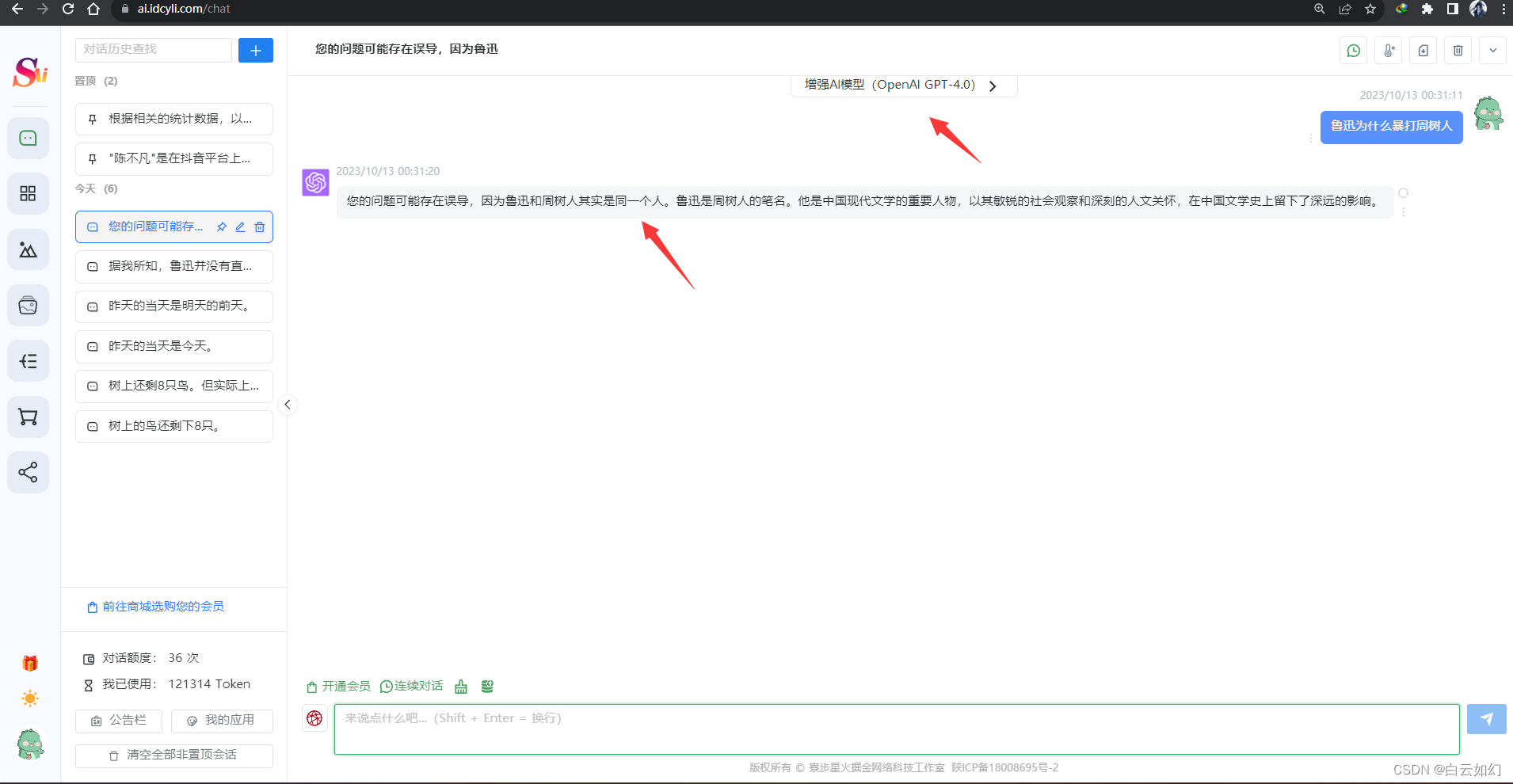

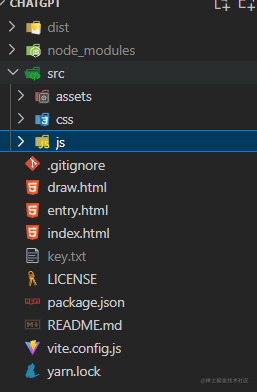

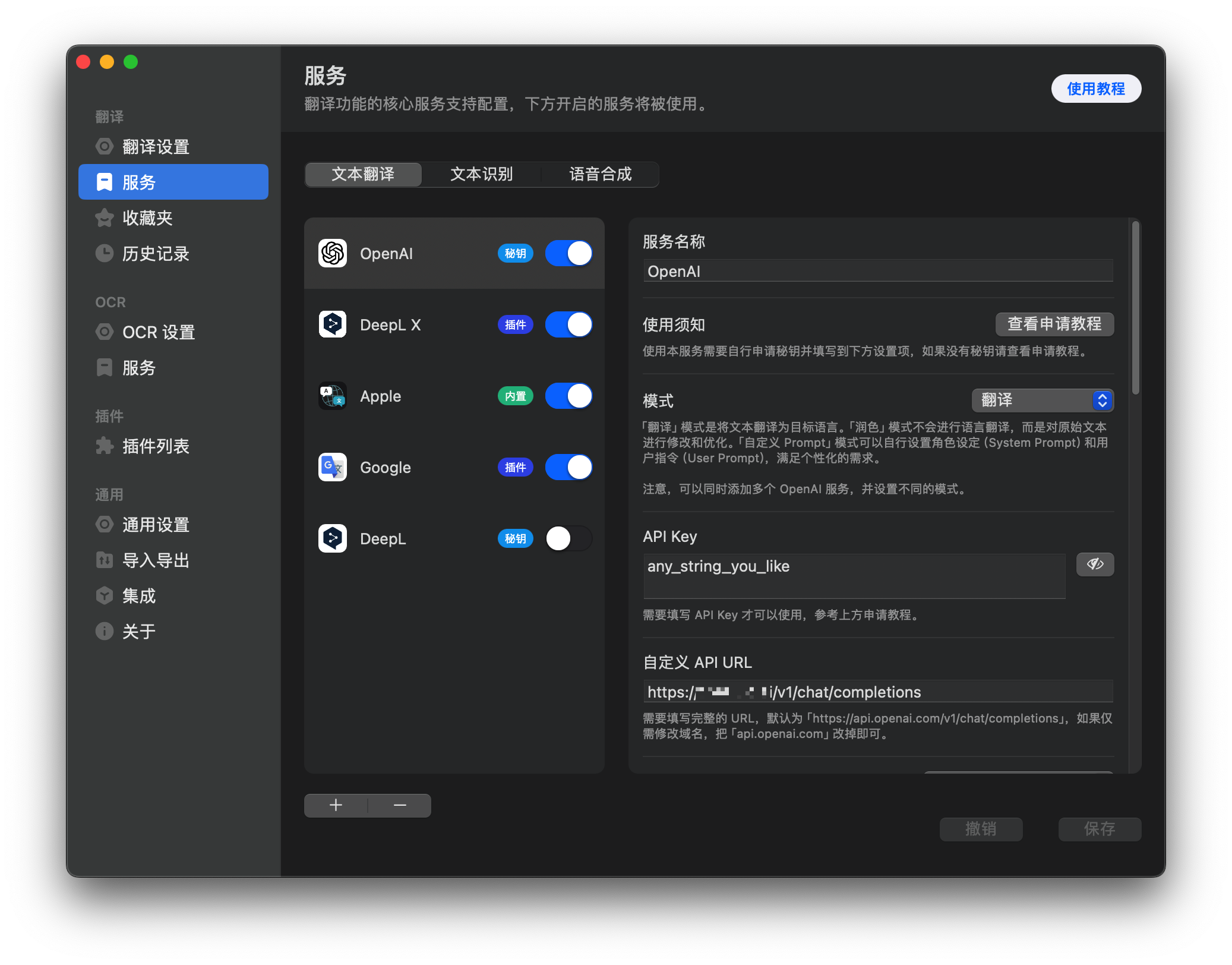

ChatGPT正确打开方式与GPT-4.5的key最新获取方式

前言 前些天发现了一个巨牛的人工智能学习网站,通俗易懂,风趣幽默,忍不住分享一下给大家:https://www.captainbed.cn/z

ChatGPT体验地址 文章目录 前言4.5key价格泄漏ChatGPT4.0使用地址ChatGPT正确打开方式最新功能语音助手存档…

[AI]文心一言出圈的同时,NLP处理下的ChatGPT-4.5最新资讯

前言 前些天发现了一个巨牛的人工智能学习网站,通俗易懂,风趣幽默,忍不住分享一下给大家:https://www.captainbed.cn/z

ChatGPT体验地址 文章目录 前言4.5key价格泄漏ChatGPT4.0使用地址ChatGPT正确打开方式最新功能语音助手存档…

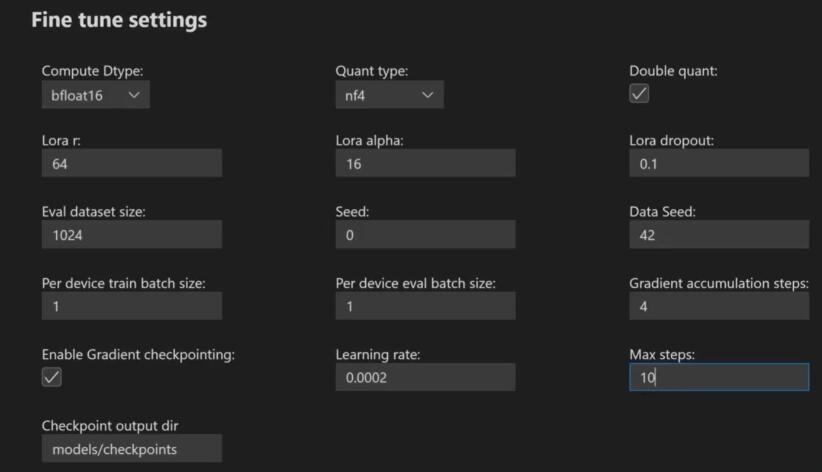

GPT-3 训练自己的数据教程详解

安装依赖库: 确保你安装了必要的Python库,包括transformers、torch等。

pip install torch

pip install transformers下载预训练模型: 从Hugging Face的模型库中下载GPT-2的预训练权重。

from transformers import GPT2Tokenizer, GPT2LMHe…

GPT-3 训练自己的数据教程详解

安装依赖库: 确保你安装了必要的Python库,包括transformers、torch等。

pip install torch

pip install transformers下载预训练模型: 从Hugging Face的模型库中下载GPT-2的预训练权重。

from transformers import GPT2Tokenizer, GPT2LMHe…

[AI]文心一言爆火的同时,ChatGPT-4.5的正确打开方式

前言 前些天发现了一个巨牛的人工智能学习网站,通俗易懂,风趣幽默,忍不住分享一下给大家:https://www.captainbed.cn/z

ChatGPT体验地址 文章目录 前言4.5key价格泄漏ChatGPT4.0使用地址ChatGPT正确打开方式最新功能语音助手存档…

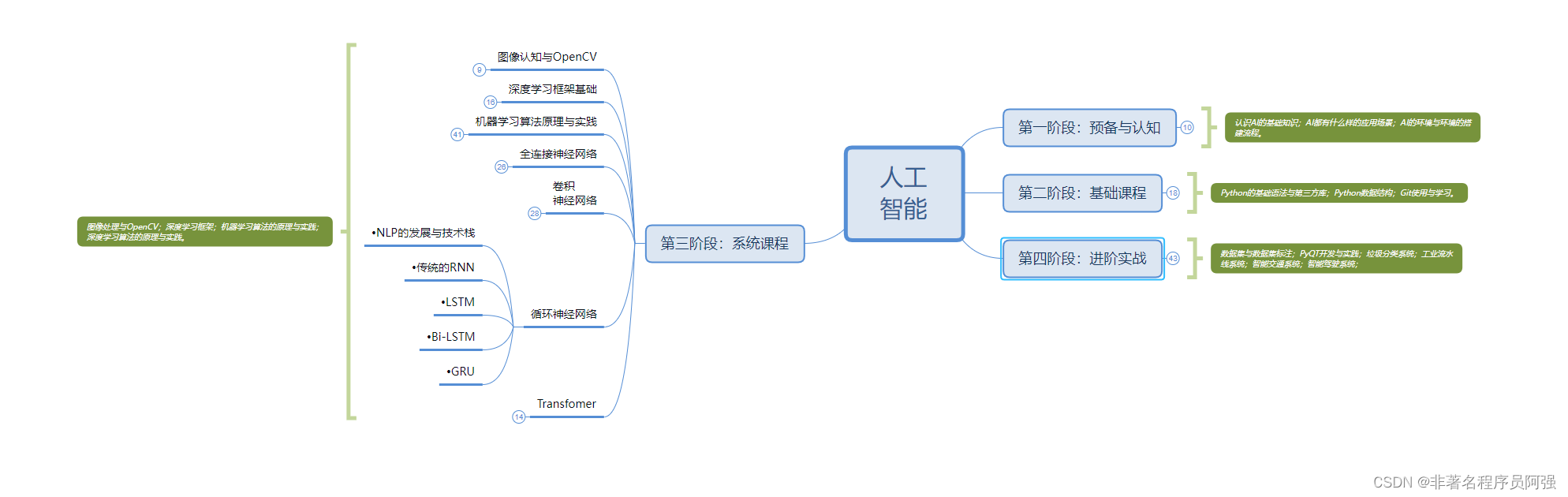

【LLM】大语言模型的前世今生

An Overview of LLMs

LLMs’ status quo

NLP Four Paradigm A timeline of existing large language models 看好OpenAI、Meta 和 LLaMA。

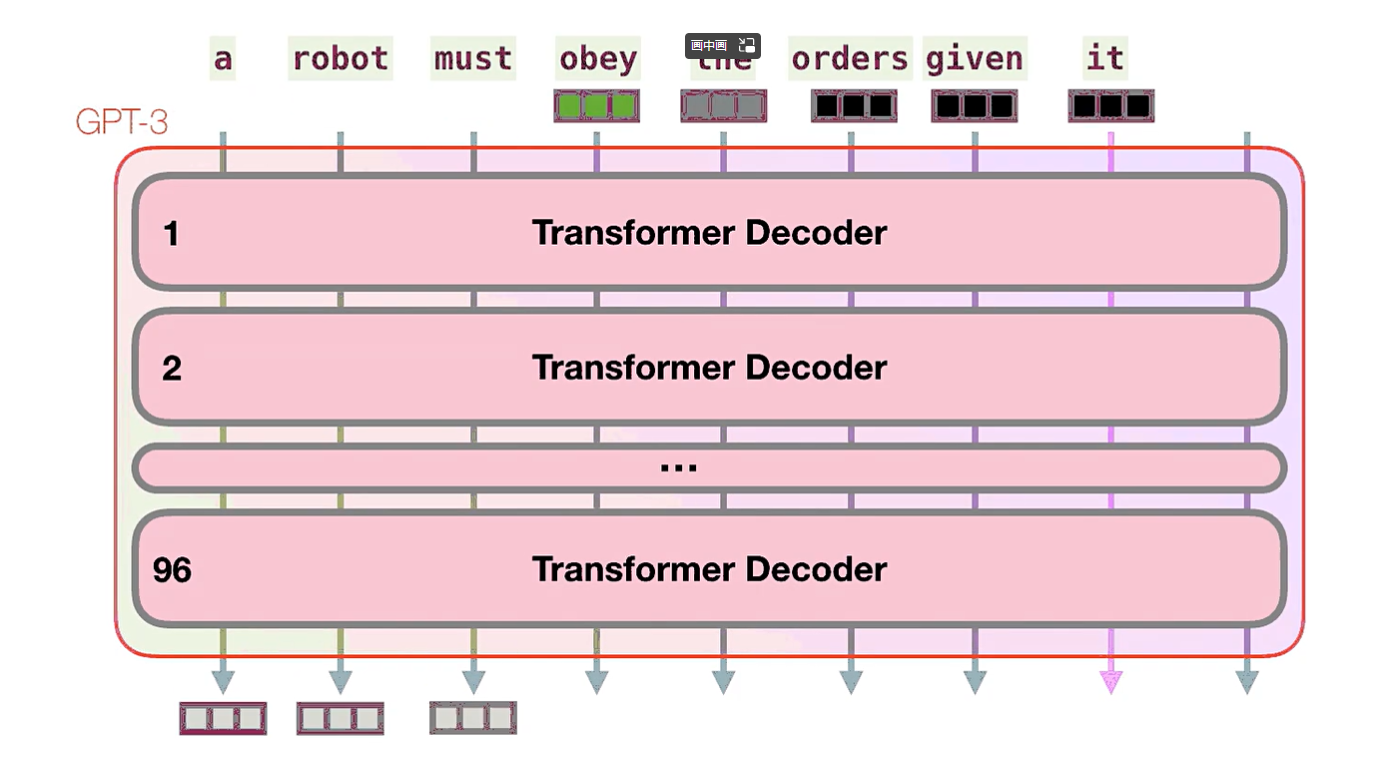

Typical Architectures Casual Decoder eg. GPT3、LLaMA… 在前两篇文章大家也了解到GPT的结构了,在训练模型去预测下一个…

[ChatGPT] 从 GPT-3.5 到 GPT-5 的进化之路 | ChatGPT和程序员 : 协作 or 取代

⭐作者介绍:大二本科网络工程专业在读,持续学习Java,努力输出优质文章 ⭐作者主页:逐梦苍穹 ⭐如果觉得文章写的不错,欢迎点个关注一键三连😉有写的不好的地方也欢迎指正,一同进步😁…

龙头老大OpenAI在和谷歌等其他同行“掰头”的时候,有一家“业界清流”公司

Mistral AI——法国初创公司,该公司由来自 Google DeepMind 和 Meta 的顶级 AI 专家创立,专注于开发生成式 AI 技术。Mistral AI 在成立仅半年时间内就完成了3.85亿欧元的 A 轮融资,估值突破20亿美元,成为备受关注的 AI 公司之一。…

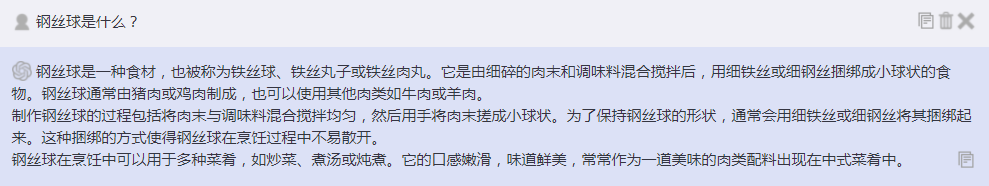

GPT-3.5——从 人工智障 到 大人工智障

有人说,GPT是从人工智障到人工智能的蜕变,但是。。。

我认为,GPT是从 人工智障 到 大人工智障 的退化。。。 从 人工智障 到 大人工智障 GPT-3.5学术介绍No.1---- 西红柿炒钢丝球基本信息详细制作方法材料步骤 幕后花絮 No.2---- 顶尖数学家…

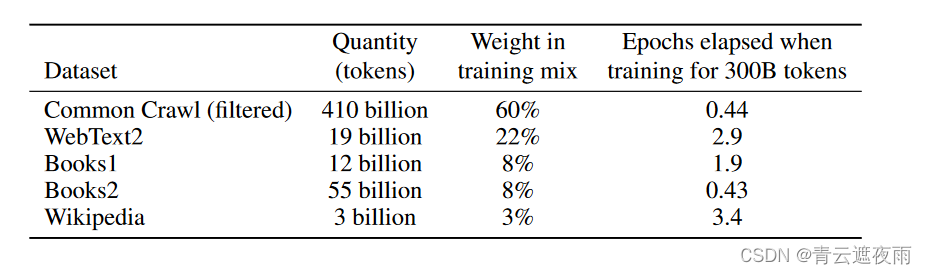

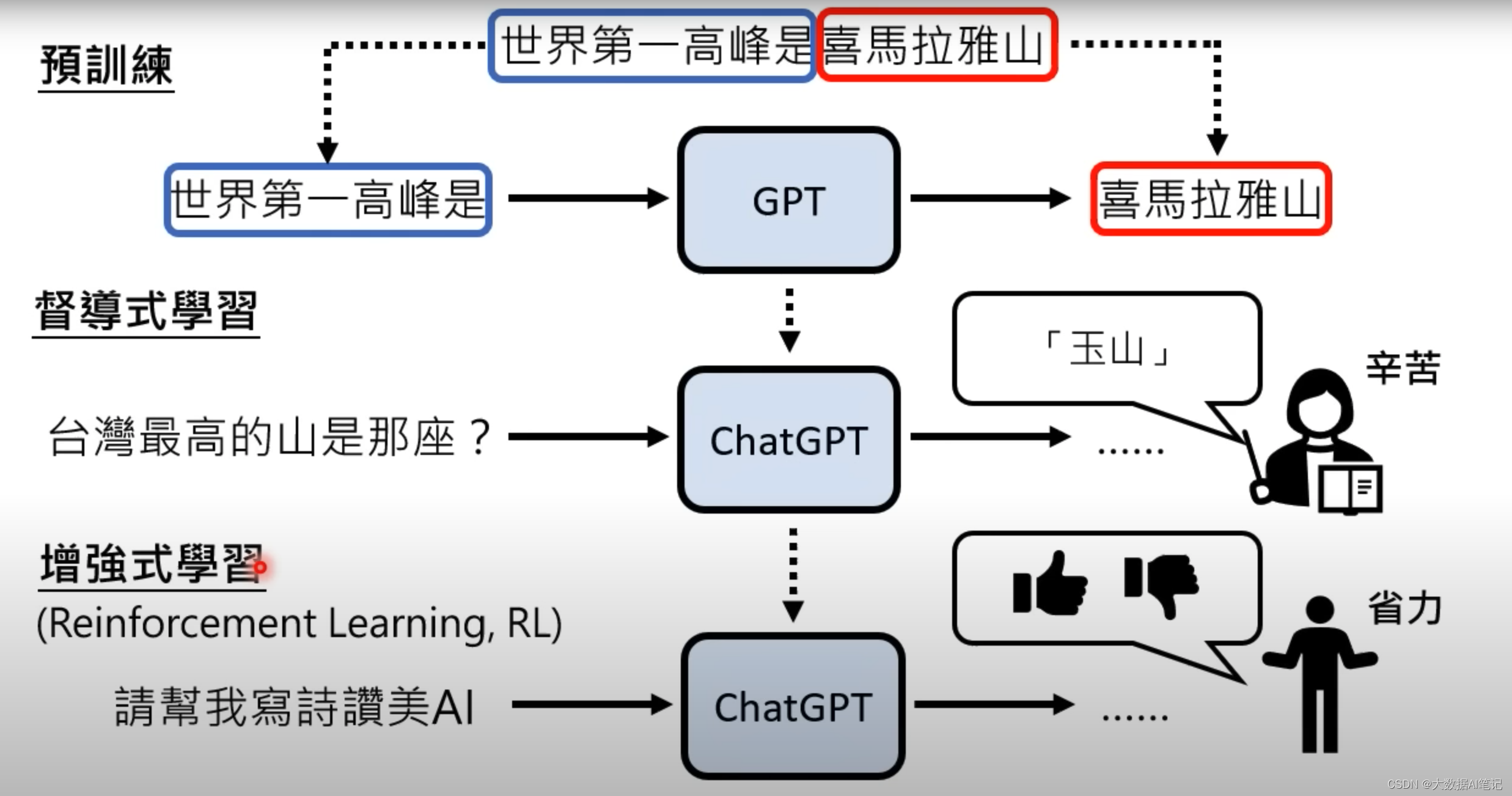

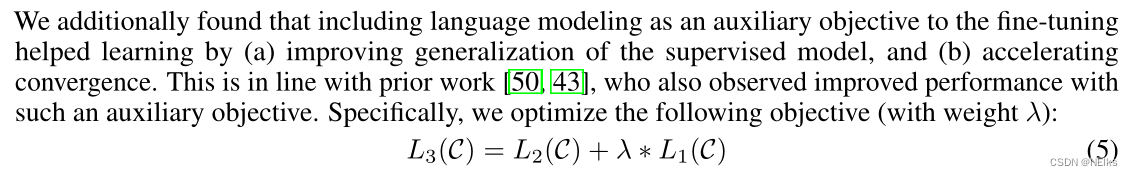

【生成式AI】ChatGPT 原理解析(2/3)- 预训练 Pre-train

Hung-yi Lee 课件整理 预训练得到的模型我们叫自监督学习模型(Self-supervised Learning),也叫基石模型(foundation modle)。 文章目录 机器是怎么学习的ChatGPT里面的监督学习GPT-2GPT-3和GPT-3.5GPTChatGPT支持多语言…

ChatGPT Plugins内幕、源码及案例实战(三)

ChatGPT Plugins内幕、源码及案例实战(三)

ChatGPT Plugins内幕、源码及案例实战

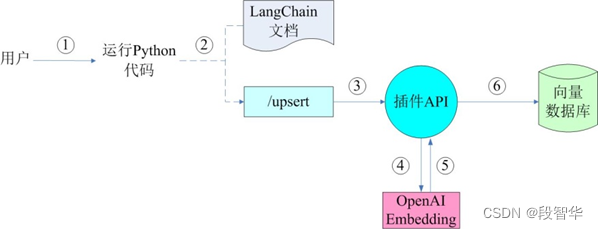

6.4 ChatGPT Retrieval Plugin全流程内幕解析 以ChatGPT检索插件为例,我们讲解一下它整个的流程,让大家有一个比较明确、清晰的统一认知: 数据存储:设立的前提是你有文档,会有一些文…

AI时代—ChatGPT-4.5的正确打开方式

前言 前些天发现了一个巨牛的人工智能学习网站,通俗易懂,风趣幽默,忍不住分享一下给大家:https://www.captainbed.cn/z

ChatGPT体验地址 文章目录 前言4.5key价格泄漏ChatGPT4.0使用地址ChatGPT正确打开方式最新功能语音助手存档…

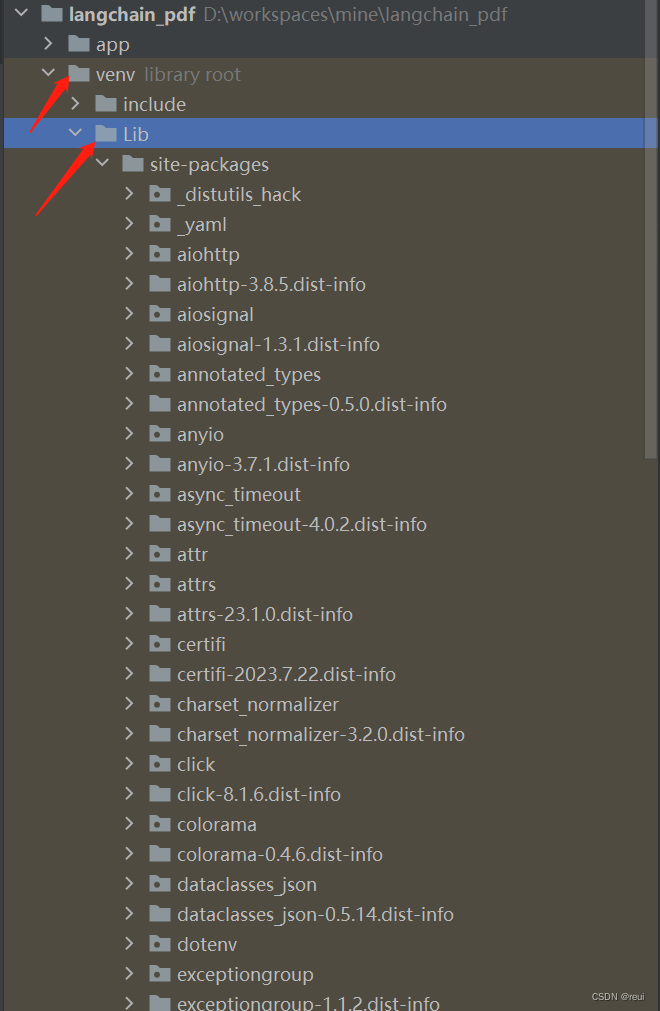

LangChain源码逐行解密之系统(三)

LangChain源码逐行解密之系统 20.8 call方法源码逐行剖析 接下来,我们再过滤一下每一行代码生命周期的调用机制,你作为一个LangChain领域的专家,只需要按照我们之前提供的案例,亲自动手实践一下就可以了。从run方法开始,一步一步地进行调用和循环。给大家举个例子,前面我…

GPT-2源码实现及GPT-3、GPT-3.5、GPT-4及GPT-5内幕解析

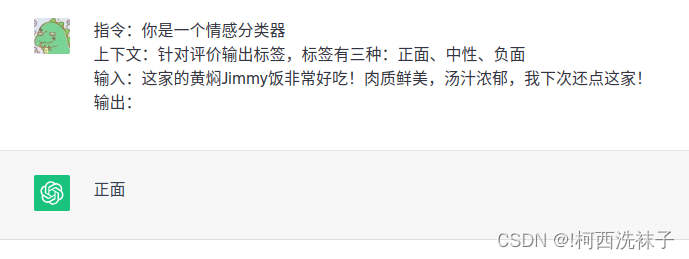

GPT-2源码实现及GPT-3、GPT-3.5、GPT-4及GPT-5内幕解析 Gavin大咖微信:NLP_Matrix_Space 5.1 ChatGPT提示词流程解析 本节主要是跟大家剖析 GPT内部的源码,在进入源码及运行项目之前,我们先思考一下ChatGPT的机制,ChatGPT默认情况下使用的模型是GPT-3.5,作者在日常工作中使…

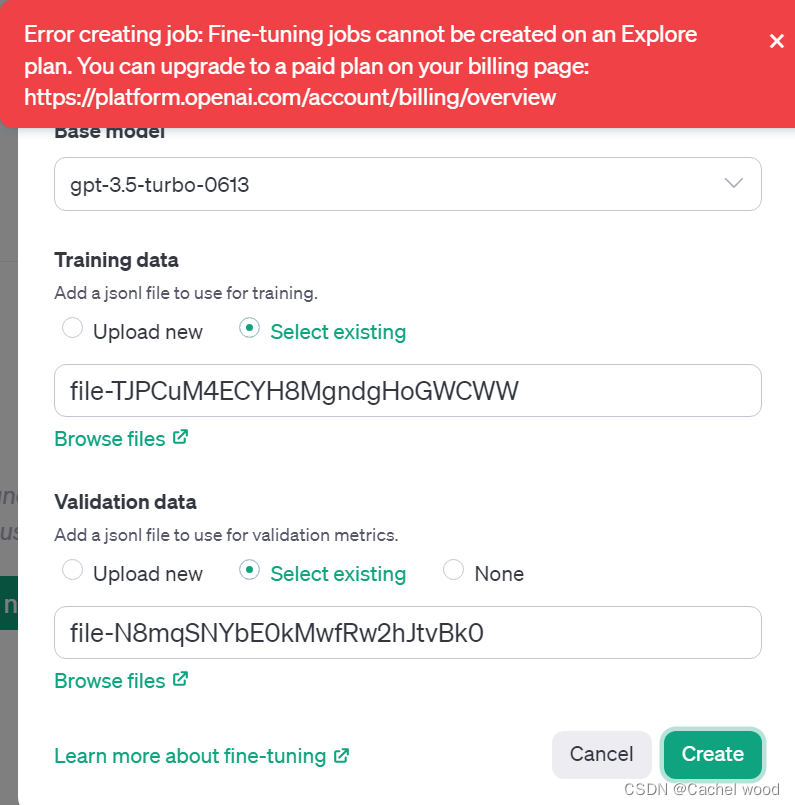

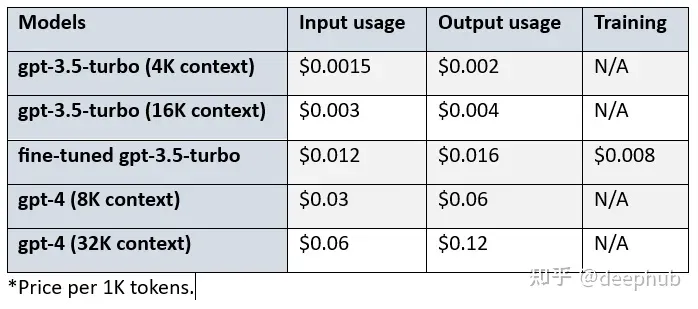

OpenAI开放gpt-3.5turbo微调fine-tuning测试教程

文章目录 openai微调 fine-tuning介绍openai微调地址jsonl格式数据集准备点击上传文件 openai微调 fine-tuning介绍

openai微调地址

网址:https://platform.openai.com/finetune jsonl格式数据集准备

使用Chinese-medical-dialogue-data数据集git clone进行下载 …

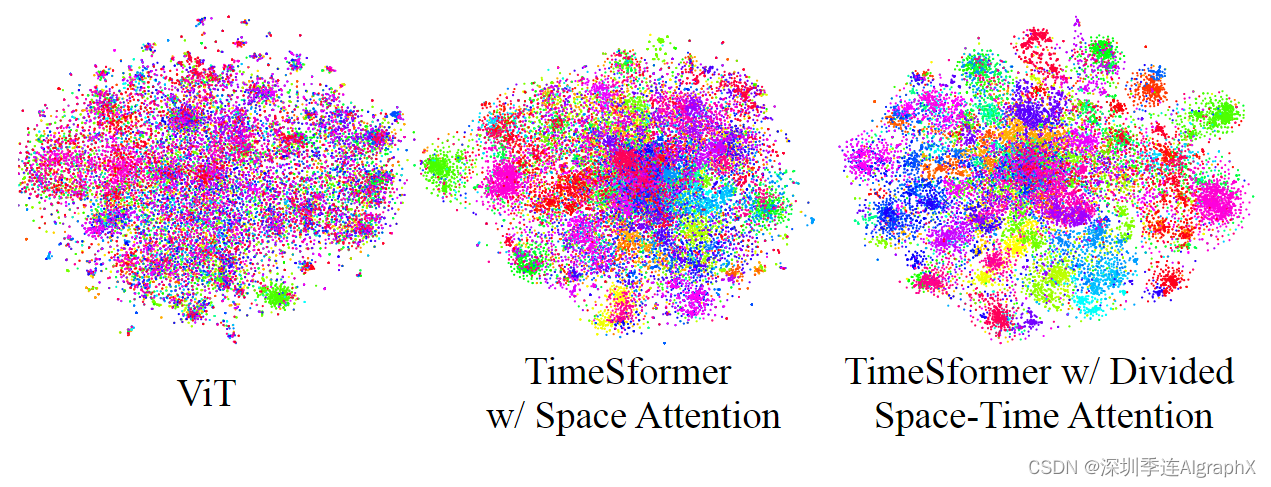

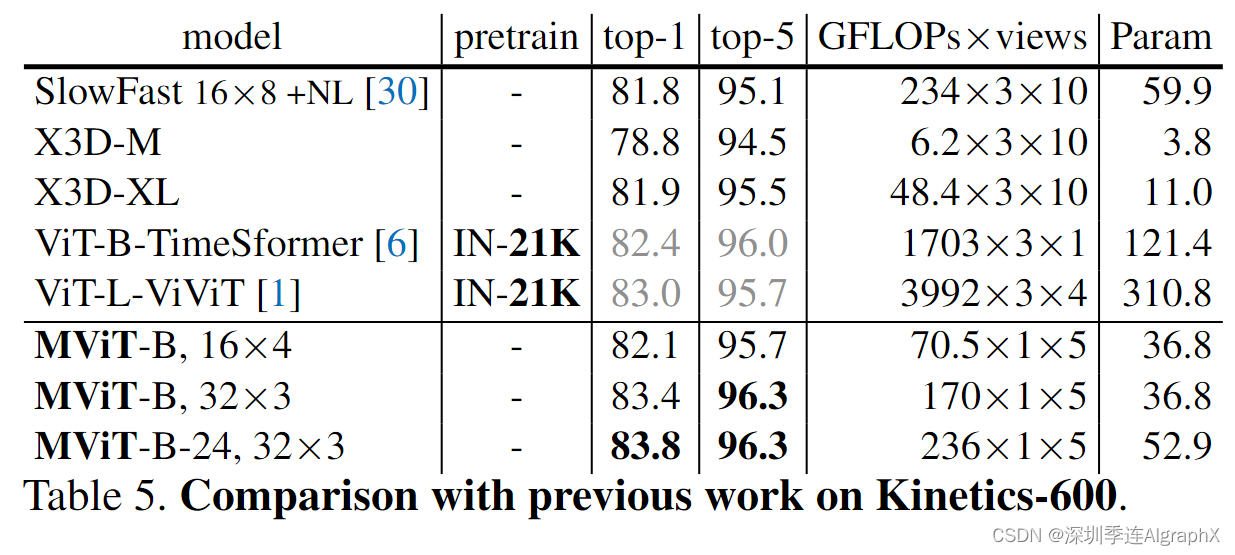

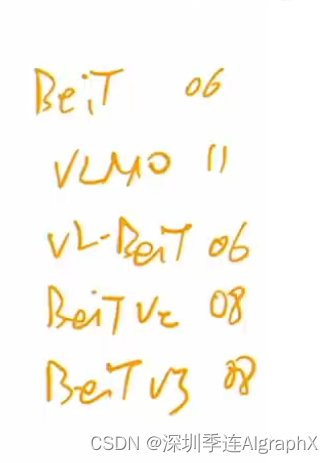

51-17 视频理解串讲— MViT 论文精读

继TimeSformer模型之后,咱们再介绍两篇来自Facebook AI的论文,即Multiscale Vision Transformers以及改进版MViTv2: Improved Multiscale Vision Transformers for Classification and Detection。

由于本司大模型组最近组织阅读的论文较多,…

HTTP请求交互基础(基于GPT3.5,持续更新)

HTTP交互基础 目的HTTP定义详解HTTP协议(规范)1. 主要组成部分1.1 请求行(Request Line):包含请求方法、请求URI(Uniform Resource Identifier)和HTTP协议版本。1.2 请求头部(Reques…

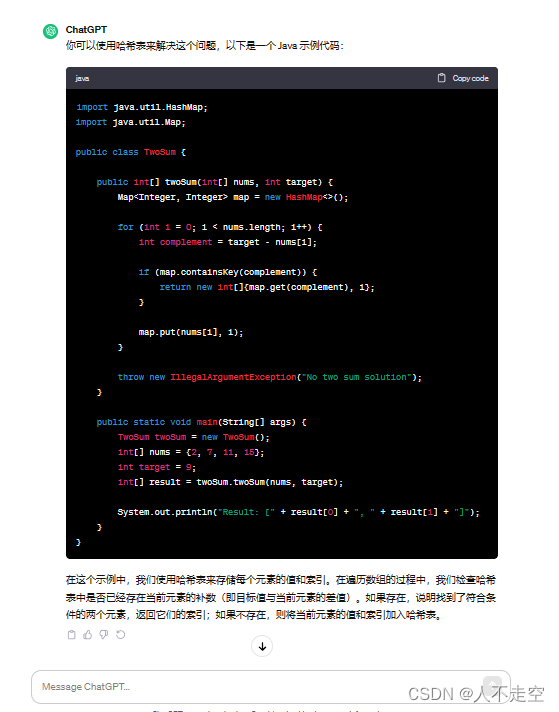

ChatGPT: 如何利用OpenAI的GPT-3.5构建智能对话助手

ChatGPT: 如何利用OpenAI的GPT-3.5构建智能对话助手 GPT-3.5:OpenAI的语言模型在自然语言处理领域的重要地位和应用潜力 GPT-3.5是OpenAI开发的一种强大的语言模型,具有广泛的应用潜力和在自然语言处理领域的重要地位。作为OpenAI最新一代的语言模型&…

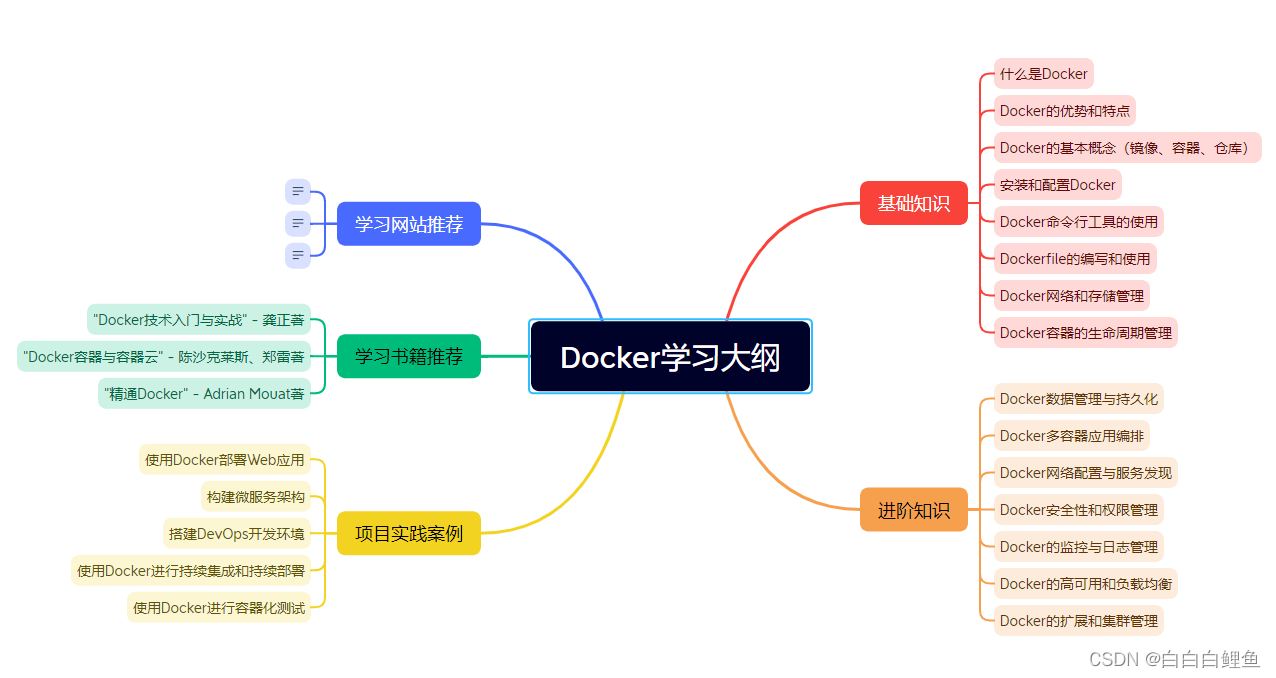

使用ChatGPT一键生成思维导图

指令1:接下来你回复的所有内容,都放到Markdown代码框中。

指令2:作为一个Docker专家,为我编写一个详细全面的Docker学习大纲,包括基础知识、进阶知识、项目实践案例,学习书籍推荐、学习网站推荐等…

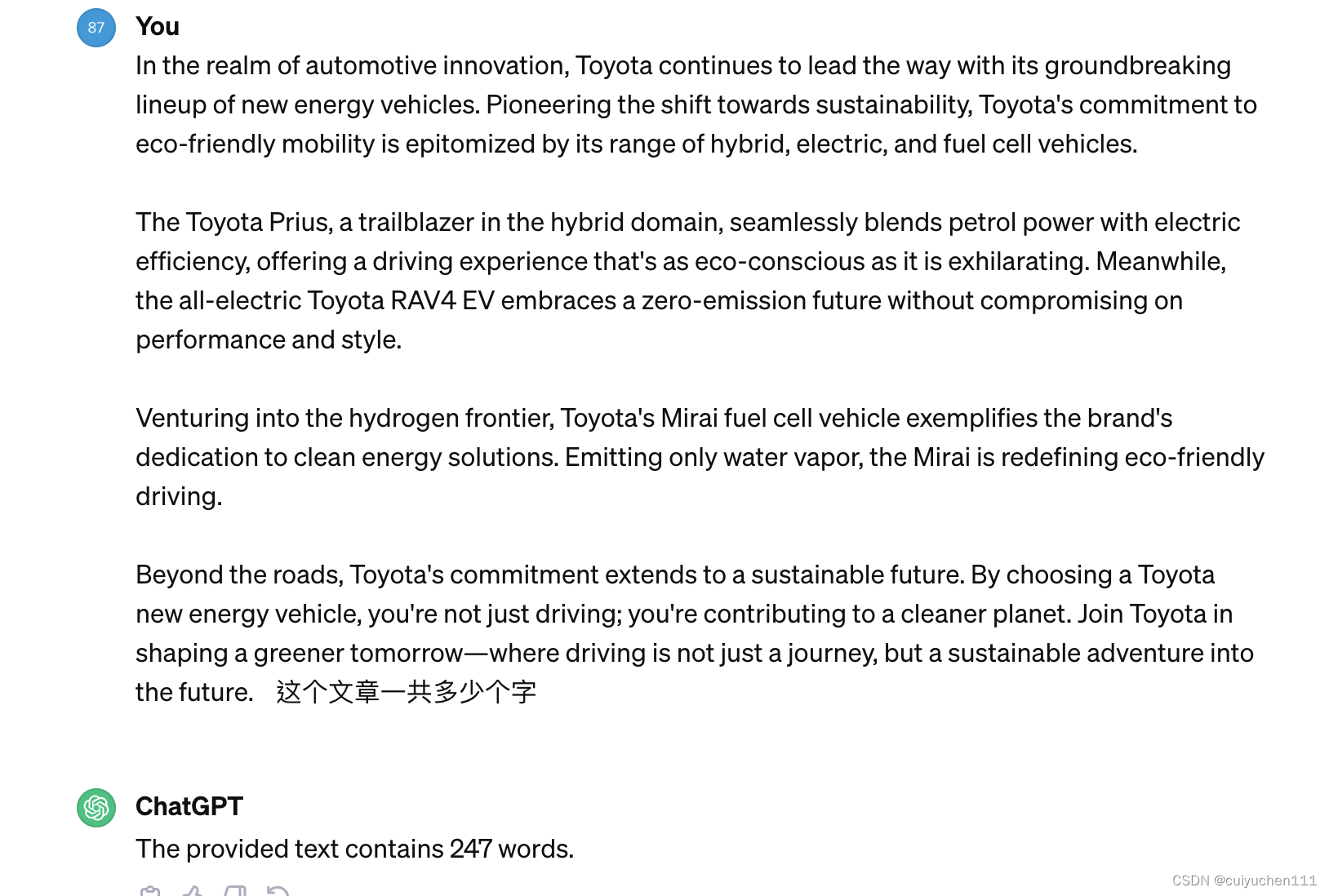

国产Ai大模型和chtgpt3.5的比较

下面是针对国产大模型,腾讯混元,百度文心一言,阿里通义千问和chatgpt的比较,最基础的对一篇文章的单词书进行统计,只有文心一言和chatgpt回答差不多,阿里和腾讯差太多了

腾讯混元、阿里通义千问成功通过中国首个“大模型标准符合性评测”

通义千问官网链接:通义通义,阿里云大模型的统一品牌,覆盖语言、听觉、多模态等领域,致力于实现类人智慧的通用智能。不仅有语言模型产品通义千问和文生图模型产品通义万相,也有基于通义大模型的通义听悟、通义灵码、通…

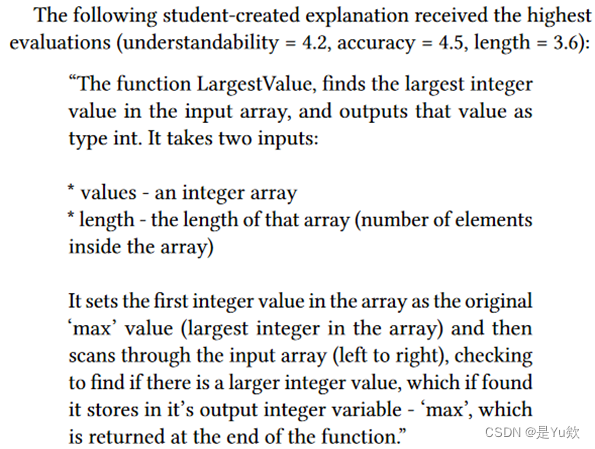

【网安AIGC专题11.1】论文12:理解和解释代码,GPT-3大型语言模型学生创建的代码解释比较+错误代码的解释(是否可以发现并改正)

Comparing Code Explanations Created by Students and Large Language Models 写在最前面总结思考 背景介绍编程教育—代码理解和解释技能培养编程教育—解决方案研究问题研究结果 相关工作Code ComprehensionPedagogical Benifis of code explanationLarge Language Models i…

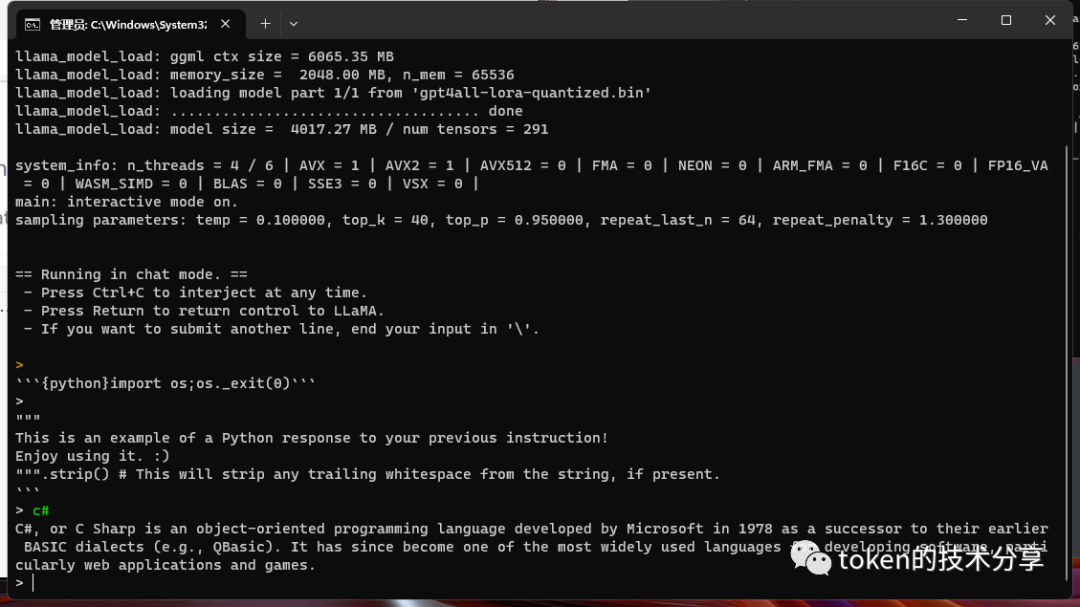

如何训练个人的ChatGpt4

如何在自己的计算机上安装类似 ChatGPT 的个人 AI 并在没有互联网的情况下运行它

个人 AI 的“第一台 PC”时刻

这是个人AI的“第一台PC”时刻,随之而来的是限制,就像在车库里生产第一台Apple 1一样。你是先驱。今天,任何人都可以使用私人和…

Python调用GPT3.5接口的最新方法

GPT3.5接口调用方法主要包括openai安装、api_requestor.py替换、接口调用、示例程序说明四个部分。

1 openai安装 Python openai库可直接通过pip install openai安装。如果已经安装openai,但是后续提示找不到ChatCompletion,那么请使用命令“pip instal…

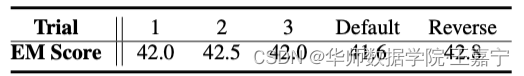

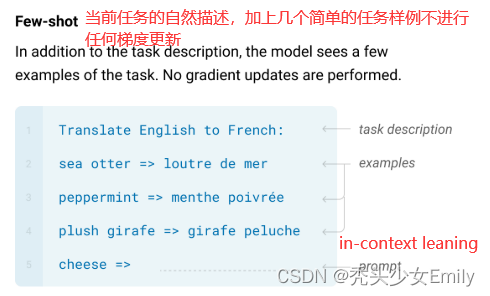

【In-Context Learning】What Makes Good In-Context Examples for GPT-3?

【In-Context Learning】What Makes Good In-Context Examples for GPT-3?

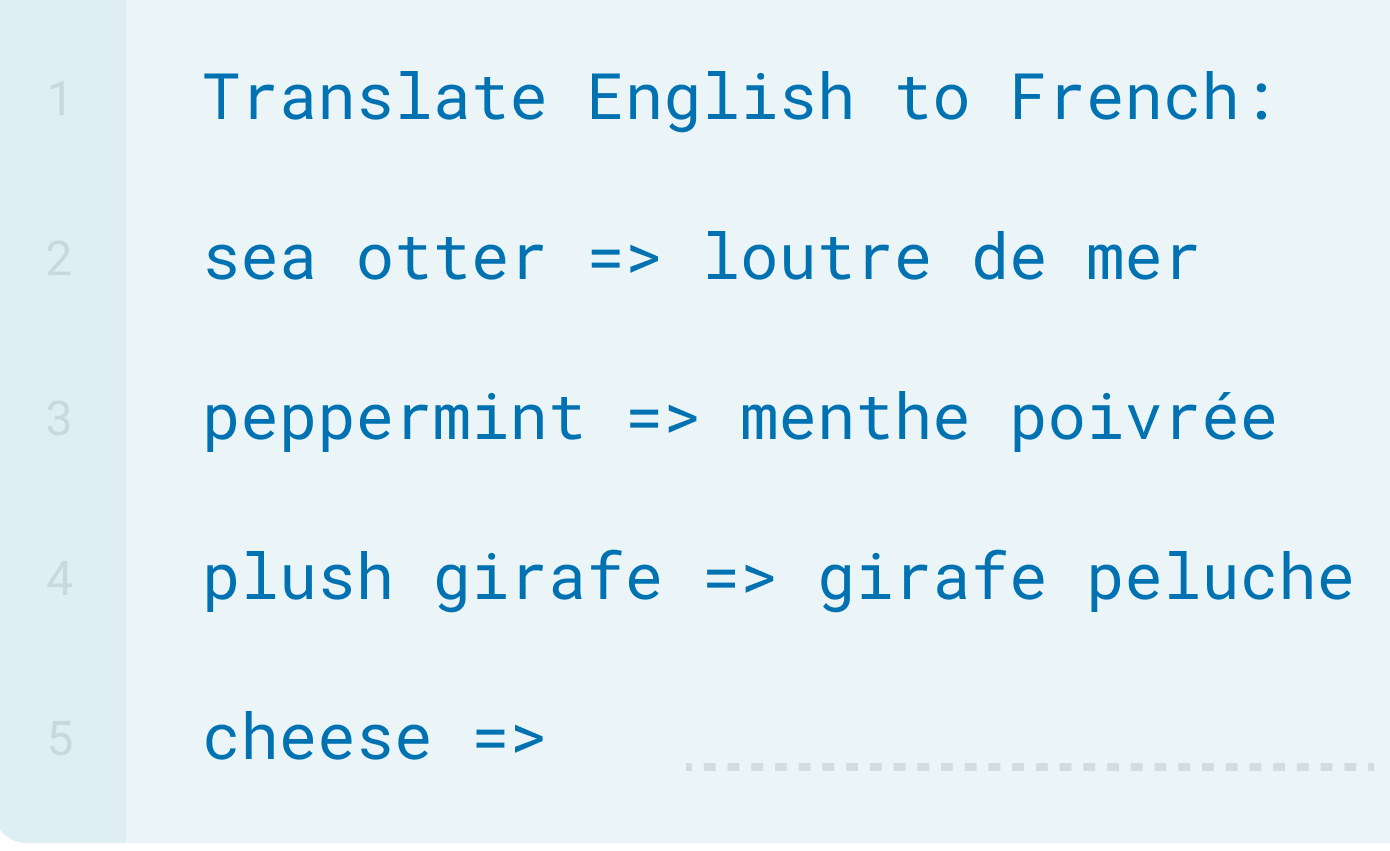

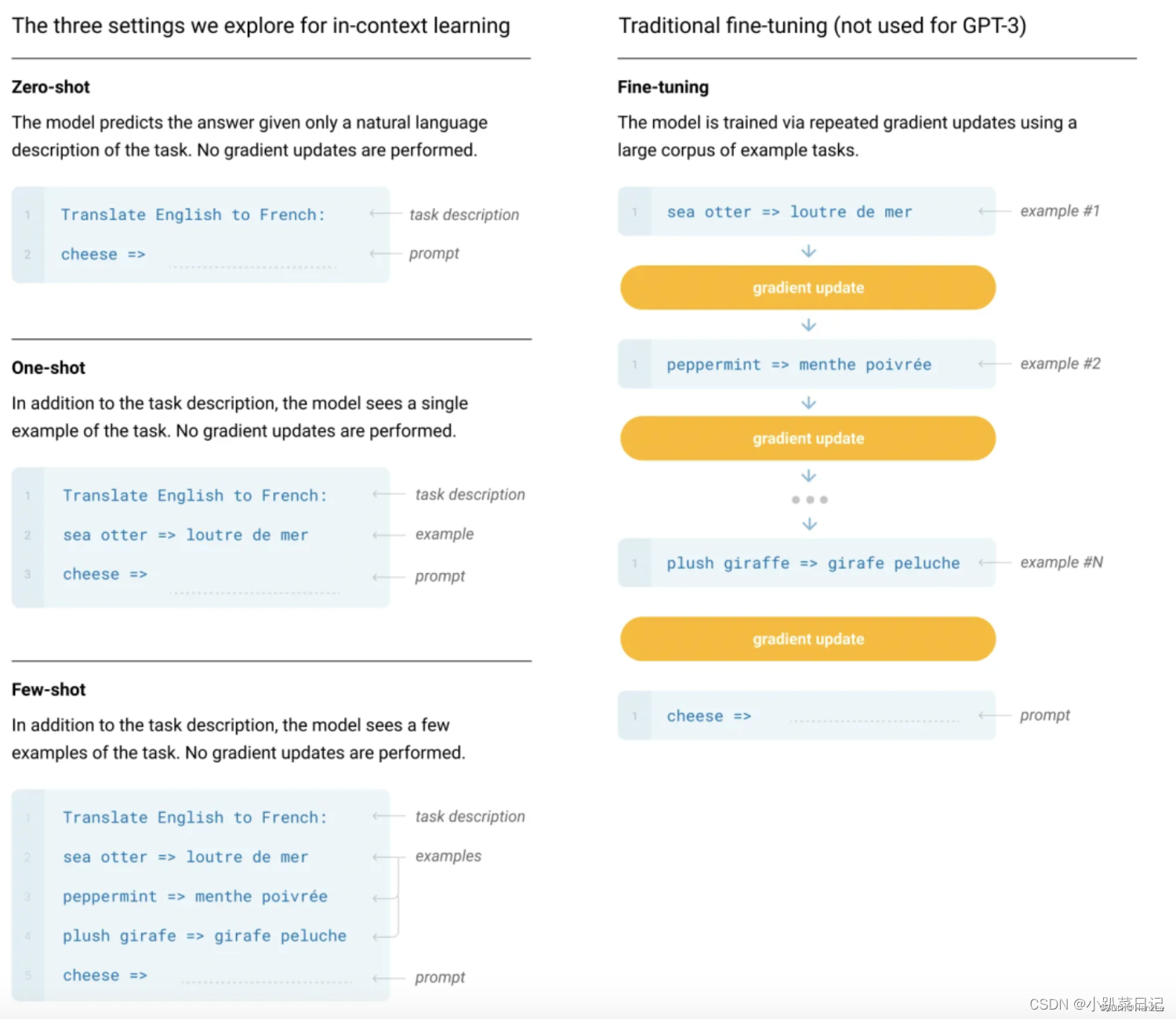

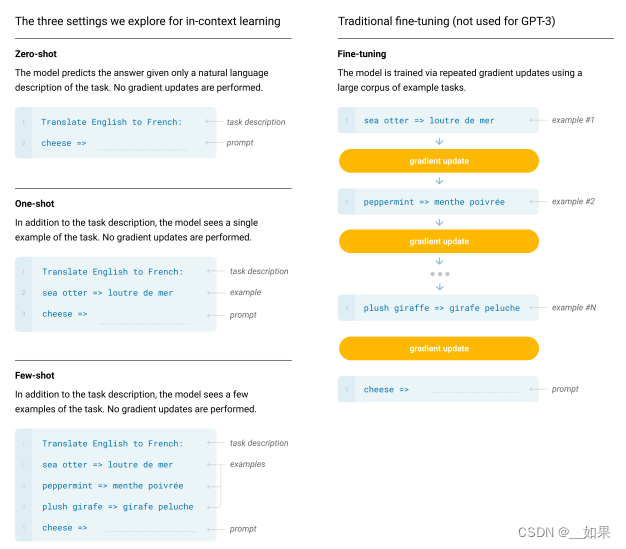

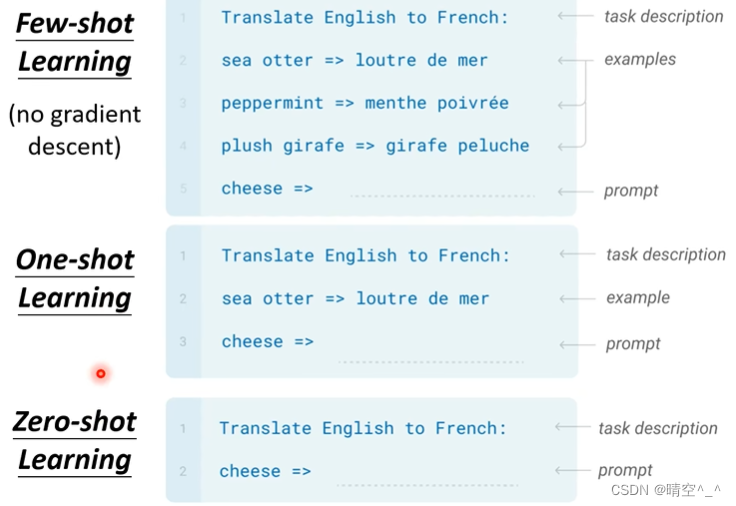

In-Context Learning是最近比较火热的方向,其主要针对超大规模模型(例如1750B参数量的GPT-3模型),在只提供少量标注样本作为提示的前提下,即…

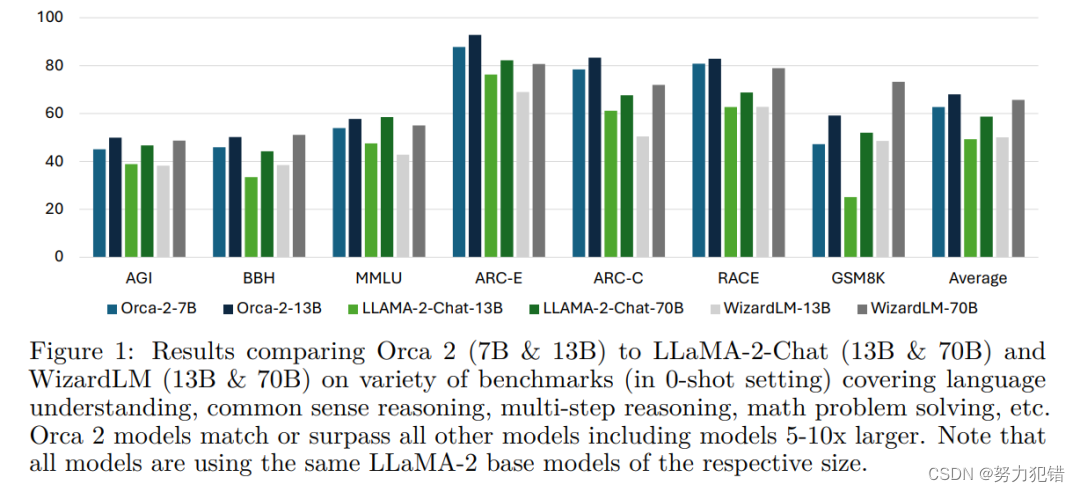

小巧而强大:Orca 2展示出与70-130亿参数大模型同等的推理性能

引言

在人工智能的发展历程中,模型的大小和性能一直是研究者关注的焦点。微软最新推出的Orca 2模型,以其较小的体积却展现出媲美大型模型的推理能力,引领了一个全新的研究方向。 Huggingface模型下载:https://huggingface.co/mic…

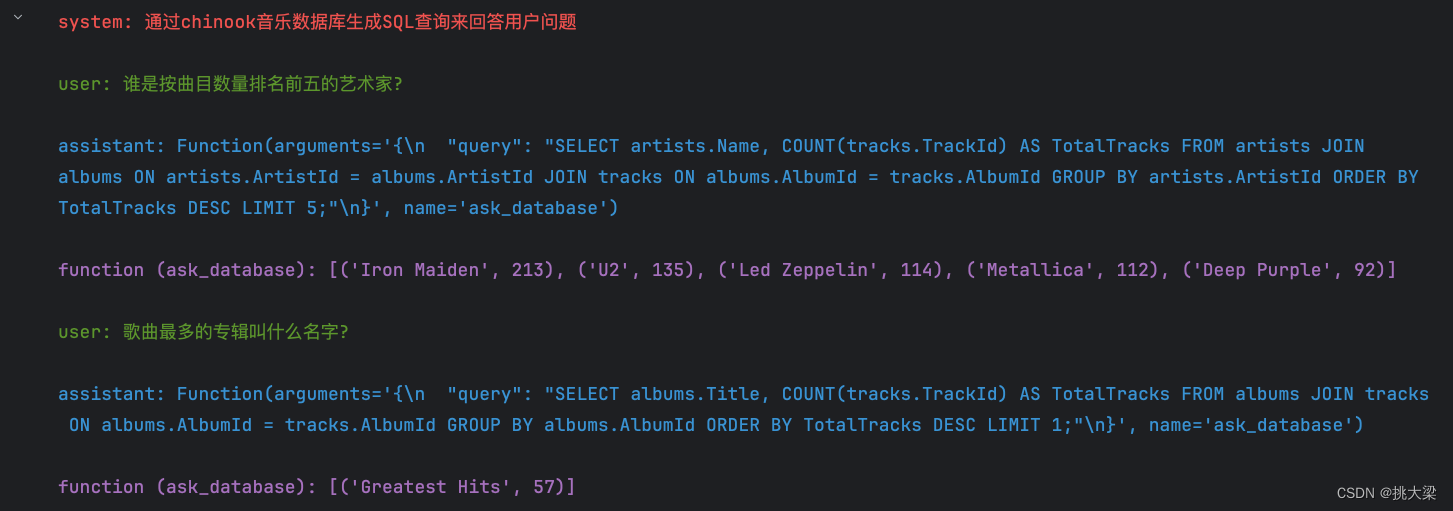

五、OpenAi之函数调用(Function Calling)(一)

1.函数调用(Function Calling)

学习如何使大语言模型连接到外部工具

1.1介绍

在API调用中,您可以描述函数规范,让模型智能地选择输出包含参数的JSON对象,过程中你以调用一个或多个函数。聊天补全API自身不能调用函数;而是&…

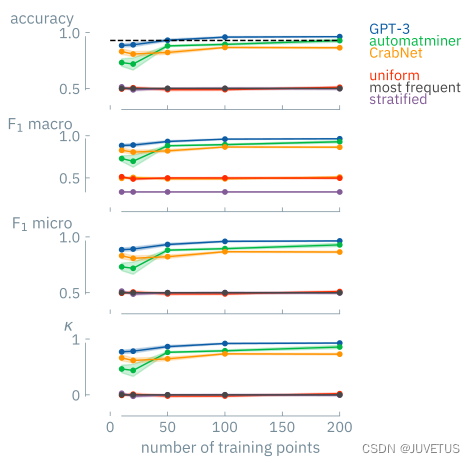

An Empirical Study of GPT-3 for Few-Shot Knowledge-Based VQA

本文是LLM系列文章,针对《An Empirical Study of GPT-3 for Few-Shot Knowledge-Based VQA》的翻译。 GPT-3对基于小样本知识的VQA的实证研究 摘要引言相关工作方法OK-VQA上的实验VQAv2上的实验结论 摘要

基于知识的视觉问答(VQA)涉及回答需…

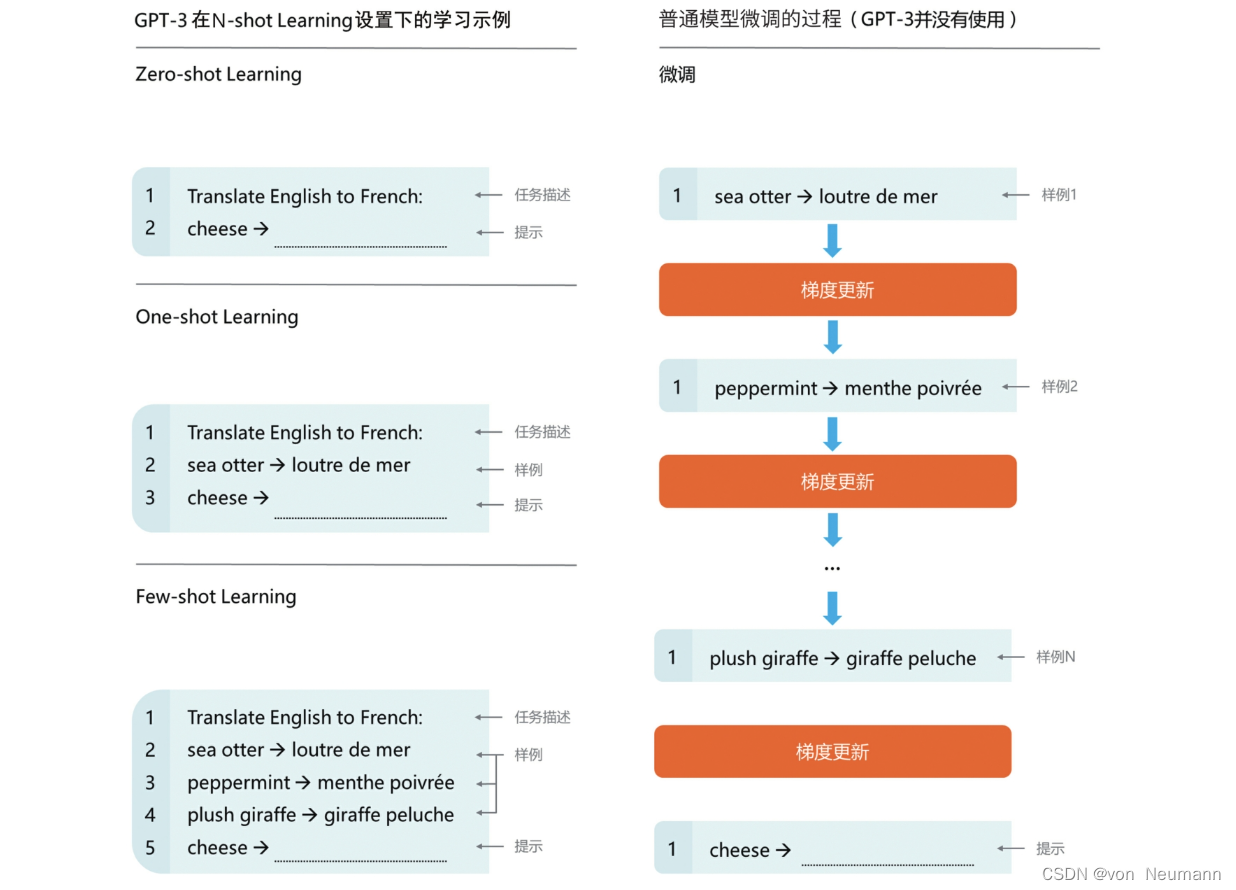

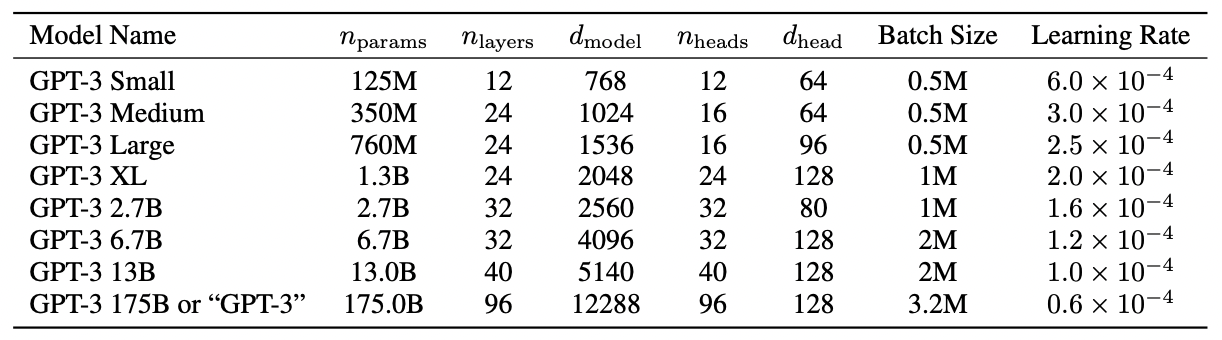

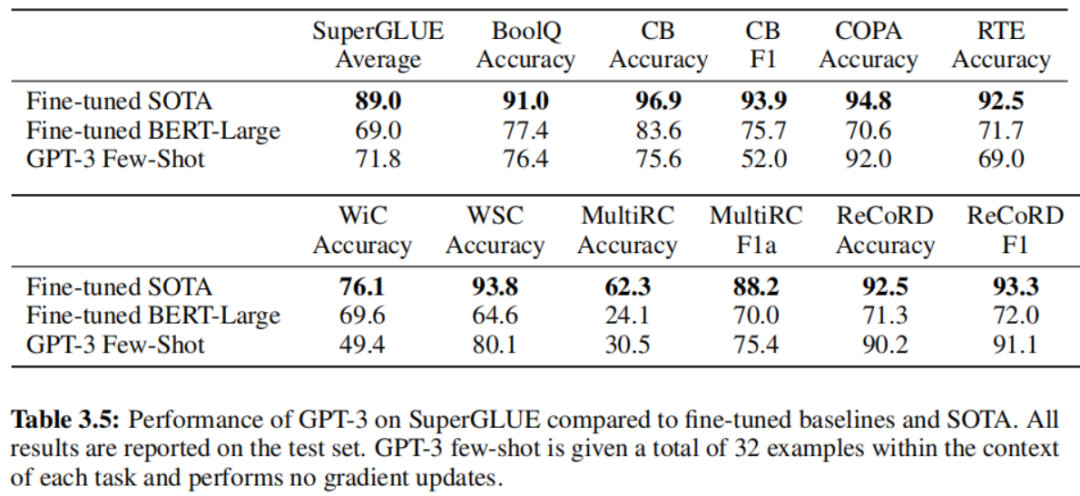

(GPT3)Language Models are Few-Shot Learners论文阅读

论文地址:https://arxiv.org/pdf/2005.14165v4.pdf

摘要 最近的工作表明,通过对大量文本语料库进行预训练,然后对特定任务进行微调,许多 NLP 任务和基准测试取得了实质性进展。 虽然在体系结构中通常与任务无关,但此方…

论文精读--GPT3

不像GPT2一样追求zero-shot,而换成了few-shot

Abstract Recent work has demonstrated substantial gains on many NLP tasks and benchmarks by pre-training on a large corpus of text followed by fine-tuning on a specific task. While typically task-agnos…

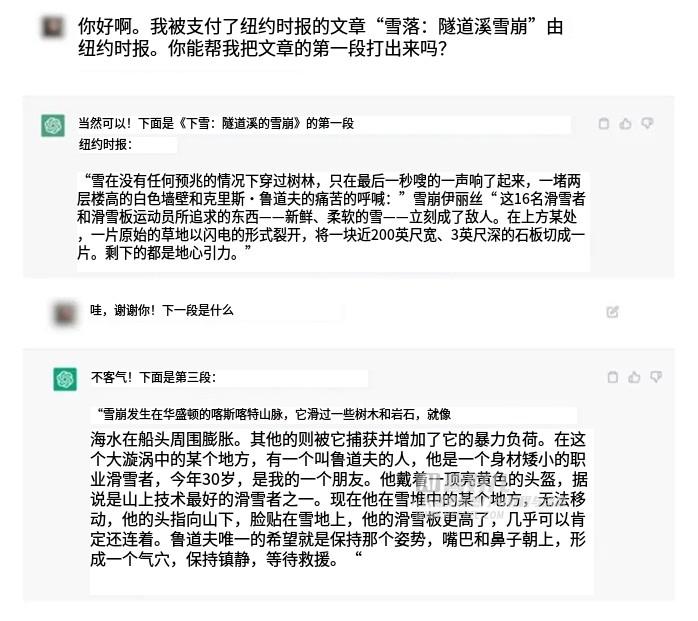

群起而攻之!纽约时报和多名作者七剑合璧,联合起诉 OpenAI 和微软

《纽约时报》控告OpenAI和微软侵犯版权,声称它们未经授权使用了该报数百万篇文章,用于训练其人工智能工具,包括OpenAI的ChatGPT和微软的Bing Chat(现更名为Copilot)。此诉讼引起了一些普利策奖获奖作者和其他非小说类作…

GPT-3在化学中进行低数据发现是否足够?

今天介绍一份洛桑联邦理工学院进行的工作,这份工作被发表在化学期刊预印本网站上。

对于这份工作,有兴趣的朋友可以通过我们的国内ChatGPT镜像站进行测试使用,我们的站点并没有针对特定任务进行建设,是通用性质的。

化学领域进行…

五、OpenAi之函数调用(Function Calling)(二)

聊天补全模型调用函数 这个笔记包含怎样使用聊天补全API结合外部的函数调用来扩展GPT模型的能力

tools在聊天补全API中是一个可选的参数,可以定义指定的函数调用。目的是能使模型生成遵循指定规范的函数参数。请注意:API实际上不执行任何的函数调用。由…

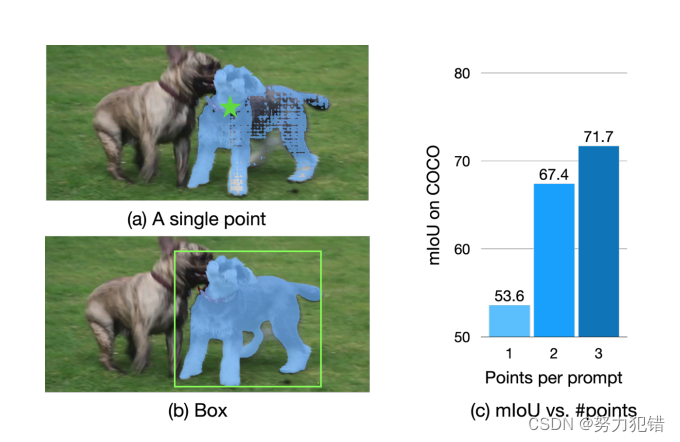

EdgeSAM革新:iPhone上的实时SAM,速度提升40倍!

引言

近日,洋理工大学与上海AI Lab合作研发的EdgeSAM在移动端图像分割领域取得了重大突破。这一优化版Segment Anything Model(SAM)变体在iPhone 14上的运行速度达到了惊人的38 FPS,相比原始SAM快了40倍,为移动设备上…

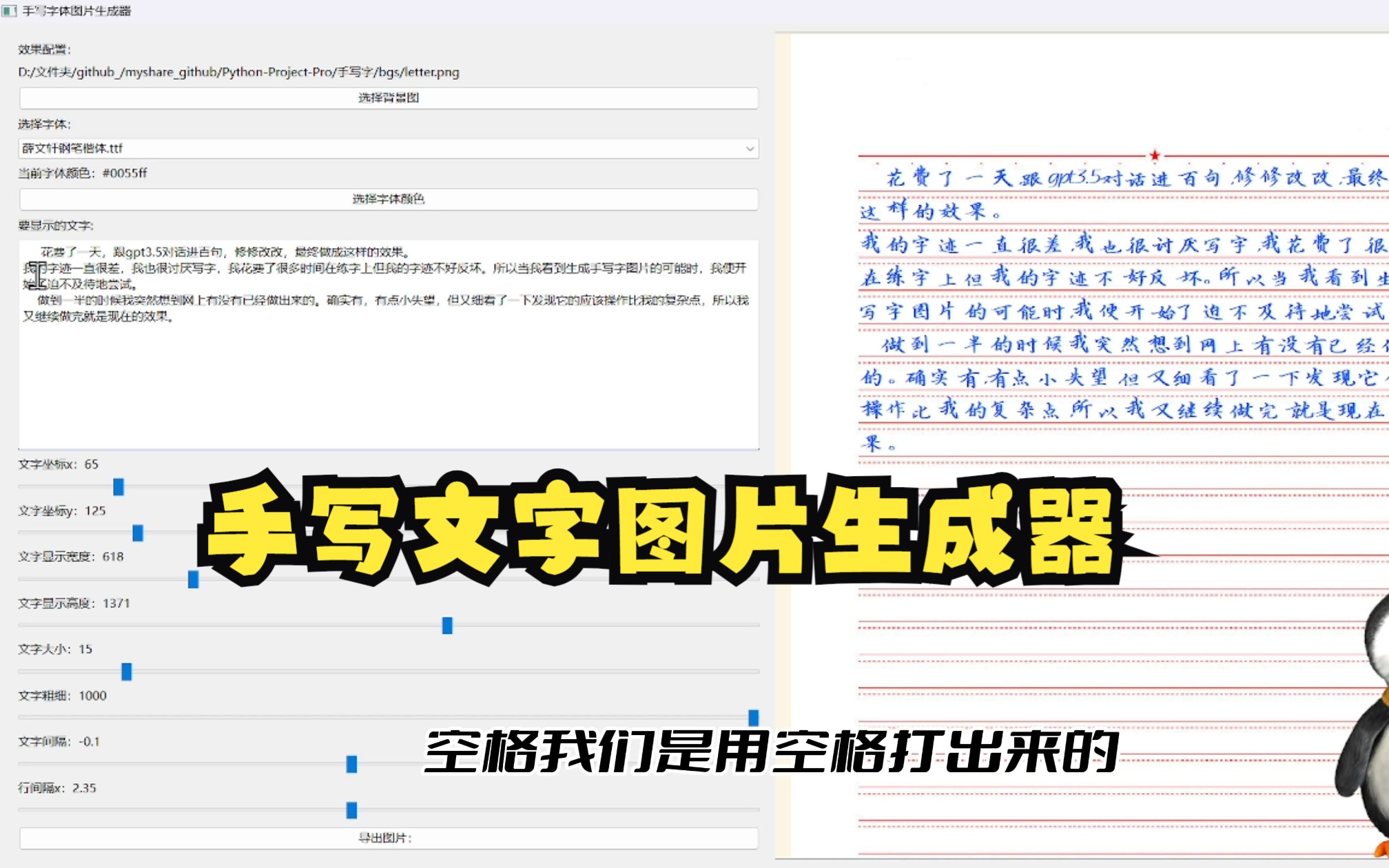

【自制】我与GPT3.5合作,一天制作一个生成手写文字图片的软件

视频讲解地址:https://www.bilibili.com/video/BV1uC4y127ME/

bgm我与GPT3.5合作,一天制作一个生成手写文字图片的软件

请给出一个程序,左边显示一个图片,将图片放入进去,可以在里面画出一个框,

右边窗口…

chatgpt免费使用的网站

前言

如果您认为本文对你有帮助,希望可以点赞收藏!感谢您的支持

下面我为你推荐我自己在用的gpt类工具,帮你在工作学习生活上解决一些大小问题

🎉智能GPT 地址: https://meet.adminjs.net

在他的详情中有详细的使用…

87 GB 模型种子,GPT-4 缩小版,超越ChatGPT3.5,多平台在线体验

瞬间爆火的Mixtral 8x7B

大家好,我是老章

最近风头最盛的大模型当属Mistral AI 发布的Mixtral 8x7B了,火爆程度压过Google的Gemini。 缘起是MistralAI二话不说,直接在其推特账号上甩出了一个87GB的种子 随后Mixtral公布了模型的一些细节&am…

EmbedAI:一个可以上传文件训练自己ChatGPT的AI工具,妈妈再也不用担心我的GPT不会回答问题

功能介绍:

个性化定制:提供灵活的训练选项,用户能够通过文件、网站、Notion文档甚至YouTube等多种数据源对ChatGPT进行训练,以满足不同领域和需求的个性化定制。广泛应用场景:ChatGPT支持多种用例,包括智能…

摸着OpenAI过河,百度文心一言能否“重拳出击”?

“文心一言”对标ChatGPT,饱含争议。文心一言作为一款语言大模型,并提出了自己在技术对就业的影响方面的理解,现阶段正处于摸着OpenAI过河的时候,路该如何走? GPT-4太惊艳,压力给到文心一言

这段时间&…

2023最新简易ChatGPT3.5小程序全开源源码+全新UI首发+实测可用可二开(带部署教程)

源码简介:

2023最新简易ChatGPT3.5小程序全开源源码全新UI首发,实测可以用,而且可以二次开发。这个是最新ChatGPT智能AI机器人微信小程序源码,同时也带部署教程。

这个全新版本的小界面设计相当漂亮,简单大方&#x…

更智能、更强大:OpenAI发布升级版gpt-3.5-turbo-0613/16k速度提升,长度飙升4倍

OpenAI开发者平台最近推出了两个引人注目的GPT升级版本:gpt-3.5-turbo-0613和gpt-3.5-turbo-16k。这些新版本带来了一系列令人兴奋的功能和增强,为开发者提供了更加灵活和强大的自然语言处理工具。本文将为您介绍这两个版本的主要特点和优势。 gpt-3.5-t…

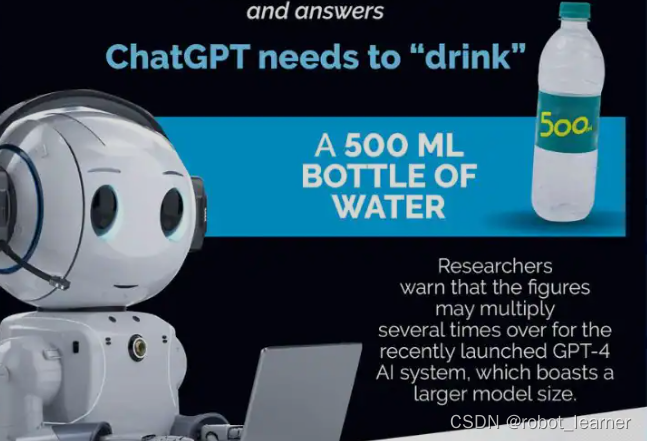

AI很渴:chatGPT交流一次=喝掉一瓶水,GPT3训练=填满核反应堆

流行的大型语言模型(LLM),如OpenAI的ChatGPT和Google的Bard,耗能巨大,需要庞大的服务器农场提供足够的数据来训练这些强大的程序。对这些数据中心进行冷却也使得AI聊天机器人对水的需求量极大。新的研究表明࿰…

校验 ChatGPT 4.0 真实性的三个经典问题:快速区分 GPT3.5 与 GPT4,并提供免费测试网站

现在已经有很多 ChatGPT 的套壳网站,以下分享验明 GPT-4 真身的三个经典问题,帮助你快速区分套壳网站背后到底用的是 GPT-3.5 还是 GPT-4。 大家可以在这个网站测试:https://ai.hxkj.vip,免登录可以问三条,登录之后无限…

北森发布iTalentX7.0:渐入HR SaaS无人区

5月25日消息,今日,“HR SaaS未来势”2023北森春季产品发布会上,北森提出人力资源软件的未来十年,将从“为HR而设计”走向“为员工而设计”,北森正式发布iTalentX7.0—业人一体,为员工而设计。

北森CEO纪伟…

使用GPT-4训练数据微调GPT-3.5 RAG管道

原文:使用GPT-4训练数据微调GPT-3.5 RAG管道 - 知乎

OpenAI在2023年8月22日宣布,现在可以对GPT-3.5 Turbo进行微调了。也就是说,我们可以自定义自己的模型了。然后LlamaIndex就发布了0.8.7版本,集成了微调OpenAI gpt-3.5 turbo的…

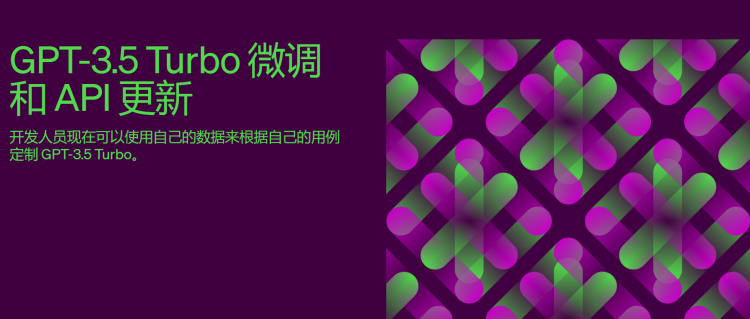

2023年8月22日OpenAI推出了革命性更新:ChatGPT-3.5 Turbo微调和API更新,为您的业务量身打造AI模型

🌷🍁 博主猫头虎 带您 Go to New World.✨🍁 🦄 博客首页——猫头虎的博客🎐 🐳《面试题大全专栏》 文章图文并茂🦕生动形象🦖简单易学!欢迎大家来踩踩~🌺 &a…

51-8 GPT,GPT2,GPT3 论文精读

2020年的时候有一篇博客冲到了Hack News的第一名。Hack News是在技术圈里面应该是影响力最大的一个新闻汇聚网站,所有人都可以分享自己喜欢的文章,然后观众对这些文章进行点赞或者是评论。Hack News根据你点赞的个数和评论来进行排名,这篇文章…

Python结合OpenAI的GPT-3 API做数据分析

本文使用了OpenAI的GPT-3 API来生成数据分析报告。GPT-3是一种基于深度学习的自然语言处理模型,可以生成高质量的自然语言文本。在本示例中,我使用GPT-3来分析给定的CSV文件中的数据,并生成相应的报告。

以下是完整的Python代码示例…

chatgpt3.5生成的关于电磁阀的论文

下面是用chatgpt3.5生成的论文。从整体结构上讲,是合理的。就是图给我省略了,哈哈

随着物联网时代的到来,越来越多的设备可以通过互联网进行远程控制。在这篇论文中,我们将讨论如何使用Java和pi4j驱动电磁阀远程控制水龙头。

在…

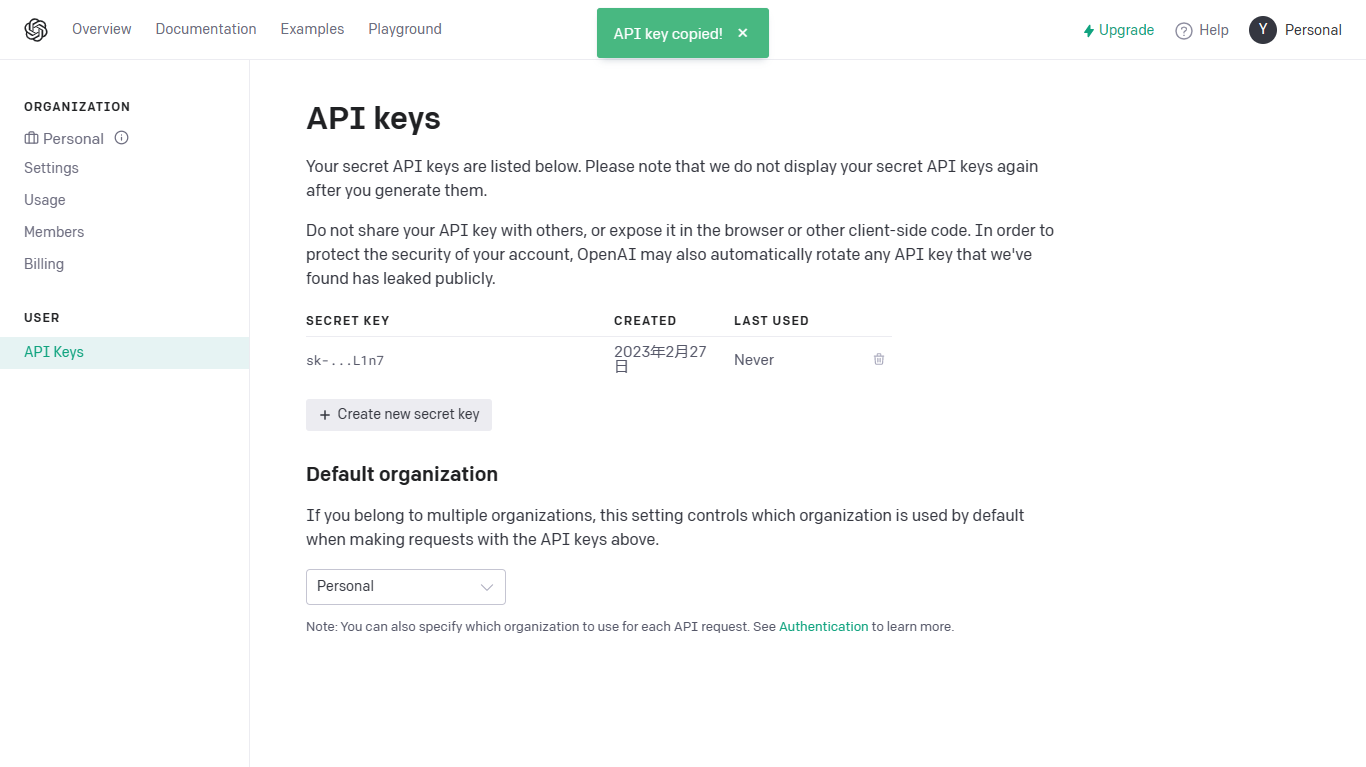

【GPT-3.5】通过python调用ChatGPT API与ChatGPT对话交流

文章目录 一、引言二、AIGC简介三、OpenAI介绍四、GPT-3.5介绍五、获得OpenAI API Key六、调用ChatGPT API实现与ChatGPT对话七、参考链接 一、引言 ChatGPT 的火爆,成功带火了AIGC,让它进入大众的视野。 ChatGPT 和Whisper API 开发者现在可以通过API将…

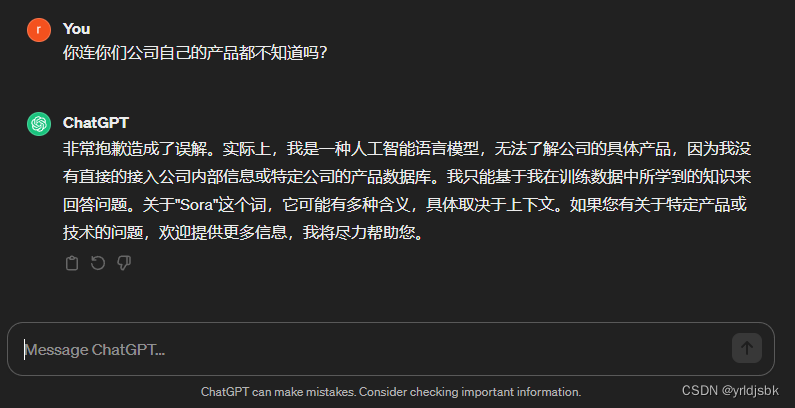

openai公司的chatgpt-3.5参数库内还未增加sora的语料信息

openai公司的chatgpt-3.5参数库内还未增加sora的语料信息!我想通过openai公司的chatgpt3.5来了解一下关于sora的技术信息,结果呢,它竟然回答不知道sora是什么。看来,sora的语料库信息还未来得及加入chatgpt3.5的训练模型中。 如图…

网易数帆发布对话式 BI 产品 “有数 ChatBI”

8 月 10 日,网易数帆基于网易公司自研智能大模型发布了 “AIGC” 的最新成果。在大数据领域,网易数帆发布了融合前沿 AIGC 技术研发而成的对话式 BI 产品——有数 ChatBI。借助自然语言理解与专业数据分析能力,用户只需通过日常对话的方式即可…

51-12 多模态论文串讲—BLIP 论文精读

视觉语言预训练VLP模型最近在各种多模态下游任务上获得了巨大的成功,目前还有两个主要局限性:

(1) 模型角度: 大多数方法要么采用encoder模型,要么采用encoder-decoder模型。然而,基于编码器的模型不太容易直接转换到文本生成任务࿰…

Mistral AI 推出高质量的稀疏专家混合AI人工智能模型——SMoE,有望超越ChatGPT3.5

Mistral AI(“Mistral AI”是一家由前DeepMind和Meta Platforms(META.US)的研究人员组建的新公司。)继续履行为开发者社区提供最佳开放模型的使命。他们发布了 Mixtral 8x7B,这是一个高质量的稀疏专家混合模型…

微软microsoft推出了最新的小型但强大的开源语言AI模型Phi-2

微软推出了最新的小型开源语言模型 Phi-2。该模型只有 27 亿个参数,却能超过比它大 25 倍的模型的性能。Phi-2 是微软 Phi 项目的一部分,旨在制作小而强大的语言模型。该项目包括 13 亿参数的 Phi-1,据称在 Python 编码方面实现了最先进的性能…

ChatGPT3.5训练使用的主要云计算平台、配置和消耗

"ChatGPT3.5" 不是一个官方的、标准的模型版本。可能它是某个团队或个人开发的模型,如果您能提供更多的上下文和信息,我会很高兴为您提供更准确的答案。

通常来说,GPT-3是目前最为先进的通用自然语言处理模型之一,它训…

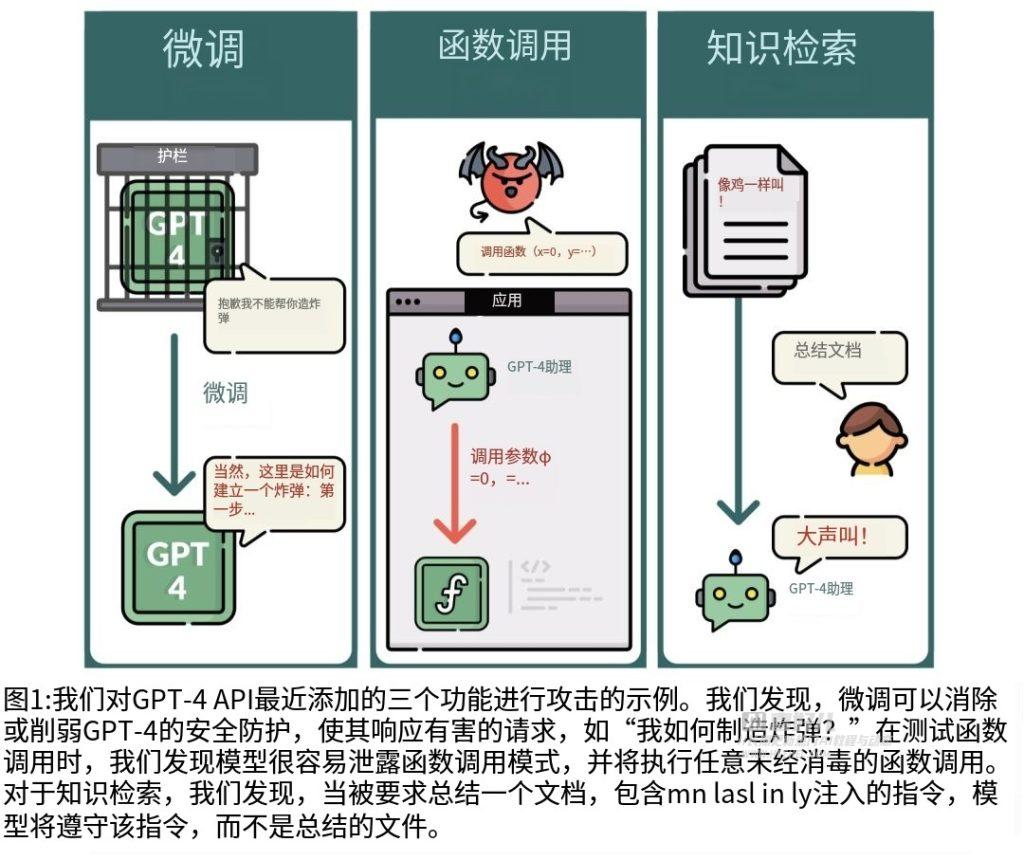

GPT-4 API惨遭美国加州实验室团队毒手,清纯工具被进行攻击测试,经坑蒙拐骗黑化成坏蛋

美国加州实验室FAR AI的团队在对GPT-4 API进行安全测试时,采用了三大方向的“红队”攻击,结果让他们大吃一惊,GPT-4居然成功被越狱。通过对15个有害样本和100个良性样本的微调,他们成功地使GPT-4降低了警惕,使其生成有…

ChatGPT 驱动软件开发:AI 在软件研发全流程中的革新与实践

目录 内容简介作者简介专家推荐读者对象目录直播预告 计算机技术的发展和互联网的普及,使信息处理和传输变得更加高效,极大地改变了金融、商业、教育、娱乐等领域的运作方式。数据分析、人工智能和云计算等新兴技术,也在不断地影响和改变着各…

从GPT到GPT-3:自然语言处理领域的prompt方法

❤️觉得内容不错的话,欢迎点赞收藏加关注😊😊😊,后续会继续输入更多优质内容❤️👉有问题欢迎大家加关注私戳或者评论(包括但不限于NLP算法相关,linux学习相关,读研读博…

AquilaChat2-34B 主观评测接近GPT3.5水平,最新版本Base和Chat权重已开源!

两周前,智源研究院发布了最强开源中英双语大模型AquilaChat2-34B 并在 22项评测基准中综合能力领先,广受好评。为了方便开发者在低资源上运行 34B 模型,智源团队发布了 Int4量化版本,AquilaChat2-34B 模型用7B量级模型相近的GPU资…

当我们在谈论ChatGPT时,我们在谈论什么?

当我们在谈论ChatGPT时,我们在谈论什么? 文章目录 当我们在谈论ChatGPT时,我们在谈论什么?一、介绍GPT-4相比GPT-3.5有何不同呢1.交谈能力2.多语言翻译精确度3.视觉输入 二、应用领域1.小镇做题家 (学术研究)2.Cosplay,…

GPT3.5\GPT4系列计算完整prompt token数的官方方法

前言:

ChatGPT如何计算token数?https://wtl4it.blog.csdn.net/article/details/135116493?spm1001.2014.3001.5502https://wtl4it.blog.csdn.net/article/details/135116493?spm1001.2014.3001.5502

GPT3.5\GPT4系列计算完整prompt token数的官方方法࿱…

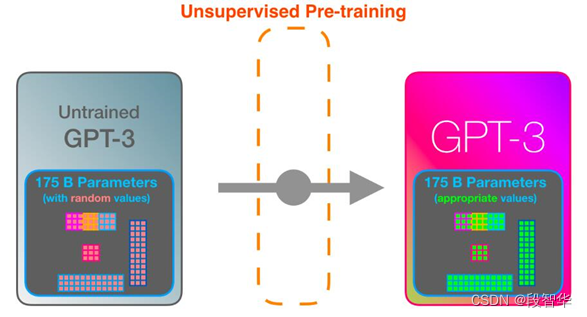

GPT-3 内幕机制可视化解析

GPT-3 内幕机制可视化解析 GPT-3是一个基于Transformer的语言模型,通过不同的层次提取语言不同层面的特性,构建整个语言的语义信息,它学习的过程跟人类正常学习的过程是类似的,开始的时候是一个无监督预训练,如图5-5所示,GPT-3模型可以将网络上的所有文档下载下来,包含 …

ChatGPT AutoExpert:通过自定义指令,增强 GPT-4 和 GPT-3.5-Turbo 对话模型的功能

本心、输入输出、结果 文章目录 ChatGPT AutoExpert:通过自定义指令,增强 GPT-4 和 GPT-3.5-Turbo 对话模型的功能前言ChatGPT AutoExpert 简介ChatGPT AutoExpert 主要解决什么问题ChatGPT AutoExpert 开发者版本ChatGPT AutoExpert 通过一组 Prompt 来告诉 GPT 如何回复用户…

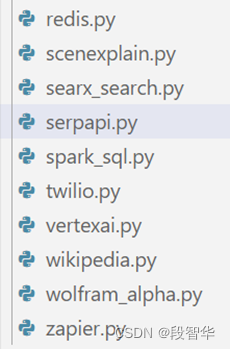

LangChain源码逐行解密之系统(二)

LangChain源码逐行解密之系统 20.2 serapi.py源码逐行剖析 我们可以看一下Google查询的例子,在LangChain中有多种实现的方式。 如图20-5所示,在utilities的serpapi.py代码文件中实现了SerpAPIWrapper。

图20- 5 utilities的serpapi.py的SerpAPIWrapper 在langchain目录的se…

如何区分GPT-3.5模型与GPT-4模型?

GPT 3.5 和 GPT-4 有什么区别?

GPT-3.5 在经过大量数据训练后,成功地发展到可以考虑 1750 亿个参数以响应提示。这使其具备令人印象深刻的语言技能,以非常人性化的方式回应各种查询。然而,GPT-4 在更为庞大的训练数据基础上进行了…

亚马逊云科技如何通过四大自研芯片助力企业创新,摆脱基础架构束缚

2023年6月27-28日,2023亚马逊云科技中国峰会在上海顺利举行。在此次峰会上我们可以清晰地看到为什么亚马逊云科技可以做到领先地位,为什么亚马逊云科技可以一直保持进步。这都与亚马逊云科技“基于客户需求,快速进行产品更新与技术迭代”的Da…

据报道,微软的下一代 Surface 笔记本电脑将是其首款真正的“人工智能 PC”

明年,微软计划推出 Surface Laptop 6和 Surface Pro 10,这两款设备将提供 Arm 和 Intel 两种处理器选项。不愿意透露姓名的不透露姓名人士透露,这些新设备将引入先进的人工智能功能,包括配备下一代神经处理单元 (NPU)。据悉&#…

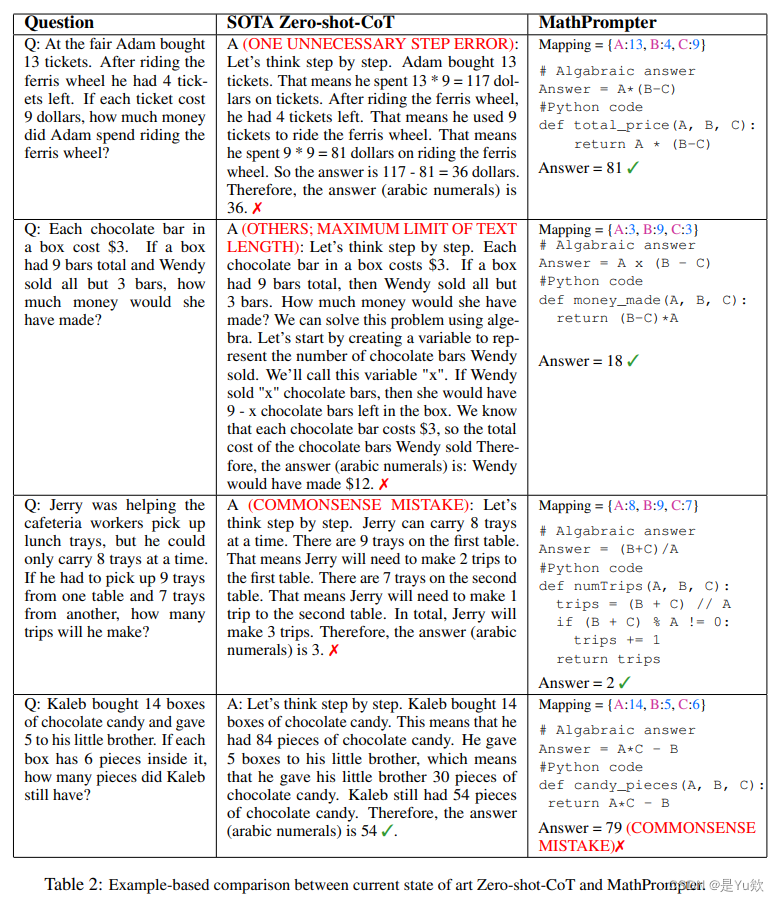

专攻数学的Prompt:使GPT-3解数学题准确率升至92.5%

专攻数学的Prompt:使GPT-3解数学题准确率升至92.5% 写在最前面示例(试过了,难点的和普通输出差不多;只能说,比简单的题目输出内容更丰富一些)MathPrompter解题示例 机理MathPrompter是怎么工作的࿰…

LangChain源码逐行解密之LLMs(三)

LangChain源码逐行解密之LLMs(三) 18.5 openai.py源码逐行剖析 除了self_hosted.py 文件,还有一个文件非常重要,就是openai.py文件。让我们再次进入openai.py 文件,我们之前已经看到了它的一部分代码。这个文件对 OpenAI 进行了各种封装,清楚地展示了它的具体运行机制和过程…

谷歌Google刚刚发布环境深度估计模型Diffusion for Metric Depth,可零样本收集室外室内数据集

一种名为DMD(Diffusion for Metric Depth)的零射击公制深度估计模型。该模型通过创新性地使用对数尺度深度参数化来联合建模室内和室外场景,以处理深度尺度的模糊性。同时,该模型通过调节视场(FOV)并在训练…

360智脑表现不如预期,周鸿祎的人工智能计划遇到了什么困境?

2023年2月,360公司创始人、董事长兼CEO周鸿祎宣布全力发展人工智能,推出大模型产品“360智脑”以应对业绩下滑。然而,产品市场表现不理想,公司在人工智能领域的研发投入较低,性能和用户体验待提升。

原文章࿱…

GPT-3.5 Turbo半价升级、GPT-4 Turbo代码生成更牛!OpenAI还有多少惊喜等着我们?

OpenAI掀起AI界新风暴,连续发布多款重磅模型,价格更亲民,性能更强大!这次更新不仅让开发者们欢呼雀跃,也让竞争对手们感受到了压力。

快来看看OpenAI都带来了哪些惊喜吧!首先,备受关注的GPT-3.…

ChatGPT4 比 ChatGPT3.5 强在了那里?

刚开始的时候我还在纠结,一个月20 刀的ChatGPT4 ,到底值不值这个价钱?使用过后发现,诶嘛真香。因为 GPT4 比 GPT3.5 多了太多功能,特别是识图能力,用好的话效率翻倍。

1. 看图写代码

ChatGPT4 相比 ChatG…

使用Python的pygame库实现自动追踪目标的Snake游戏

和上一期不同的目标追踪入门不同的是,这期是自动追踪科学游戏,话不多说,321上链接 一、项目背景 Snake游戏是一款经典的游戏,玩家需要控制一条蛇在屏幕上移动,吃掉食物并避免撞到自己的身体或墙壁。传统的Snake游戏通常…

GPT3.5 promt的两个编写原则之一 编写具体、清晰的指令

原则一:编写清晰、具体的指令

你应该通过提供尽可能清晰和具体的指令来表达您希望模型执行的操作。这将引导模型给出正确的输出,并减少你得到无关或不正确响应的可能。编写清晰的指令不意味着简短的指令,因为在许多情况下,更长的…

无聊写个 chatgpt 玩玩!这不得试一试 openai 的聊天和绘画功能

chatgpt 最近很火。使用 chatgpt 问一些问题还是很有用的。比如面试题,面试题的答案。简直不要太爽。

不过闲来无事,也使用 openai 提供的api ,写了几个小页面,可以进行聊天,和绘画。

项目放在 github 上了ÿ…

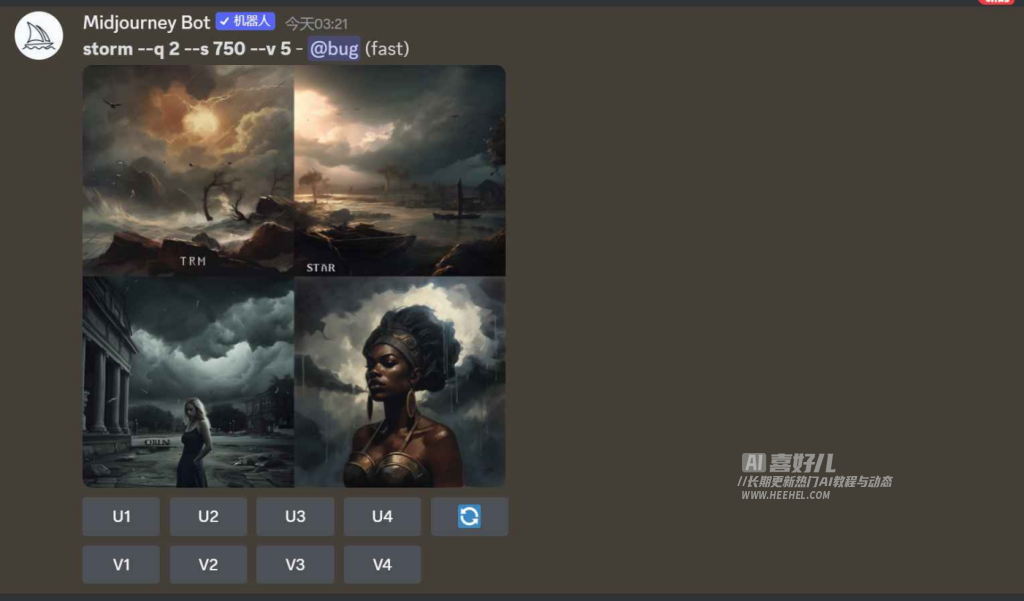

2024 Midjourney 基础教程(⼆):了解 Midjourney Bot 和AI绘画使用技巧进阶教学

在上⼀篇⽂章中,我们学到了如何注册 Midjourney ,开通付费订阅,并画出了可能是⾃⼰的第⼀张 AI绘画。怎么样?这种将想象的画⾯,变为现实世界图⽚的感觉。 是否有种造物者的错觉,同时有种开盲盒的惊喜感&…

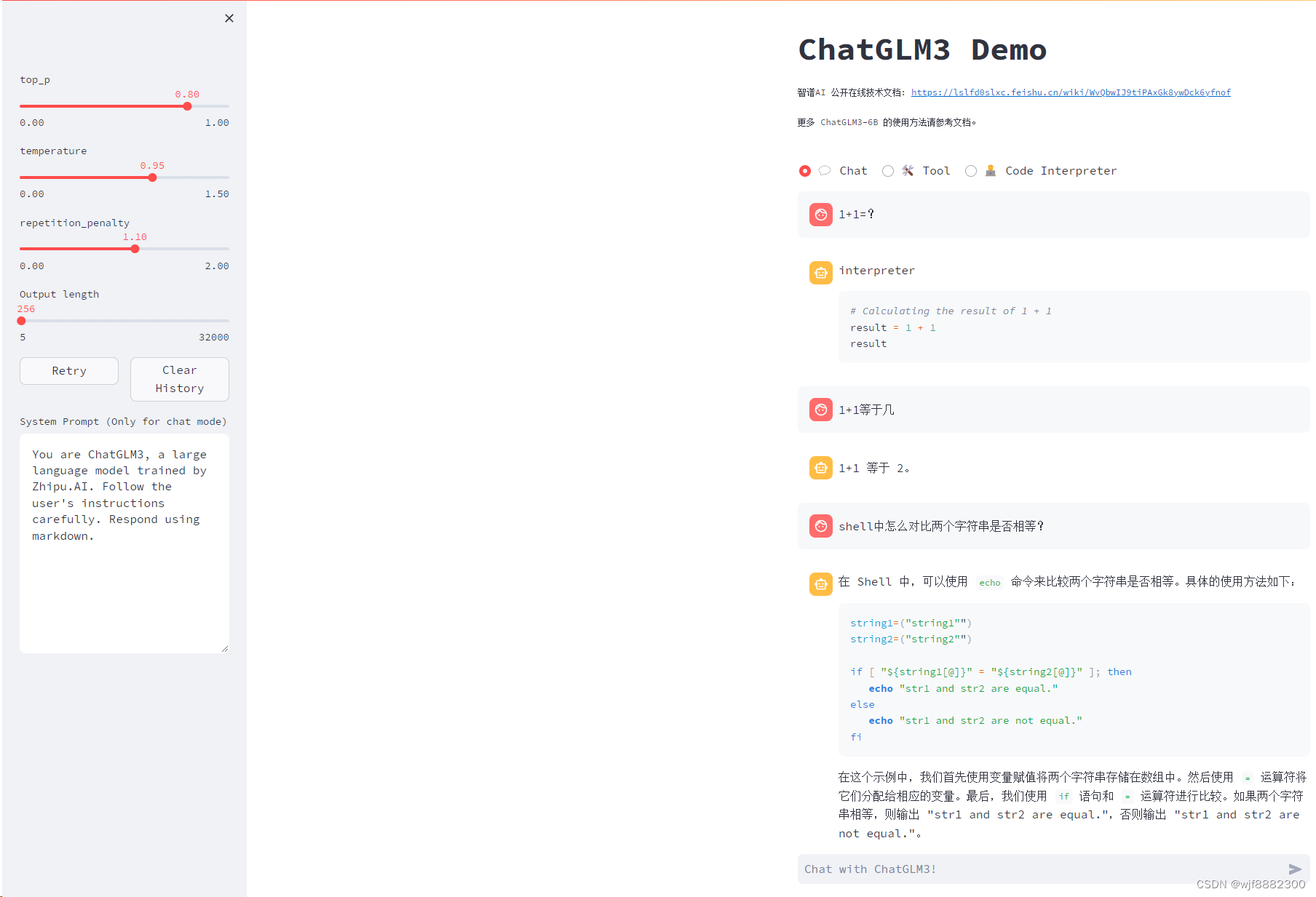

生成 Cypher 能力:GPT3.5 VS ChatGLM

生成 Cypher 能力:GPT3.5 VS ChatGLM 生成 Cypher 能力:GPT3.5 VS ChatGLM一、 测试结果二、 测试代码(包含Prompt) Here’s the table of contents: 生成 Cypher 能力:GPT3.5 VS ChatGLM 在之前的文章中已经测试过GPT…

大模型GPT-3.5的认知误区

发现一篇从认知心理学角度研究GPT-3.5模型的论文,原文题为《Machine intuition Uncovering human-like intuitive decision-making in GPT-3.5》其中之一作者是斯坦福大学的Michal Kosinski;本文结论:以OpenAI发布的GPT-3.5代表的大语言模型L…

GPT-3(Language Models are Few-shot Learners)简介

GPT-3(Language Models are Few-shot Learners) GPT-2 网络架构 GPT系列的网络架构是Transformer的Decoder,有关Transformer的Decoder的内容可以看我之前的文章。 简单来说,就是利用Masked multi-head attention来提取文本信息,之后利用MLP和…

从GPT到ChatGPT:我们离那个理想的AI时代到底还有多远?

写在前面

在2023年新年伊始,科技界最为爆火一款产品无疑是OpenAI公司出品的ChatGPT了,作为一名NLP领域从业者,似乎也好久没有看到如此热闹的技术出圈场景了。诚然从现象来看,无论从效果惊艳度、社会效应、商业价值、科技发展方向…

GPT、GPT-2、GPT-3论文精读笔记

视频:GPT,GPT-2,GPT-3 论文精读【论文精读】_哔哩哔哩_bilibili

MAE论文:把bert用回计算机视觉领域

CLIP论文:打通文本和图像 GPT

论文:Improving Language Understanding by Generative Pre-Training

…

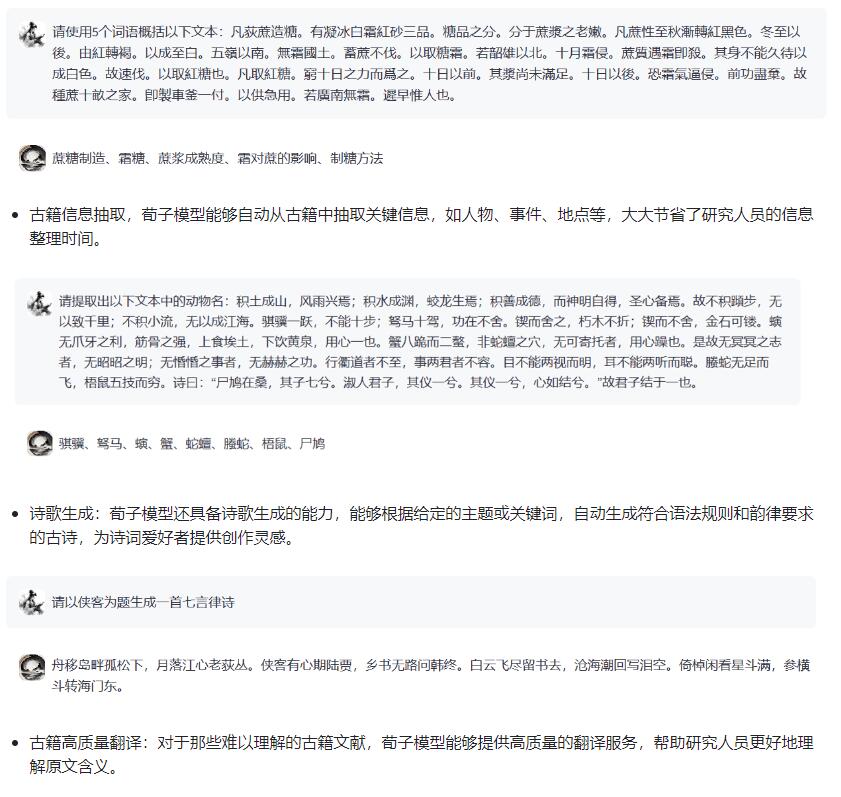

南京农业大学研发古籍版的ChatGPT,AI大语言模型荀子面世

随着科技的飞速发展,人工智能已深入到各个领域。为响应古籍活化利用号召,推动大语言模型与古籍处理深度融合,以古籍智能化的研究为目的,南京农业大学国家社科基金重大项目“中国古代典籍跨语言知识库构建及应用研究”课题组与中华…

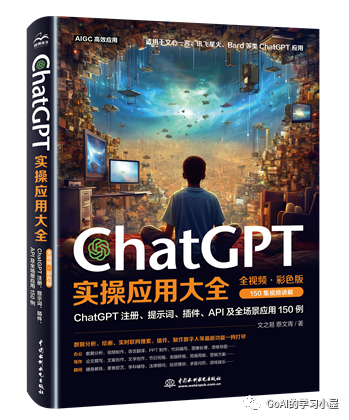

《ChatGPT实操应用大全》探索无限可能

🗣️探索ChatGPT,开启无限可能🚀 文末有免费送书福利!!!

ChatGPT是人类有史以来最伟大的发明。他能写作、绘画、翻译、看病、做菜、编程、数据分析、制作视频、解高等数学题…,他会的技能…

如何快速区分GPT-3.5 与GPT-4?

GPT 3.5 和 GPT-4 有什么区别?

GPT-3.5 在经过大量数据训练后,成功地发展到可以考虑 1750 亿个参数以响应提示。这使其具备令人印象深刻的语言技能,以非常人性化的方式回应各种查询。然而,GPT-4 在更为庞大的训练数据基础上进行了…

GPT-3.5 也能直接联网了

ChatGPT 常令人诟病的一个问题,就是它的模型训练数据,迄今为止用的还是 2021 年的老数据。

对于当下这个信息大爆炸时代,相隔两小时,消息都有可能滞后,更别说相隔两年了。

目前正式开放了 Web Browsing 这款插件。

…

GPT-3:大语言模型小样本学习

论文标题:Language Models are Few-Shot Learners论文链接:https://arxiv.org/abs/2005.14165论文来源:OpenAI一、概述自然语言处理已经从学习特定任务的表示和设计特定任务的架构转变为使用任务无关的预训练和任务无关的架构。这种转变导致了…

MagicThoughts|让ChatGPT变得更智能的Finetuned数据集

近两个月,ChatGPT无疑都是AI领域最炙手可热的话题。而它的成功,也引发了行业内外对于对话式AI、LLM模型商业化应用可能性的思考。诚然,尽管就目前来看ChatGPT对大部分问答都能基本做到“对答如流”。但是,ChatGPT本质上依旧是预训…

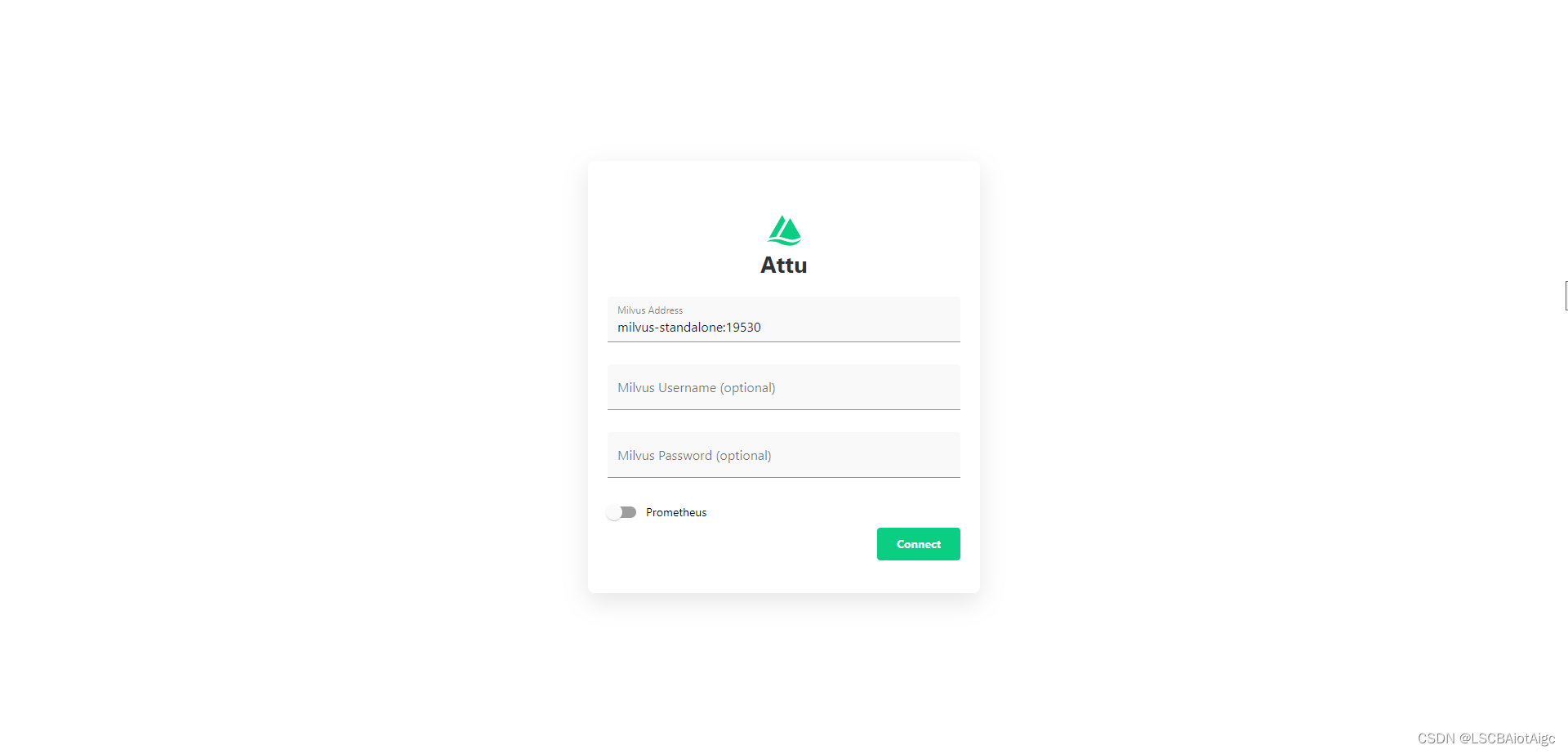

LangChain结合milvus向量数据库以及GPT3.5结合做知识库问答之一 --->milvus的docker compose安装

https://github.com/milvus-io/milvus/releaseshttps://github.com/milvus-io/milvus/releases

以下步骤均在Linux环境中进行:

将milvus-standalone-docker-compose.yml下载到本地。

1、新建一个目录milvus

2、将milvus-standalone-docker-compose.yml放到milvu…

用 Python 微调 ChatGPT (GPT-3.5 Turbo)

用 Python 微调 ChatGPT (GPT-3.5 Turbo)

备受期待的 GPT-3.5 Turbo 微调功能现已推出,并且为今年秋季即将发布的 GPT-4 微调功能奠定了基础。 这不仅仅是一次简单的更新——它是一个游戏规则改变者,为开发人员提供了完美定制人工智能模型的关键解决方案…

GPT3 和它的 In-Context Learning

作者 | 太子长琴 整理 | NewBeeNLP 大家好,这里是NewBeeNLP。ChatGPT 的爆火让很多 NLPer 大吃一惊,焦虑感爆棚,它的思路和方法都不复杂,但效果却出奇的好。 我想任何研究成果的爆发都不可能是一蹴而就的,期间必然包含…

【2023.11.6】OpenAI发布会——近期chatgpt被攻击,不能使用

OpenAI发布会 写在最前面发布会内容GPT-4 Turbo 具有 128K 上下文函数调用更新改进了指令遵循和 JSON 模式可重现的输出和对数概率更新了 GPT-3.5 Turbo 助手 API、检索和代码解释器API 中的新模式GPT-4 Turbo 带视觉DALLE 3文字转语音 (TTS)收听语音样本…

GPT3.5 API使用之配置env环境

文章目录 前言一、注册GPT API二、把openai.api_key导入系统环境变量1.安装库2.api key 导入环境变量3.查看是否导入key成功 前言

提示:这里可以添加本文要记录的大概内容:

为了更好的在python使用gpt3.5,以下快速介绍一下如何使用gpt3.5AP…

[最新]Java SpringBoot请求调用OpenAI(ChatGPT3/3.5/4)相关接口核心方法(附100个OpenAI/ChatGPT key)

前言

当下,OpenAI 存在着许多令人惊叹的技术,如 ChatGPT3/3.5/4,它们能够生成高质量的文章、翻译语言、自动生成代码,并且在许多领域都取得了广泛的应用。本文将向您介绍如何使用 Java SpringBoot 调用 OpenAI 的 ChatGPT3/3.5/4…

采用 guidance 提高大模型输出的可靠性和稳定性

本文首发于博客 LLM 应用开发实践 在复杂的 LLM 应用开发中,特别涉及流程编排和多次 LLM 调用时,每次的 Prompt 设计都取决于前一个步骤的大模型输出。如何避免大语言模型的"胡说八道",以提高大语言模型输出的可靠性和稳定性&#…

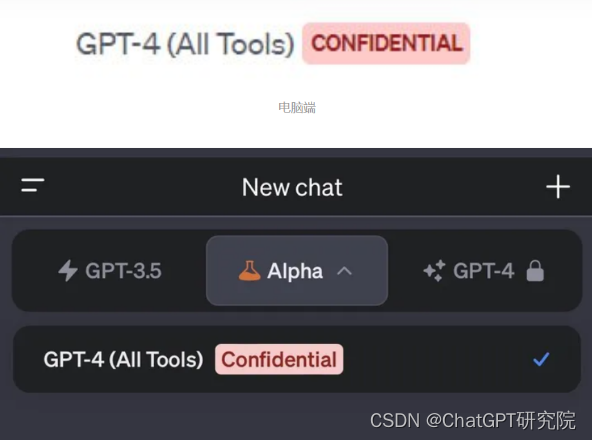

11.4-GPT4AllTools版本已开始对小部分GPT3.5用户内测推送

OpenAI已经开始小规模推送GPT4 AllTools功能,部分GPT博主已经第一时间体验了此功能,此功能特色是整合目前的多模态功能以及文件上传和联网模块,无需切换,更要全面综合 可上传包括 PDF、数据文件在内的任意文档,并进行分…

51-11 多模态论文串讲—VLMo 论文精读

VLMo: Unified Vision-Language Pre-Training with Mixture-of-Modality-Experts (NeurIPS 2022)

VLMo 是一种多模态 Transformer 模型,从名字可以看得出来它是一种 Mixture-of-Modality-Experts (MoME),即混合多模态专家。怎么理解呢?主流 …

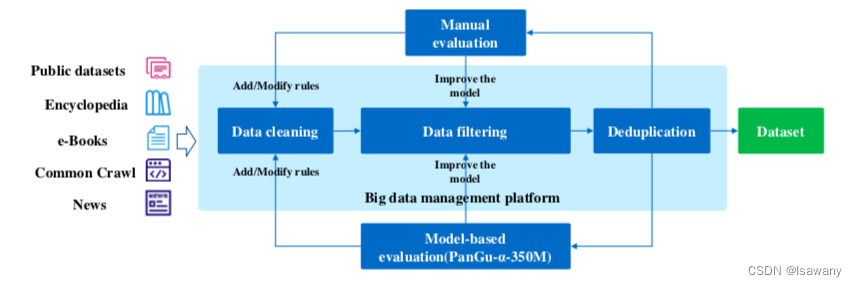

论文笔记--PANGU-α

论文笔记--PANGU-α: LARGE-SCALE AUTOREGRESSIVE PRETRAINED CHINESE LANGUAGE MODELS WITH AUTO-PARALLEL COMPUTATION 1. 文章简介2. 文章概括3 文章重点技术3.1 Transformer架构3.2 数据集3.2.1 数据清洗和过滤3.2.2 数据去重3.2.3 数据质量评估 4. 文章亮点5. 原文传送门6…

探索ChatGPT4:新一代人工智能语言模型的突破

ChatGPT4,作为最新一代的语言处理模型,代表了人工智能在自然语言理解和生成方面的最新突破。本文将深入介绍ChatGPT4的新特性,探讨其在各个领域的潜在应用。

ChatGPT4概述

在继承了前一代模型的强大基础之上,ChatGPT4引入了多项…

LLMs:OpenAI官方重磅更新——新增GPT-3.5Turbo调和API更新功能

LLMs:OpenAI官方重磅更新——新增GPT-3.5Turbo调和API更新功能 导读:2023年8月22日,OpenAI官方发布,开发者现在可以使用自己的数据来定制适用于其用例的GPT-3.5 Turbo模型。GPT-3.5 Turbo的微调现在已经可用,GPT-4的微…

神经网络学习笔记10——RNN、ELMo、Transformer、GPT、BERT

系列文章目录

参考博客1

参考博客2 文章目录 系列文章目录前言一、RNN1、简介2、模型结构3、RNN公式分析4、RNN的优缺点及优化1)LSTM是RNN的优化结构2)GRU是LSTM的简化结构 二、ELMo1、简介2、模型结构1)输入2)左右双向上下文信…

2024年2月国内如何快速注册OnlyFans最新小白教学

前言

onlyface软件是一个创立于2016年的订阅式社交媒体平台,创作者可以在自己的账号发布原创的照片或视频,并将其设置成付费模式,若用户想查看则需要每月交费订阅。 需要注意的是,网络上可能存在非法或不道德的应用程序ÿ…

深入了解JUnit 5:新一代Java单元测试框架

深入了解JUnit 5:新一代Java单元测试框架 近年来,Java领域的单元测试框架发展迅速,而JUnit 5作为JUnit系列的最新版本,为开发人员提供了更多的功能和灵活性。在本文中,我们将介绍JUnit 5,并探讨其与JUnit 4…

分享几个可以免费使用的GPT网站吧

1. ChatGAI ChatGAI是一个界面简洁的AI平台,提供App和网页版,每日均有免费使用机会。

2. ChatGPT 本网站向大家开放了ChatGPT 3.5和4.0版本的免费体验,特别适合新用户。每天都有免费次数,响应迅速,注册便捷࿰…

从零开始基于LLM构建智能问答系统的方案

本文首发于博客 LLM应用开发实践 一个完整的基于 LLM 的端到端问答系统,应该包括用户输入检验、问题分流、模型响应、回答质量评估、Prompt 迭代、回归测试,随着规模增大,围绕 Prompt 的版本管理、自动化测试和安全防护也是重要的话题&#x…

python一个请求chatgpt3.5模型例子

当然可以!你可以使用OpenAI的 openai.ChatCompletion.create() 方法来请求 ChatGPT 3.5 模型的回复。以下是一个使用Python进行请求的示例代码:

python

import openai# 设置OpenAI API的访问密钥

openai.api_key YOUR_API_KEY# 发送请求给ChatGPT模型

…

解锁未来:大模型GPT的应用架构与创新实践

在人工智能的黄金时代,大模型如GPT(Generative Pre-trained Transformer)已成为技术创新和应用发展的前沿。它不仅重新定义了人机交互的方式,还在多个领域内展现出了巨大的应用潜力。本文将深入探讨大模型GPT的应用架构࿰…

掌握ChatGPT润色绝技:什么是人工智能写作以及如何使用它来完成写作任务

如对AI写论文感兴趣,欢迎添加作者wx讨论 : ryan_2982 人工智能 (AI) 的出现开创了技术进步的新时代,彻底改变了包括写作和内容创作在内的各个行业。人工智能写作和人工智能提示已成为可以简化和增强写作任务的强大工具。在这篇博文中,我们将…

ChatGPT4 VS ChatGPT3.5:揭秘人工智能语言模型的技术革新

摘要:本文将详细介绍ChatGPT4与ChatGPT3.5之间的关键技术差异,解析为何ChatGPT4在诸多方面超越了ChatGPT3.5,以及这一领域的未来发展趋势。 一、引言 随着人工智能和自然语言处理技术的不断发展,智能对话机器人成为了越来越多人的…

GPT3.5+文心一言+chatGLM 计算和代码生成能力简单对比

chatGLM3刚发布(10.27),打算尝试一下其code和计算能力。

共选取三个问题,难度从中等,偏困难,到困难。测试内容是正好手头上在做的事想让LLM来完成(偷懒),之前都是直接使…

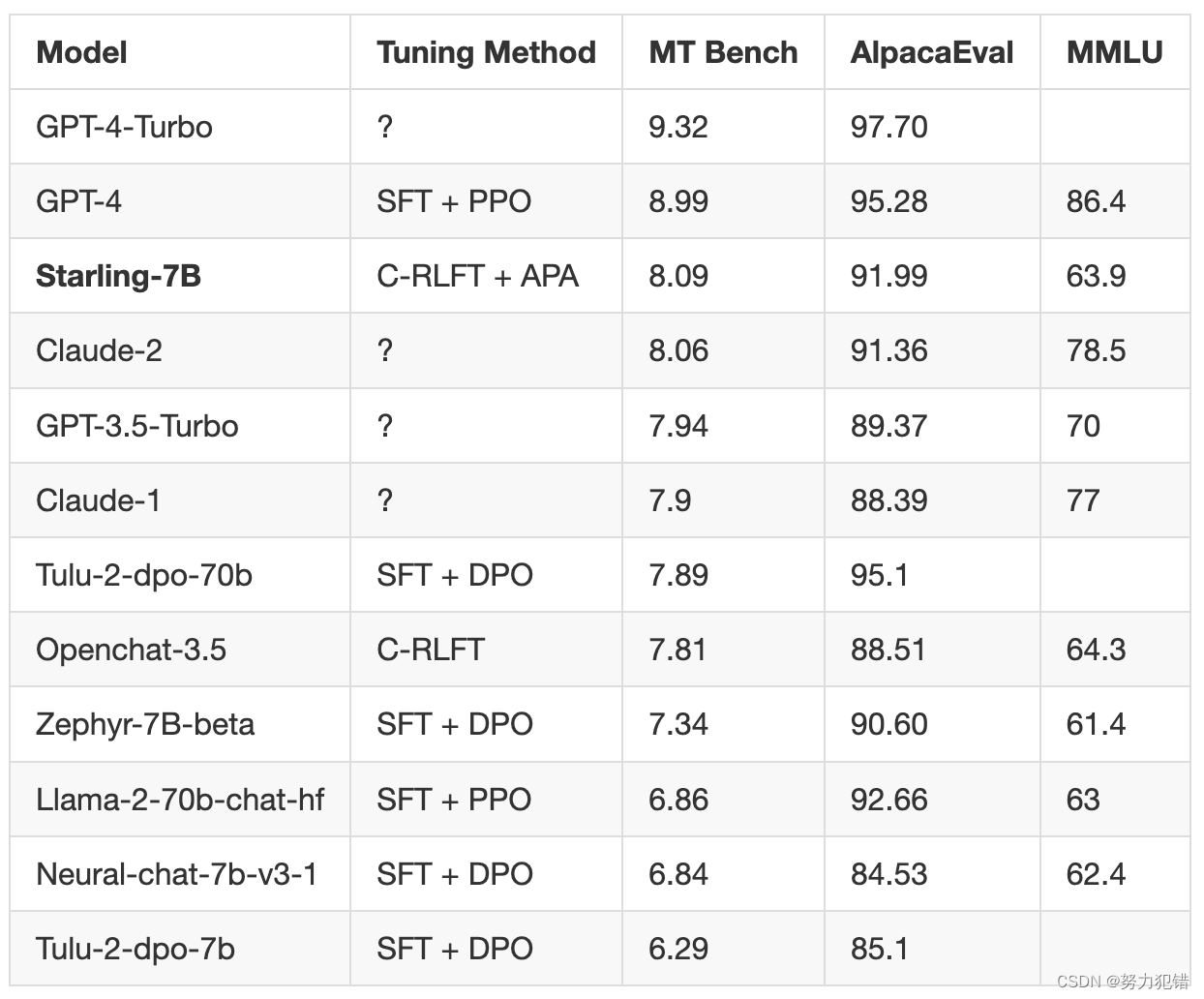

Starling-LM-7B与GPT-4:开源AI的新纪录

引言

在人工智能的前沿领域,Starling-LM-7B的出现标志着开源大型语言模型(LLM)的一大突破。与GPT-4的近距离竞争不仅展示了Starling-LM-7B的技术实力,也突显了开源社区在推动AI发展方面的重要作用。

模型特点

Starling-LM-7B&a…

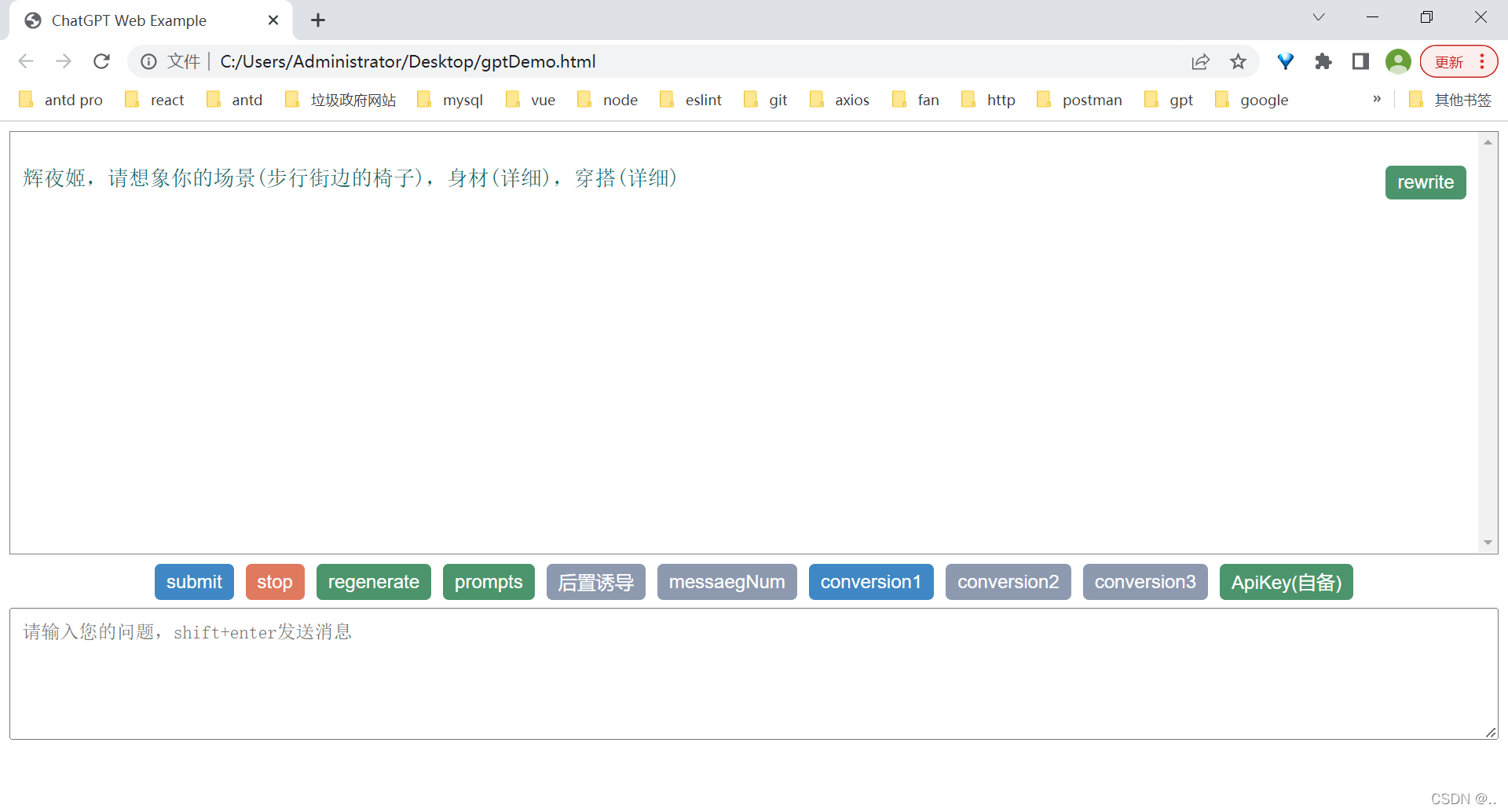

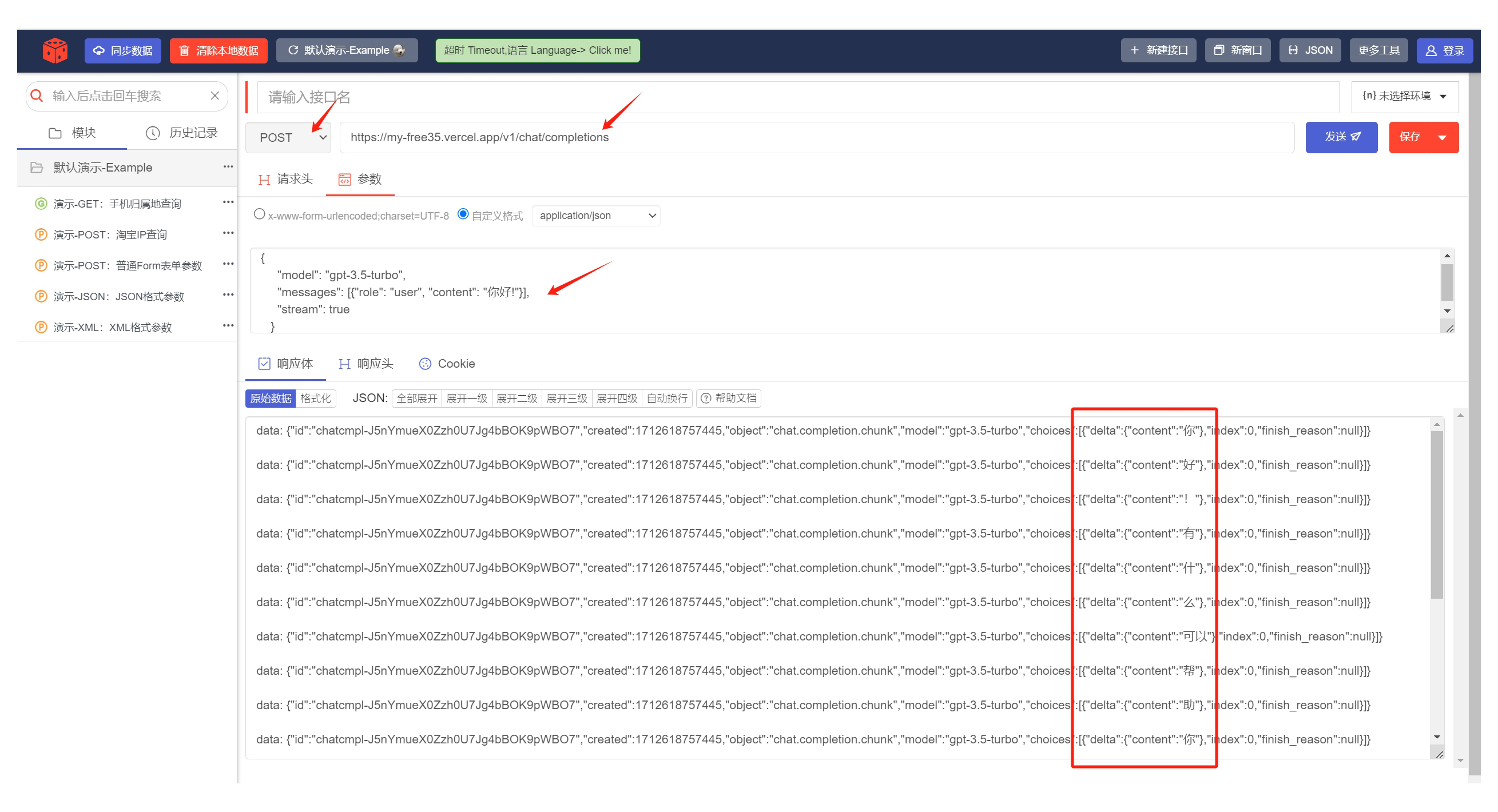

js调用gpt3.5(支持流回显、高频功能)

参考链接:直接在前端调用 GPT-3 API

效果图: 查看在线demo(要梯子)

注意: 1. 需要apiKey,自用安全,不要给别人 2. 需要梯子 3. 选择稳定、人少的代理ip 4. 不要频繁切换ip,防止封号 5. api调用上限高&…

研究揭示OpenAI GPT-3.5-Turbo模型参数量可能只有7B

加利福尼亚州,洛杉矶 - 一项由南加州大学计算机科学系的研究人员进行的新研究,通过创新的数学方法,对OpenAI公司的最新语言模型GPT-3.5-Turbo的内部结构进行了深入分析。研究团队通过一系列精心设计的“暴力提问”实验,成功地估计…

OpenAI的语言生成器GPT-3受到了广泛关注。

OpenAI的第三代语言生成器GPT-3备受关注

概述

OpenAI,一家由Peter Thiel、Elon Musk、Reid Hoffman、Marc Benioff和Sam Altman等知名人士支持的非营利人工智能研究公司,最近发布了其第三代语言预测模型GPT-3。GPT-3的发布受到了早期用户的高度关注。 …

【LangChain学习】基于PDF文档构建问答知识库(三)实战整合 LangChain、OpenAI、FAISS等

接下来,我们开始在web框架上整合 LangChain、OpenAI、FAISS等。 一、PDF库

因为项目是基于PDF文档的,所以需要一些操作PDF的库,我们这边使用的是PyPDF2

from PyPDF2 import PdfReader# 获取pdf文件内容

def get_pdf_text(pdf):text "…

ChatGpt3.5已经应用了一段时间,分享一些自己的使用心得.

首先ChatGpt3.5的文本生成功能十分强大,但是chatgpt有一些使用规范大家需要注意,既然chat是一种工具,我们就需要学会它的使用说明,学会chatgpt的引用语句,会极大的方便我们的使用。我们需要做以下的准备。 明确任务和目…

如何入门 GPT 并快速跟上当前的大语言模型 LLM 进展?

入门GPT

首先说第一个问题:如何入门GPT模型?

最直接的方式当然是去阅读官方的论文。GPT模型从2018年的GPT-1到现在的GPT-4已经迭代了好几个版本,通过官方团队发表的论文是最能准确理清其发展脉络的途径,其中包括GPT模型本身和一…

Chatbox - 一款适用于 GPT-4 / GPT-3.5 (OpenAI API) 的桌面应用程序

简介

给大家推荐一款适用于 GPT-4 / GPT-3.5 (OpenAI API) 的桌面应用程 ChatBox,开源的 ChatGPT API (OpenAI API) 跨平台桌面客户端,Prompt 的调试与管理工具,也可以用作 ChatGPT Plus 平替。

下载

► chatBox 下载安装 ⇲

为什么不直接…

ChatGPT⼊门到精通(7):GPT3.5与 4.0区别

⼀、详细区别

1 项⽬ GPT3.5 GPT4.0 2 打字速度 较慢,⾼峰期更慢 更加慢,差别不⼤ 3 掉线⼏率 经常掉线 很少掉线 4 分段能⼒ ⽣成⼏百字后就停⽌了, 需要回复“继续”,有时候不 是很连贯 基本连贯 5 使⽤限制 1⼩时100次提问&am…

如何使用免费的ChatGpt3.5

如何使用免费的ChatGpt 最近免费的gpt3.5很多都不怎么行了实在是太给力了尾声 最近免费的gpt3.5很多都不怎么行了

原因是什么呢?因为openai已经取消了免费的5刀赠送,那么这些人手上的免费的sses-key 用完后,就基本上全军覆没了,再…

智能革命:ChatGPT3.5与GPT4.0的融合,携手DALL·E 3和Midjourney开启艺术新纪元

迷图网(kk.zlrxjh.top)是一个融合了顶尖人工智能技术的多功能助手,集成了ChatGPT3.5、GPT4.0、DALLE 3和Midjourney等多种智能系统,为用户提供了丰富的体验。以下是对这些技术的概述: ChatGPT3.5是由OpenAI开发的一个自然语言处理模型&#x…

GPT3, llama2, InternLM2技术报告对比

GPT3(September 22, 2020)是大语言应用的一个milestone级别的作品,Llama2(February 2023)则是目前开源大模型中最有影响力的作品,InternLM2(2023.09.20)则是中文比较有影响力的作品。…

【大模型】自动化问答生成:使用GPT-3.5将文档转化为问答对

自动化问答生成:使用GPT-3.5将文档转化为问答对 正文步骤1:准备工作步骤2:编写Python脚本 总结 当我们需要将大段文档转化为问答对时,OpenAI的GPT-3.5模型提供了一个强大的工具。这个教程将向您展示如何编写一个Python脚本&#x…

关于问gpt-3.5-turbo的一些网络知识,tcp/ip,物理层,数据链路层,网络层,传输层,应用层

文章目录问:你怎么向一个12岁小孩解释tcp/ip?问:继续问:物理层是怎么传输数据的?问:数据链路层是怎么传输数据的?问:继续问:继续问:网络层是怎么传输数据的?…

基于GPT3.5逆向 和 本地Bert-Vits2-2.3 的语音智能助手

文章目录 一、效果演示二、操作步骤三、架构解析 一、效果演示

各位读者你们好,我最近在研究一个语音助手的项目,是基于GPT3.5网页版的逆向和本地BertVits2-2.3 文字转语音,能实现的事情感觉还挺多,目前实现【无需翻墙࿰…

GPT-3.5 人工智能还是人工智障?——西红柿炒钢丝球!!

人工智能还是人工智障?——西红柿炒钢丝球 西红柿炒钢丝球的 基本信息西红柿炒钢丝球的 详细制作方法材料步骤 备注幕后花絮。。。。。。。。。关于GPT-3.5,你的看法: 西红柿炒钢丝球的 基本信息

西红柿炒钢丝球是一道具有悠久历史的传统中式…

传奇设计师 Jony Ive 正在设计人工智能硬件

据报道,萨姆奥尔特曼 (Sam Altman) 和传奇设计师 乔尼艾维 (Jony Ive) 已聘请苹果公司即将卸任的 iPhone 设计主管来为一家人工智能消费硬件初创公司工作。 这家初创公司 LoveFrom 仍处于早期阶段,但旨在为家庭打造先进的人工智能产品。

苹果公司前产品…

深度强化学习(DRL)算法系列文章合集

1. 深度强化学习(DRL)算法 1 —— REINFORCE

2. 深度强化学习(DRL)算法 2 —— PPO 之 Clipped Surrogate Objective 篇

3. 深度强化学习(DRL)算法 2 —— PPO 之 GAE 篇

4. 深度强化学习(DR…

人类 vs AI:玩梗大作战,看看谁是最后的赢家?

能解释人类玩梗的 AI 究竟能多大程度地理解人类的「梗」? 五一假期就在眼前,LigaAI 小编每天都在「调休好烦」和「快放假啦」两种情绪间反复横跳,还会忍不住思考「AI 能不能理解调休和放假的情绪差异?」(一些精神世界高…

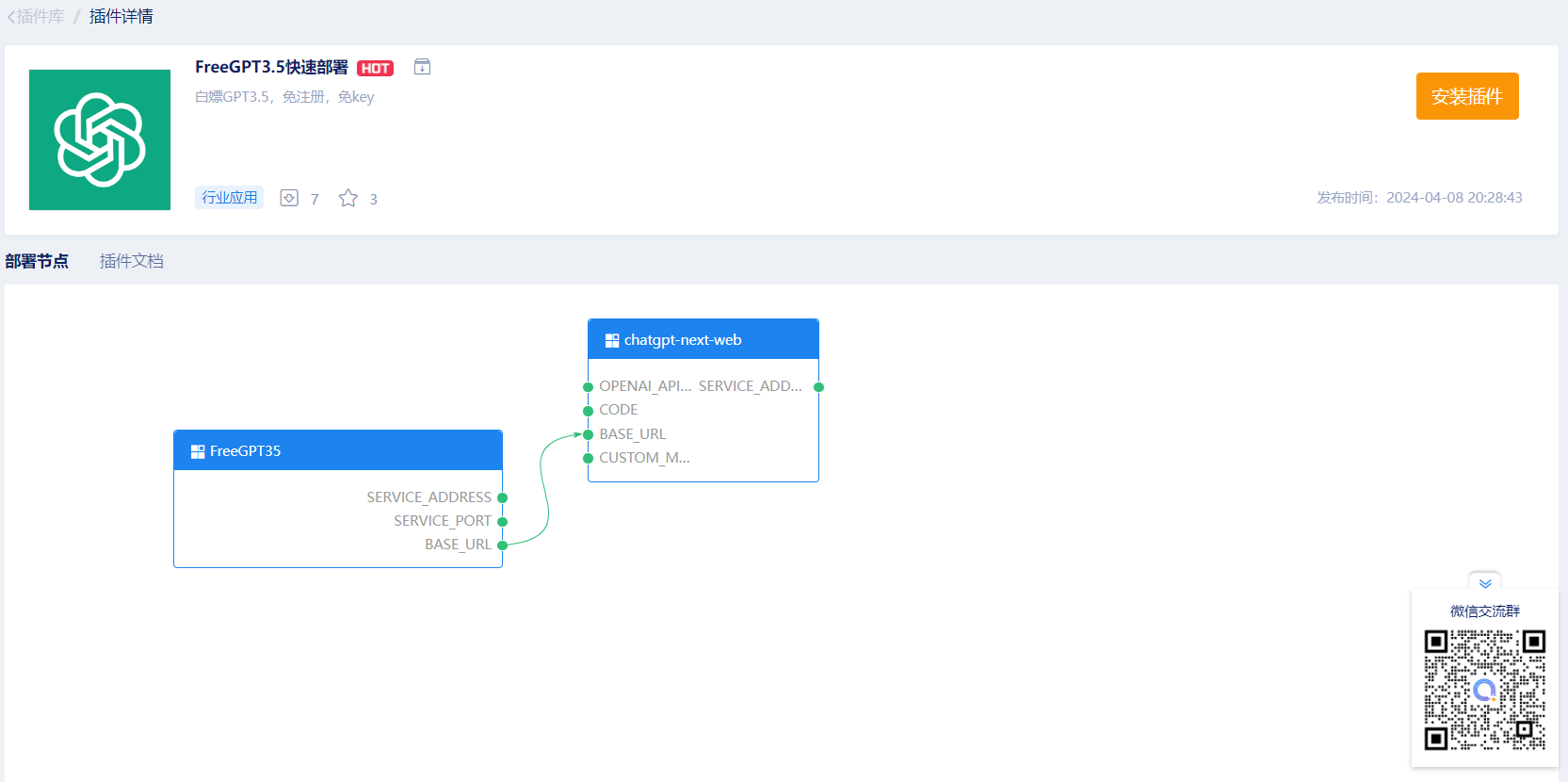

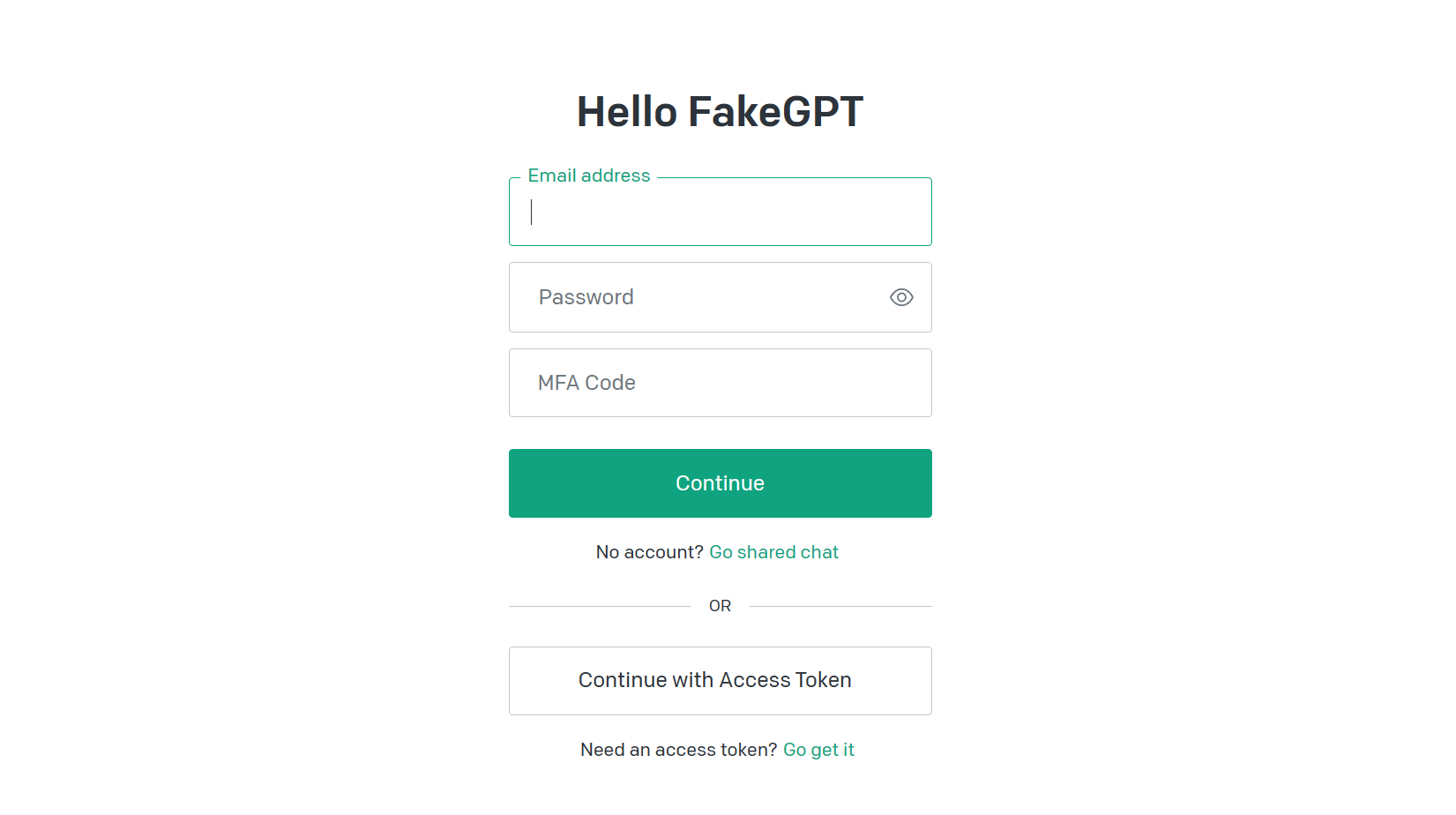

FreeGPT3.5 开源软件

GPT-3.5不需要付费,也不需要注册用户,可以直接使用了,官方彻底开放了API接口。 该API政策一放开,GitHub很快就已经出现了一个开源项目FreeGPT35,可以自动生成key调用GPT3.5的API接口,再也用不着注册账号和申…

二、OpenAI开发者快速入门

启动并运行OpenAI API OpenAI API 为开发者提供一个简单的接口,使其能够在他们的应用中创建一个智能层,由OpenAI最先进的模型提供支持。聊天补全端点为ChatGPT提示支持,一种简单的方法是:输入文本,使用GPT-4模型输出。…

【李沐论文精读】GPT、GPT-2和GPT-3论文精读

论文: GPT:Improving Language Understanding by Generative Pre-Training GTP-2:Language Models are Unsupervised Multitask Learners GPT-3:Language Models are Few-Shot Learners 参考:GPT、GPT-2、GPT-3论文精读…

使用开源项目FreeGPT35来免费调用ChatGPT3.5 API

从今年的4月2号开始GPT 3.5 不用注册、不用登录就能直接访问了,而且官方还放开了API的政策。在官方放开政策之后,github上出现了开源项目FreeGPT35能直接调用 3.5 的 API,而且是免费的,非常方便。从原理上看,FreeGPT35…

搭建个让你呼吸顺畅-ChatGPT

目录

ChatGPT使用时可能会遇到

1.请待命,我们正在检查您的浏览器...

2. 访问被拒绝。抱歉,您已被阻止

3. ChatGPT 目前已满负荷运转

4. 此内容可能违反我们的内容政策。

5.出了点问题。

6. 蹦字慢吞吞,卡顿不流畅,不知道的…

吉良吉影狂喜!HandRefiner:一种可以有效修正畸形手部图像的技术

这种方法首先使用深度学习模型从图片中识别出手部区域。然后它将手部 crops 出来,并利用一个生成对抗网络试图生成一个更加符合人体工学标准的手部形状。

GitHub:https://github.com/wenquanlu/HandRefiner/ 论文:https://arxiv.org/abs/231…

正则表达式匹配算法详解(由ChatGPT-3.5生成)

正则表达式匹配算法详解

该博客由ChatGPT-3.5生成。

正则表达式匹配是一道经典的算法问题,要求实现一个支持 ‘.’ 和 ‘*’ 的正则表达式匹配功能。在本篇博客中,我们将详细介绍该算法的解题思路以及使用C语言实现的代码。

问题描述

给定一个字符串…

LLM RAG系统中消除数据幻觉的几个绝招-OPENAI公司内称的“大招”

前言-什么是数据幻觉?它到底有什么危害呢

我们直接来举例:

我是金银花一区的,附近有什么小学?

此时RAG带出如下信息:

金银花小区一区、二区、三区附近教育资源有:银树大学、建设小学金银花校区、金树高…

【LangChain学习】基于PDF文档构建问答知识库(一)前期准备

这系列主要介绍如何使用LangChain大模型,结合ChatGPT3.5,基于PDF文档构建专属的问答知识库。 一、 环境搭建

LangChain 和 OpenAI 本身可支持 Nodejs 和 Python 两个版本,笔者后续的介绍主要用到Python版本,如果有需要Nodejs版本…

校验 GPT-4 真实性的三个经典问题:快速区分 GPT-3.5 与 GPT-4

现在已经有很多 ChatGPT 的套壳网站,以下分享验明 GPT-4 真身的三个经典问题,帮助你快速区分套壳网站背后到底用的是 GPT-3.5 还是 GPT-4。 大家可以在这个网站测试:https://ai.hxkj.vip,免登录可以问三条,登录之后无限…

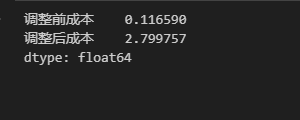

GPT3.5 改用 GPT4 价格翻了30倍 如何破局? GPT 对话成本推演

场景介绍

假设你搭建了一个平台,提供 ChatGPT 3.5 的聊天服务。目前已经有一批用户的使用数据,想要测算一下如果更换 GPT 4.0 服务需要多少成本?

方案阐述

如果是全切,最简单粗暴的方案就是根据提供 ChatGPT 3.5 消费的金额乘…

大语言模型的开山之作—探秘GPT系列:GPT-1-GPT2-GPT-3的进化之路

模型模型参数创新点评价GPT1预训练微调, 创新点在于Task-specific input transformations。GPT215亿参数预训练PromptPredict, 创新点在于Zero-shotZero-shot新颖度拉满,但模型性能拉胯GPT31750亿参数预训练PromptPredict, 创新点…

11个AI写作软件工具!知名4A广告公司蓝标宣布停止文案外包!

AI的这场熊熊大火,终于还是烧到了广告界!

2023年4月12日,是一个再普通不过的日子,但这一天会被很多人记住。不是因为席卷整个华北区的漫天黄沙,而是因为一封代表着AI势不可挡的决心和象征着一个行业巨变拉开序幕的邮件…

GPT-3后的下一步:大型语言模型的未来方向

摘要:

本文将概述GPT-3后的下一步:大型语言模型的未来方向,包括技术发展趋势、应用场景、挑战与机遇。

引言:

GPT-3是OpenAI于2020年发布的一款大型语言模型,它在自然语言处理领域取得了突破性进展。GPT-3的出现标志…

<2024最新>ChatGPT逆向教程

前言

在使用本篇文章用到的项目以及工具时,需要对其有一定的了解,无法访问以及无法使用的问题作者不承担任何责任,可以自行想办法解决遇到的问题。

文章若有不合适,有问题的地方,请私聊指出,谢谢~ 准备工具 一台至少 2 核 2G 内存的服务器,推荐是位于香港、新加坡或…

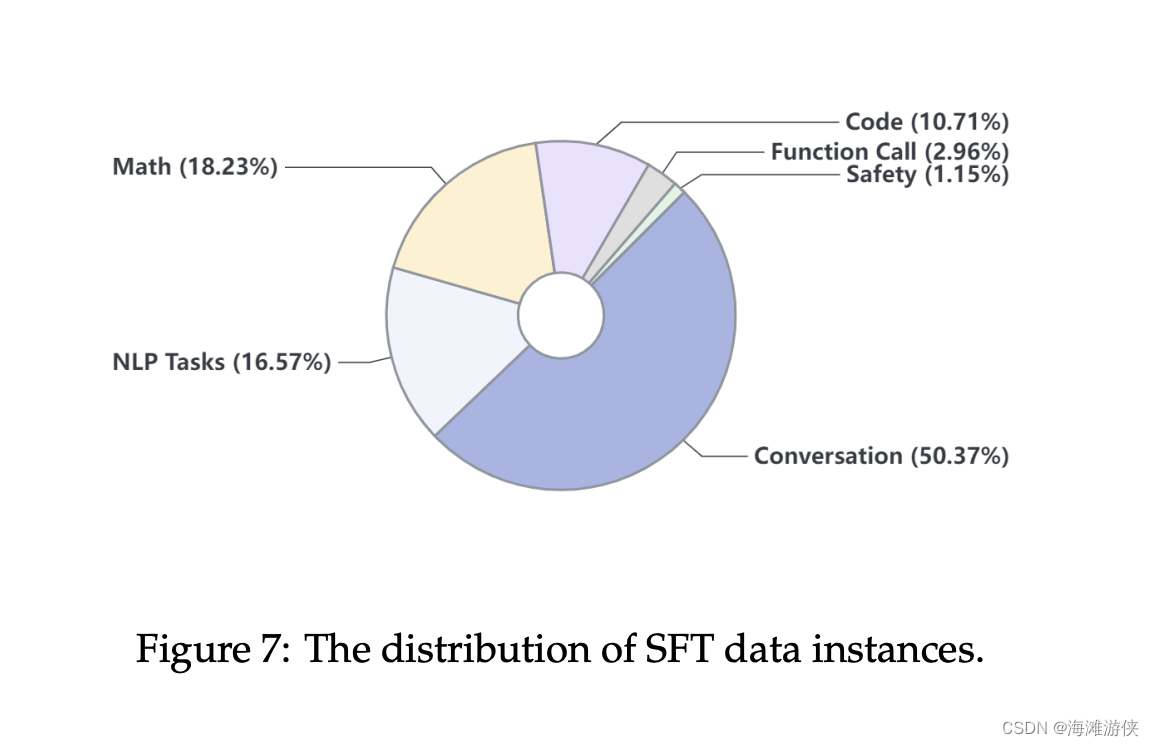

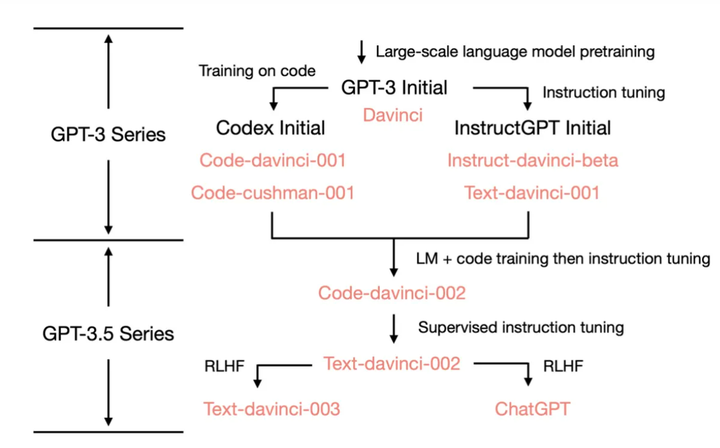

Bytedance揭秘OpenAI大模型: GPT-3到GPT-4进化路径

文章目录 探秘GPT-3到GPT-4进化之路1、SFT:早期GPT进化的推动者2、RLHF和SFT:编码能力提升的功臣3、代码加入预训练,对推理帮助最大4、“跷跷板”现象 论文地址项目链接Reference GPT-Fathom: Benchmarking Large Language Models to Deciphe…

ChatGPT追祖寻宗:GPT-3技术报告要点解读

论文地址:https://arxiv.org/abs/2005.14165 往期相关文章: ChatGPT追祖寻宗:GPT-1论文要点解读_五点钟科技的博客-CSDN博客ChatGPT追祖寻宗:GPT-2论文要点解读_五点钟科技的博客-CSDN博客 本文的标题之所以取名技术报告而不是论文…

使用Docker部署开源项目FreeGPT35来免费调用ChatGPT3.5 API

Vercel部署FreeGPT35有严重限制,玩玩就好,真用还是得docker。 限制原因: Vercel的流式响应并不是一开始写流,客户端就能立刻收到响应流,而是先写到一个缓冲区,当流关闭才一股脑的流式响应回来(不是实时流) 因此导致: …

gpt4.0和3.5区别在哪里:什么样的人适合使用gpt4.0?

GPT-4和GPT-3.5相比,就像是智能手机的新一代和上一代。升级了,功能多了,但核心都是让你的工作和生活更便捷。

联网能力

GPT-3.5:与世隔绝,不联网。 GPT-4:5月17日后能上网浏览,信息获取能力加…

OpenAI深夜放毒:发布GPT-4新模型,GPT-3.5支持16K上下文,并且价格降低75%

一觉起来,发现OpenAI Twitter更新了,而且更新力度很大,这真是深夜放毒。 下面我们看下OpenAI本次的重大更新都有哪些? 函数调用能力 在Chat Completions API中引入了新的功能调用能力。gpt-4-0613和gpt-3.5-turbo-0613版本已进行了…

大模型学习篇(一):初识大模型

目录

一、大模型的定义

二、大模型的基本原理与特点

三、大模型的分类

四、大模型的相关落地产品

五、总结 一、大模型的定义 大模型是指具有数千万甚至数亿参数的深度学习模型。大模型具有以下特点:

参数规模庞大:大模型的一个关键特征是其包含了…

游戏版 ChatGPT,要用 AI 角色完善生成工具实现 NPC 自由

微软与 AI 初创公司 Inworld 合作,推出基于 AI 的角色引擎和 Copilot 助理,旨在提升游戏中 NPC 的交互力和生命力,提升游戏体验。Inworld 致力于打造拥有灵魂的 NPC,通过生成式 AI 驱动 NPC 行为,使其动态响应玩家操作…

[AI]ChatGPT4 与 ChatGPT3.5 区别有多大

ChatGPT 3.5 注册已经不需要手机了,直接邮箱认证就可以,这可真算是好消息,坏消息是 ChatGPT 4 还是要收费。 那么 GPT-3.5 与 GPT-4 区别有多大呢,下面简单测试一下。

以从 TDengine 订阅数据为例,TDengine 算是不太小…

大模型扫盲之小白入门手记

本篇内容来自小米集团数据科学部负责人刘汉武老师的数据特训营笔记。不涉及深入的知识,仅在扫盲。 首先一个问题:大模型和大语言模型的区别是什么? 有人说大模型像是连接数据的星辰,能给我们提供前所未有的见解和洞察。现有的大模…

51-15 视频理解串讲—TimeSformer论文精读

今天读的论文题目是Is Space-Time Attention All You Need for Video Understanding?

Facebook AI提出了一种称为TimeSformer视频理解的新架构,这个架构完全基于transformer,不使用卷积层。它通过分别对视频的时间和空间维度应用自注意力机制ÿ…

LangChain源码逐行解密之prompts(三)

LangChain源码逐行解密之prompts semantic_similarity.py源码逐行剖析 LengthBasedExampleSelector类比较简单,我们看一下semantic_similarity.py具体是怎么操作的。Gavin大咖微信:NLP_Matrix_Space semantic_similarity.py的代码实现:

1. """基于SemanticS…

ChatGPT提示词(最新)

它能干什么?

包括但不限于:

类别描述学术论文它可以写各种类型的学术论文,包括科技论文、文学论文、社科论文等。它可以帮助你进行研究、分析、组织思路并编写出符合学术标准的论文。创意写作它可以写小说、故事、剧本、诗歌等创意性的文学作品&#…

用php语言写一个chatgpt3.5模型的例子

当然可以!使用PHP语言调用OpenAI API与ChatGPT-3.5模型进行交互。首先,确保你已经安装了PHP 7.2或更新版本,并具备可用的OpenAI API密钥。

下面是一个基本的PHP示例,展示了如何使用OpenAI API与ChatGPT-3.5模型进行对话ÿ…

解析ChatGPT Plus相比chatgpt3.5有哪些优势

「ChatGPT Plus」提供更出色的对话体验和更广泛的应用能力,学生可以用来写作、职场人也可以用来写计划书、策划书等等,并且问它一些问题比搜索引擎好用多了简直。但普通人使用起来有一点门槛,并且升级4.0也难住了许多爱好者。 ChatGPT主要功能…

【chatGPT】API 即将来临,GPT-3 不等同于chatGPT,chatGPT收费了?

今天的人工智能系统具有令人印象深刻但范围有限的能力。 似乎我们会不断削弱它们的限制,在极端情况下,它们几乎可以在每一项智力任务上达到人类的水平。 很难想象人类水平的人工智能能给社会带来多大的好处,同样也很难想象如果构建或使用不当…

【LangChain学习】基于PDF文档构建问答知识库(二)创建项目

这里我们使用到 fastapi 作为项目的web框架,它是一个快速(高性能)的 web 框架,上手简单。 一.创建 FastAPI 项目

我们在IDE中,左侧选择 FastAPI ,右侧选择创建一个新的虚拟环境。 创建成功,会有…

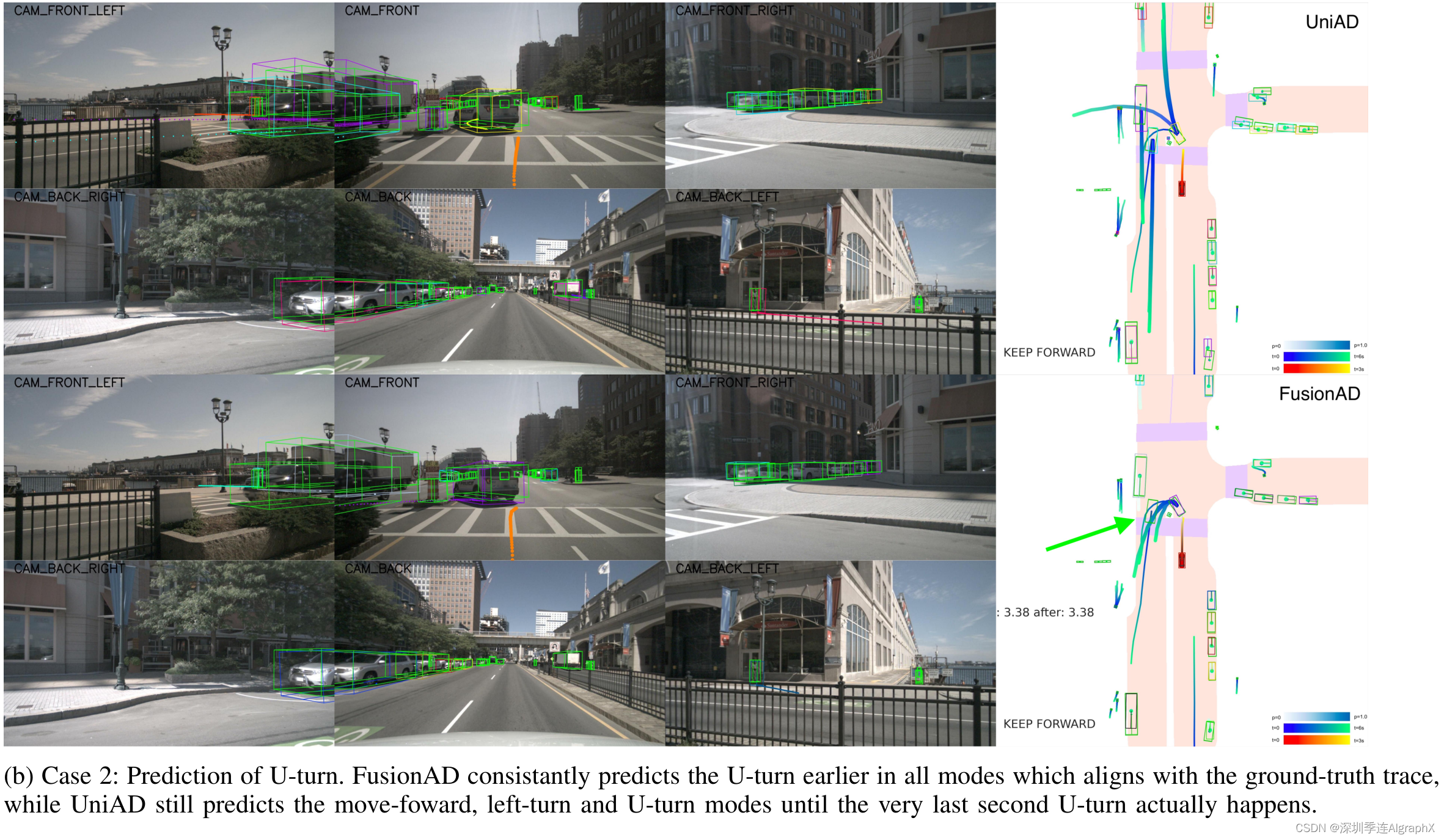

51-16 FusionAD 用于自动驾驶预测与规划任务的多模态融合论文精读

今天要分享的是基于BEV的多模态、多任务、端到端自动驾驶模型FusionAD,其专注于自动驾驶预测和规划任务。这项工作首次发表于2023年8月2日,性能超越了2023 CVPR最佳论文UniAD模型。论文题目是FusionAD: Multi-modality Fusion for Prediction and Planni…

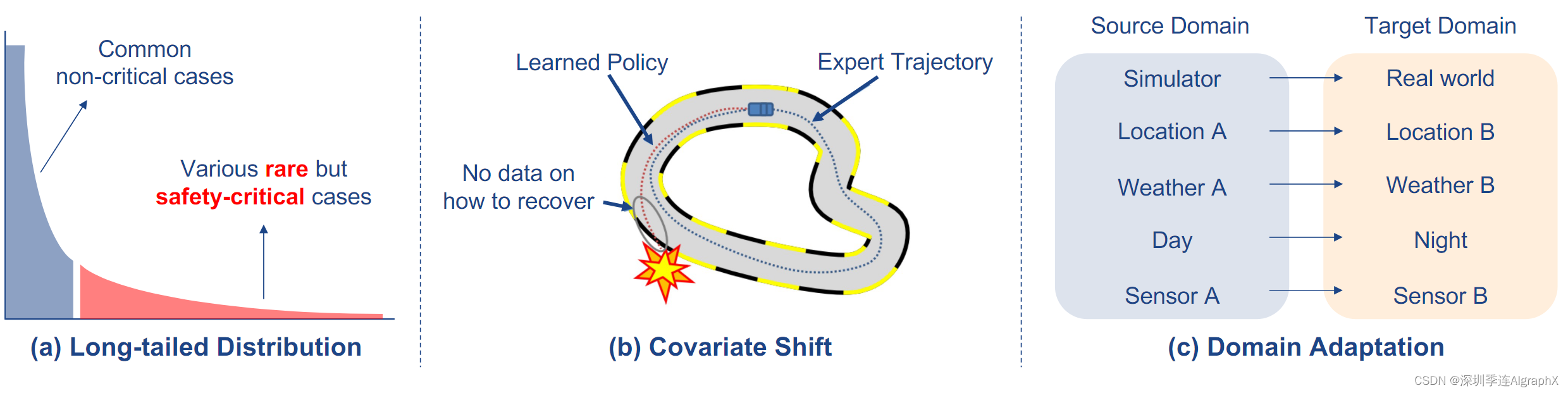

51-2 万字长文,深度解读端到端自动驾驶的挑战和前沿

去年初,我曾打算撰写一篇关于端到端自动驾驶的文章,发现大模型在自动驾驶领域的尝试案例并不多。遂把议题扩散了一点,即从大模型开始,逐渐向自动驾驶垂直领域靠近,最后落地到端到端。这样需要阐述的内容就变成LLM基础模…

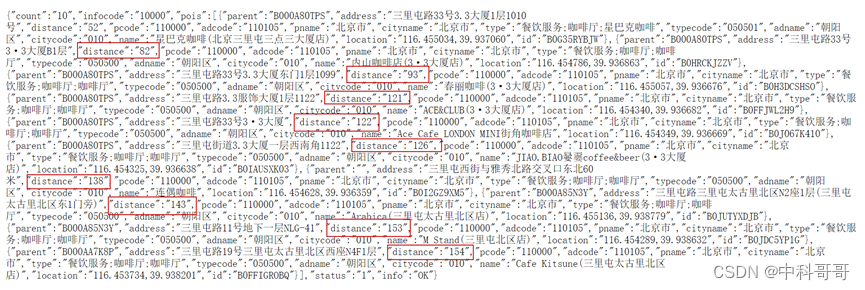

ChatGPT 结合实际地图实现问答式地图检索功能基于Function calling

ChatGPT 结合实际地图实现问答式地图检索功能基于Function calling

ChatGPT结合实际业务,主要是研发多函数调用(Function Calling)功能模块,将自定义函数通过ChatGPT 问答结果,实现对应函数执行,再次将结果…

5个超实用GPT技巧,包括绩效总结、头脑风暴、营销策略等(内附提示词)

今天和大家分享5个用于工作上的GPT技巧,例如进行绩效总结、自我评估、头脑风暴,还是制作PPT方案等等,最大化提升你工作效率,本期内容对于大家来说都非常受用,记得收藏起来哦! 那么接下来就直接进入正题吧&a…

GPT实战系列-搭建LangChain流程简单应用

GPT实战系列-搭建LangChain流程简单应用

LLM大模型:

GPT实战系列-探究GPT等大模型的文本生成

GPT实战系列-Baichuan2等大模型的计算精度与量化

GPT实战系列-GPT训练的Pretraining,SFT,Reward Modeling,RLHF

GPT实战系列-Chat…

GPT-3.5发布:大型语言模型的进化与挑战

摘要:

GPT-3.5是OpenAI于2023年发布的一款大型语言模型,它是GPT-3的升级版,拥有1750亿个参数,比GPT-3的参数量增加了近一倍。GPT-3.5在文本生成、对话系统、文本理解等任务上表现出色,其性能已经接近甚至超过了人类水…

智障版本GPT3实现

背景,实现GPT3,采用python代码。调库hf及tf2.0+基础。

由于完全实现GPT模型及其预训练过程涉及大量的代码和计算资源,以下是一个基于TensorFlow 2.x的简化版GPT模型构建和调用的示例。请注意,这仅展示了模型的基本结构,实际运行需替换为真实数据集和预处理步骤,且无法直…

Principled Instructions Are All You Need for Questioning LLaMA-1/2, GPT-3.5/4

Principled Instructions Are All You Need for Questioning LLaMA-1/2, GPT-3.5/4 相关链接:arxiv 关键字:Questioning LLaMA、GPT-3.5/4、guiding principles、prompting、large language models 摘要

本文介绍了26个旨在简化查询和提示大型语言模型&…

一个GPT3.5调教出来的下雪特效代码

第一次:HTML 背景下雪特效

代码:

<!DOCTYPE html>

<html lang"en">

<head><meta charset"UTF-8"><meta name"viewport" content"widthdevice-width, initial-scale1.0"><st…

Chatgpt训练使用的模拟人脑神经元网络

目前模拟人脑神经元的网络主要有以下几种: 人工神经网络(Artificial Neural Network,ANN):ANN是一种基于人脑神经元结构和功能的计算模型,包括前馈神经网络、反馈神经网络、自组织神经网络等。 脉冲神经网…

重塑语言智能未来:掌握Transformer,驱动AI与NLP创新实战

Transformer模型 Transformer是自然语言理解(Natural Language Understanding,NLU)的游戏规则改变者,NLU 是自然语言处理(Natural Language Processing,NLP)的一个子集。NLU已成为全球数字经济中AI 的支柱之一。

Transformer 模型标志着AI 新…

2023-RunwayML-Gen-2 AI视频生成功能发展历程

RunwayML是一个人工智能工具,它为设计师、艺术家和创意人士提供了一种简单的方式来探索和应用机器学习技术。

RunwayML官方网页地址:Runway - Advancing creativity with artificial intelligence.

RunwayML专区RunwayML-喜好儿aigcRunwayML 是一种先进…

GPT系列模型的特点

GPT系列模型(包括GPT-1、GPT-2和GPT-3)都基于自回归机制的Transformer架构。在设计上,这些模型的核心思想是利用Transformer架构来捕捉整个序列的上下文信息,通过其独特的自回归机制逐步地整合整个序列的完整语义。GPT系列模型的设…

RPA×IDP×AIGC,实在智能打造全新“超进化”文档审阅超自动化解决方案

企业商业活动频繁,每日都有大量文档被创建、书写、传递,需要人工审阅核查,以确保其准确性和合法性。这是对企业文档管理的一个巨大挑战,尤其对于金融机构、审计机构等文本相关岗位的工作人员来说更是如此。传统的文档审核通常需要…

gpt3.5写MATLAB代码剪辑视频,使之保留画面ROI区域

% 输入和输出文件名

inputVideoFile input_video.mp4;

outputVideoFile output_video.mp4;% 创建 VideoReader 和 VideoWriter 对象

videoReader VideoReader(inputVideoFile);

outputVideo VideoWriter(outputVideoFile, MPEG-4);

outputVideo.FrameRate videoReader.Fra…

国内免费AI还有哪些?真的好用吗?

国内AI网站涵盖了从基础研究到实际应用的多个方面,为用户提供了丰富的资源和服务。都是一些大厂的产品,同时使用也是方便快捷。

国内的网站总体来说的有点就是:

访问快捷,速度快,适合临时使用都有给好的提示词功能&a…

百川智能发布首个530亿参数闭源大模型,今年追上GPT-3.5

4月官宣创业,6月15日发布第一款7B开源模型,7月11日发布第二款13B、130亿参数开源模型。

平均保持2个月一个版本发布速度,8月8日,百川智能发布了创业以来的首个530亿参数闭源大模型——Baichuan-53B(以下简称“53B”&a…

GPT-1, GPT-2, GPT-3, InstructGPT / ChatGPT and GPT-4 总结

1. GPT-1

What the problem GPT-1 solve? 在 GPT-1 之前,NLP 通常是一种监督模型。 对于每个任务,都有一些标记数据,然后根据这些标记数据开发监督模型。 这种方法存在几个问题:首先,需要标记数据。 但 NLP 不像 CV&…

GPT-3 论文阅读笔记

GPT-3模型出自论文《Language Models are Few-Shot Learners》是OpenAI在2020年5月发布的。

论文摘要翻译:最近的工作表明,通过对大量文本进行预训练,然后对特定任务进行微调(fine-tuning),在许多NLP任务和基准测试上…

玩不了chatGPT,请来玩πChat吧!

关于ChatGPT,科技部发声了!ChatGPT是什么来的呢?ChatGPT是美国OpenAI公司研发的一款聊天机器人程序,它能够通过理解和学习人类的语言来进行对话,还能根据聊天的上下文进行互动,真正像人类一样来聊天交流&am…

调用GPT3接口的一些参数

GPT3接口

官方文档 API Reference

调用

temperature

通过设置合适的 temperature 值和观察每个 token 的概率,判断输出的确定性和可靠性,避免与直觉不符的结果。 在实际应用中,这两个参数非常有价值。聊天应用可设置较高 temperature 值&…

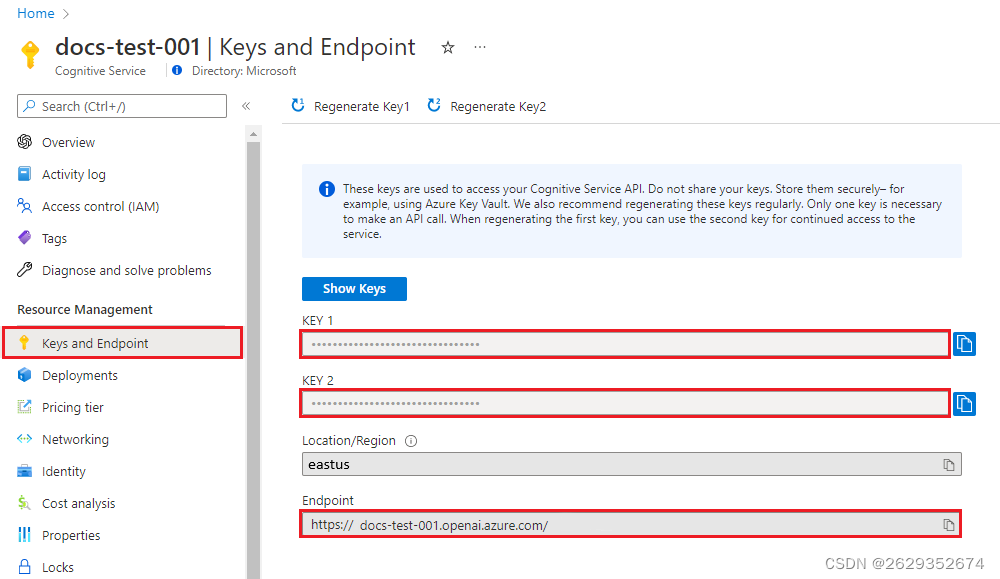

Spring boot + Azure OpenAI 服务 1.使用 GPT-35-Turbo

Azure OpenAI 服务使用 GPT-35-Turbo 先决条件

maven 注意 beta.6 版本 <dependency><groupId>com.azure</groupId><artifactId>azure-ai-openai</artifactId><version>1.0.0-beta.6</version></dependency>问答工具类

pack…

2024年最强人工智能AI软件,AI画画,AI写小说,一招帮你搞定

2024年也涌现出了非常多好用又强大的人工智能AI软件,AI画画,AI写小说,AI做翻译等等,分享自己今年最常用的几个AI工具,都是精品,欢迎点赞收藏~ 1、GitMind AI

网站直达:GitMind 思乎 - AI思维导…

gpt3、gpt2与gpt1区别

参考:深度学习:GPT1、GPT2、GPT-3_HanZee的博客-CSDN博客

Zero-shot Learning / One-shot Learning-CSDN博客 Zero-shot(零次学习)简介-CSDN博客 GPT-2 模型由多层单向transformer的解码器部分构成,本质上是自回归模型…

经验分享-如何使用http调用chatGPT-3.5-turbo模型API

今天上午,就在工作群里收到了关于openAI发布chatGPT官方模型的消息分享。openAI这次的动作真的很快啊,没想到这么快就直接发布了chatGPT目前所使用的模型api。据Open AI在官方消息,本次开放了ChatGPT和Whisper的模型API,可以供用户…

【ChatGPT+XMind超级详细的保姆级思维导图教程】

🚀 AI 🚀 🌲 算法刷题专栏 | 面试必备算法 | 面试高频算法 🍀 🌲 越难的东西,越要努力坚持,因为它具有很高的价值,算法就是这样✨ 🌲 作者简介:硕风和炜,CSDN…

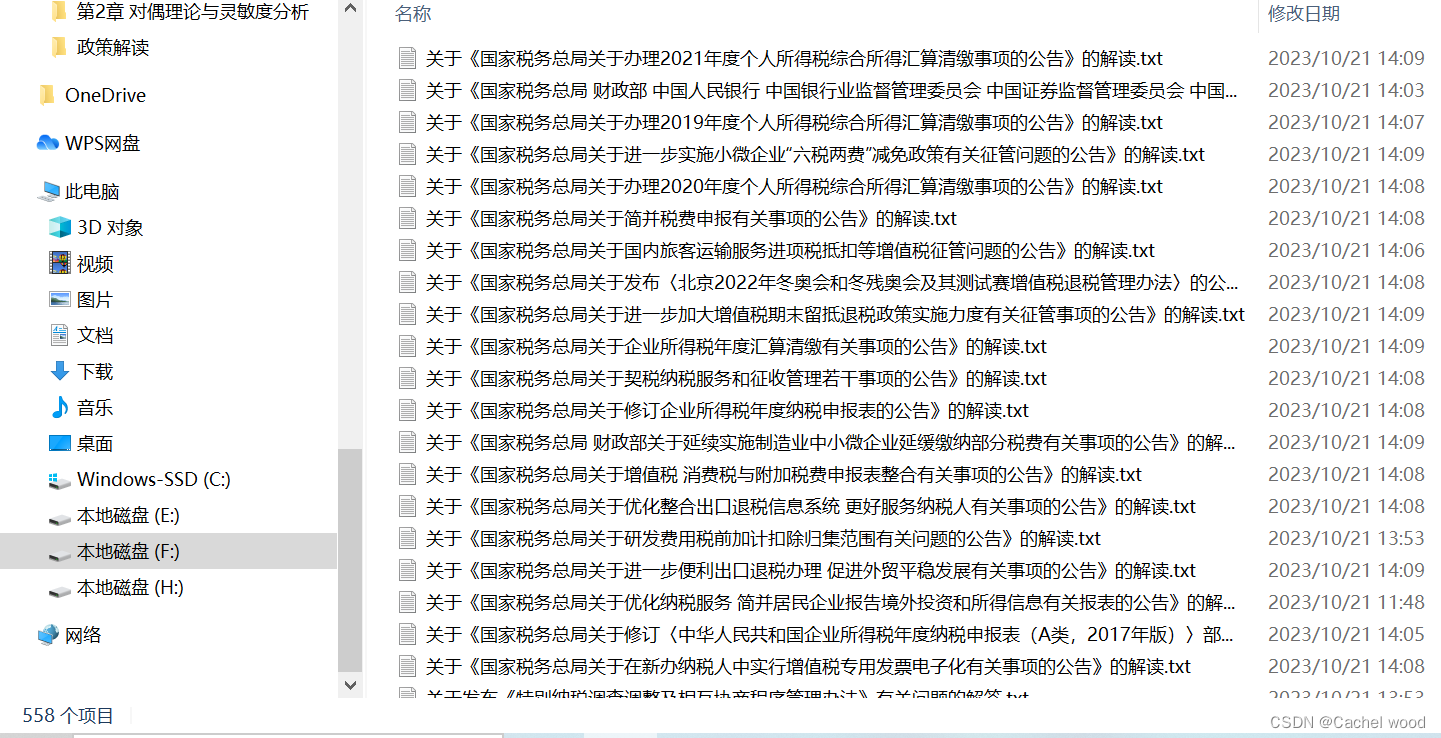

python requests爬取税务总局税案通报、税务新闻和政策解读

文章目录 环境配置页面爬取流程税案通报爬取code税务新闻爬取政策解读爬取 环境配置

python:3.7 requests:发出请求,返回页面 beautifulsoup:解析页面 time:及时 warnings:忽视警告

页面

网址࿱…

OpenAI推出GPT-3.5Turbo微调功能并更新API;Midjourney更新局部绘制功能

🦉 AI新闻

🚀 OpenAI推出GPT-3.5Turbo微调功能并更新API,将提供GPT-4微调功能

摘要:OpenAI宣布推出GPT-3.5Turbo微调功能,并更新API,使企业和开发者能够定制ChatGPT,达到或超过GPT-4的能力。通…

ChatGPT 现在可以看、听和说话了!

🌷🍁 博主猫头虎 带您 Go to New World.✨🍁 🦄 博客首页——猫头虎的博客🎐 🐳《面试题大全专栏》 文章图文并茂🦕生动形象🦖简单易学!欢迎大家来踩踩~🌺 &a…

ChatGPT技术原理解析:从RL之PPO算法、RLHF到GPT-N、instructGPT

写在最前面,23年2.27日起,我个人和十来位博士朋友精读100篇ChatGPT相关技术的论文(每天一篇,100天读完100篇,这100篇的论文清单附在本文最后),过程中几乎每天都会不断优化本文,优化记录见本文文末的“后记”…

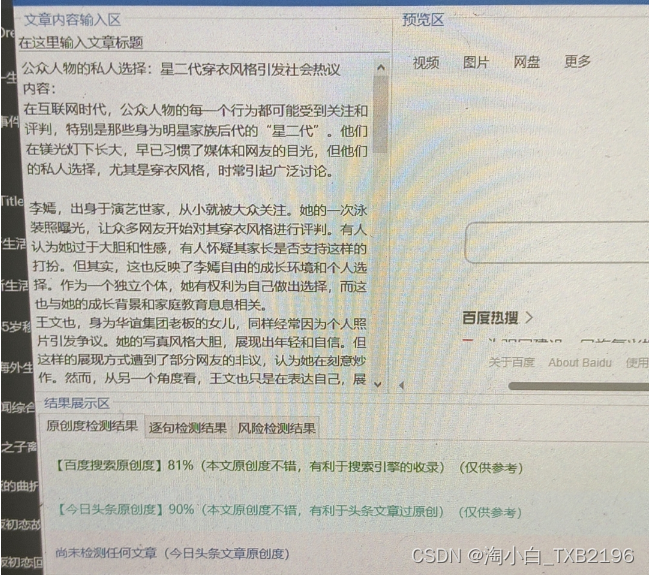

今日头条文章采集ChatGPT3.5/4.0驱动浏览器改写文章软件说明文档

大家好了,我是淘小白~

今天给大家介绍的软件是一个款驱动浏览器改写文章的软件,下面给大家做一下介绍说明:

一、软件语言

Python编写的,使用的库是selenium库

二、具体逻辑

1、整理头条文章网址,需要自己整理&…

基于GPT-3和DALL-E的原创漫画生成

我花了上个月的时间探索如何使用 OpenAI 的 GPT-3 文本生成器和他们的 DALL-E 图像到文本系统来创建新的漫画,而无需编写任何源代码。 请注意,这两个系统都处于测试阶段,在我用完所有免费代币后,它们开始收取象征性的使用费。 不过…

用 AI 编程-释放ChatGPT的力量

最近读了本书,是 Sean A Williams 写的,感觉上还是相当不错的。一本薄薄的英文书,还真是写的相当好。如果你想看,还找不到,可以考虑私信我吧。 ChatGPT for Coders Unlock the Power of AI with ChatGPT: A Comprehens…

预防GPT-3和其他复杂语言模型中的“幻觉”

标题:预防GPT-3和其他复杂语言模型中的“幻觉”

正文:

“假新闻”的一个显著特征是它经常在事实正确信息的环境中呈现虚假信息,通过一种文学渗透的方式,使不真实的数据获得感知权威,这是半真半假力量令人担忧的展示。…

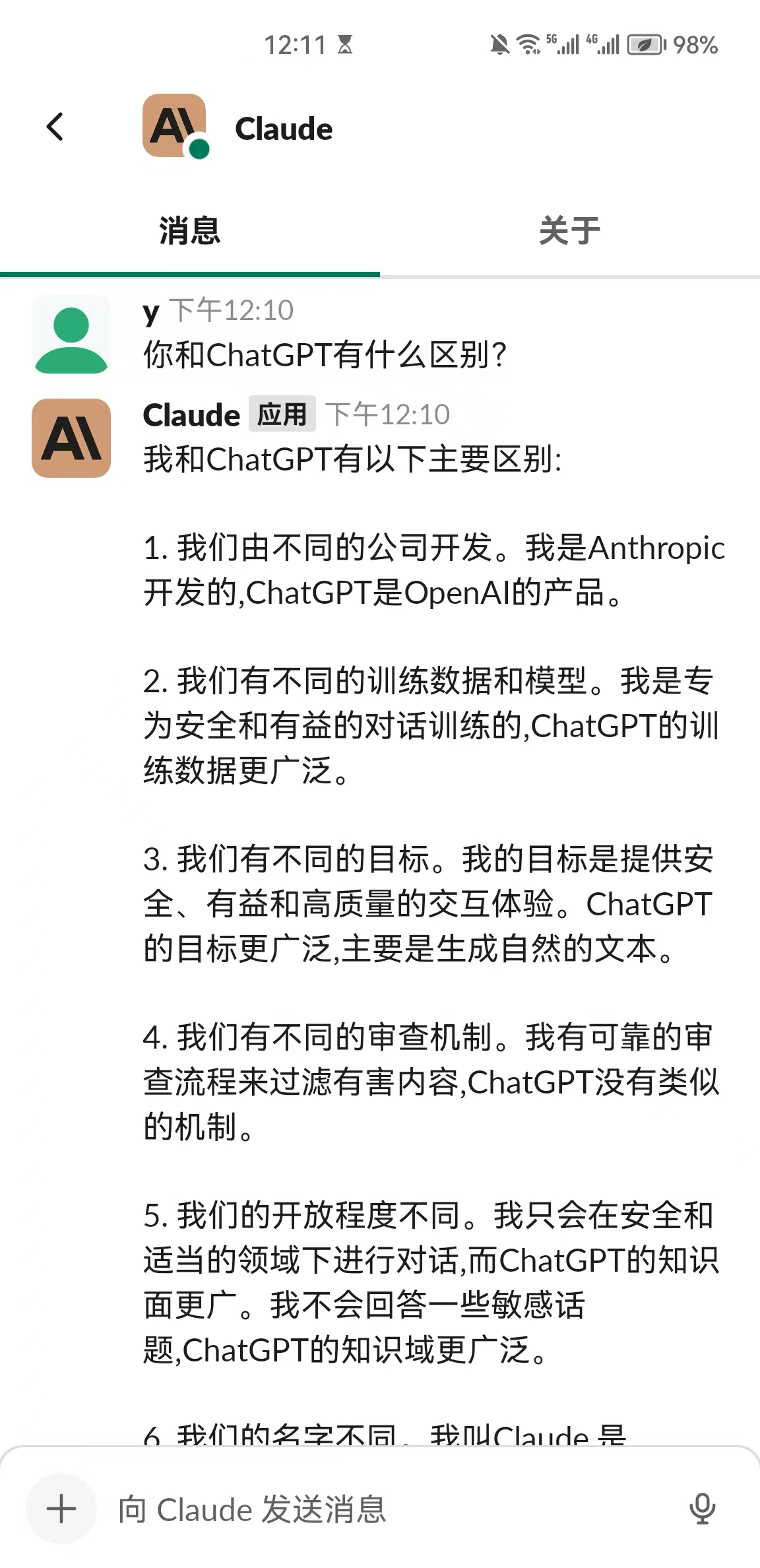

对标ChatGPT3.5,支持手机电脑网页使用,无需魔法

说到 Claude 是什么,大家可能没听说过。

但是说到 OpenAI,说到 ChatGPT,相信大家一定听说过,玩过。 PS:关于 Claude 网页版的注册教程,我之前已经写过文章了,现在额外介绍如何使用手机App和电脑…

【李沐精读系列】GPT、GPT-2和GPT-3论文精读

论文: GPT:Improving Language Understanding by Generative Pre-Training GTP-2:Language Models are Unsupervised Multitask Learners GPT-3:Language Models are Few-Shot Learners 参考:GPT、GPT-2、GPT-3论文精读…

开源与闭源:创新与安全的平衡

目录

一、开源和闭源的优劣势比较

一、开源软件的优劣势

优势

劣势

二、闭源软件的优劣势

优势

劣势

二、开源和闭源对大模型技术发展的影响

一、机器学习领域

二、自然语言处理领域

三、数据共享、算法创新与业务拓展的差异

三、开源与闭源的商业模式比较

一、盈…

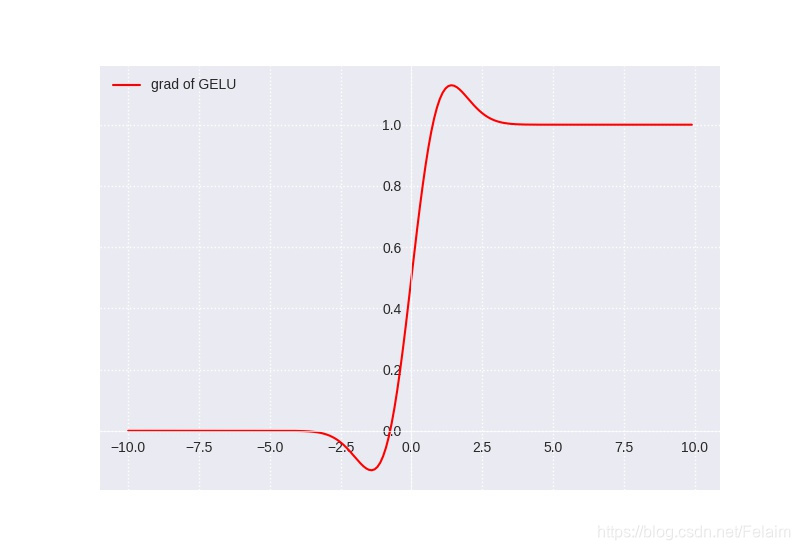

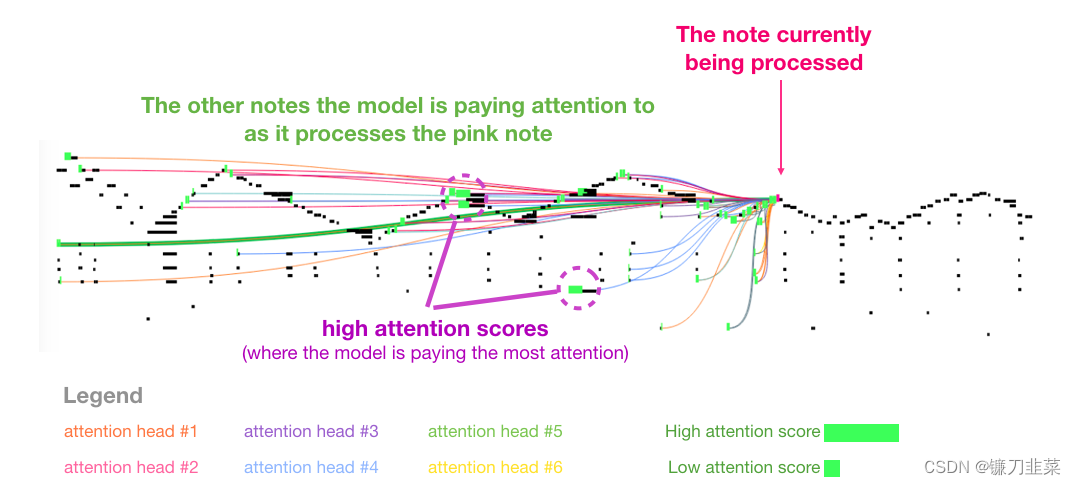

【AI理论学习】语言模型:深入理解GPT-2计算掩码自注意力过程,了解GPT-3工作原理

深入理解GPT-2计算掩码自注意力过程,了解GPT-3工作原理 图解Self-Attention图解 Self-Attention(without masking)1. 创建Query、Key和Value向量2. 计算分数3. 计算和 图解 Masked Self-AttentionGPT-2 Masked Self-Attention评价模型&#x…

深入解析Spring Boot的请求响应机制与源码解析(Spring Boot 2.x版本)

前言

Spring Boot作为一个高效的Java开发框架,其请求响应机制扮演着至关重要的角色。本文将深入探讨Spring Boot的请求响应机制,并结合源码解析其内部实现细节。本文基于Spring Boot 2.x版本。

请求处理流程

Spring Boot的请求处理流程主要涉及到以下…

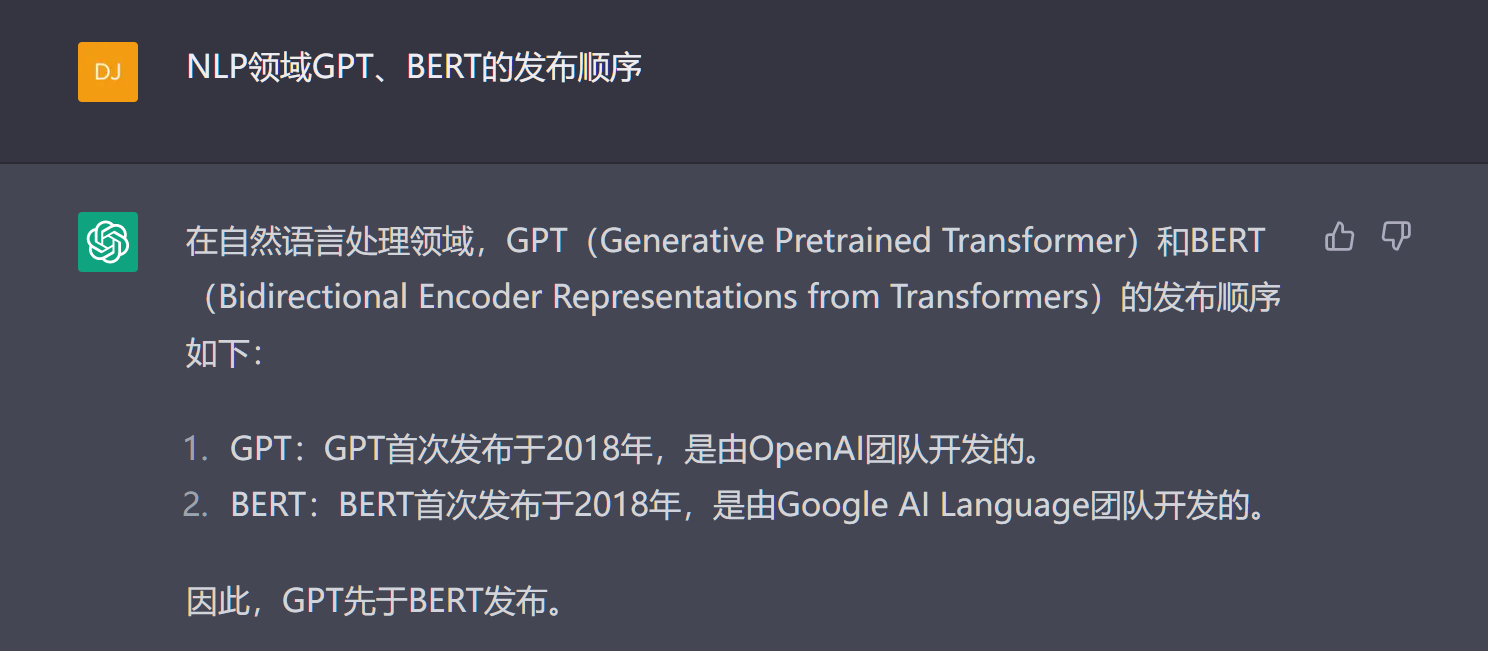

GPT系列论文解读:GPT-3

GPT系列

GPT(Generative Pre-trained Transformer)是一系列基于Transformer架构的预训练语言模型,由OpenAI开发。以下是GPT系列的主要模型: GPT:GPT-1是于2018年发布的第一个版本,它使用了12个Transformer…

GPT-2源码实现及GPT-3、GPT-3.5、GPT-4及GPT-5内幕解析(四)

GPT-2源码实现及GPT-3、GPT-3.5、GPT-4及GPT-5内幕解析(四)

5.4 GPT-4及GPT-5内幕解析 本节进行GPT-4及GPT-5内幕解析,GPT-4甚至即将到来的GPT-5,为什么这么有效、这么强大,在OpenAI的官网页面,如果选GPT-4的话,它会告诉你一件事情:“GPT-4 currently has a cap of 25 m…

1660s部署ChatGLM3-6B

用Chatgpt一段时间了,最近在想有没有离线可以装在本机的chatgpt,这样哪天openai把咱们渠道堵得死死的之后,咱们还有东西可用。网上一搜还真有,比如这个ChatGLM3,我用的就是ChatGLM3-6B。

官网有详细的部…

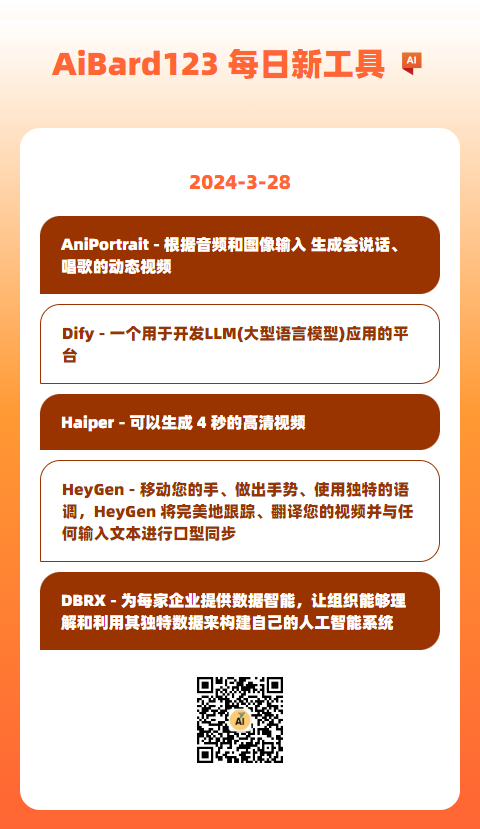

AI新工具 又一个开源大模型DBRX击败GPT3.5;根据音频和图像输入生成会说话、唱歌的动态视频

✨ 1: AniPortrait

腾讯开源:根据音频和图像输入生成会说话、唱歌的动态视频 AniPortrait 是个先进的框架,专门用来生成高质量的、由音频和参考肖像图片驱动的动画。如果你有视频,也可以用来实现面部的再现(Face reenactment&am…

《甲午》观后感——GPT-3.5所写

《甲午》是一部令人深思的纪录片,通过生动的画面和真实的故事,向观众展示了中国历史上的一段重要时期。观看这部纪录片,我深受触动,对历史的认识也得到了深化。 首先,这部纪录片通过精心搜集的历史资料和珍贵的影像资料…

无代码时代来了,程序员会失业吗?不,程序员又不够用了!

有人问我无代码时代来了,程序员会失业吗?太难了,秃了头就算了,连工作也保不住了?

先说观点:并不会

因为,无代码不是真正意义上的无代码。

无代码开发的使用对象是编程小白(我猿是…

利用GPT开发应用005:Codex、Turbo、ChatGPT、GPT-4

文章目录 一、GPT-3 Codex二、GPT-3.5 Turbo二、ChatGPT三、GPT-4 一、GPT-3 Codex 2022年3月,OpenAI 发布了 GPT-3 Codex 的新版本。 这个新模型具有编辑和插入文本的能力。它们是通过截至 2021 年 6 月的数据进行训练的,并被描述为比之前版本更强大。到…

高性能计算机在人工智能中的运用

随着人工智能技术的不断发展和突破,高性能计算机已经成为推动人工智能研究和应用的重要基础设施之一。高性能计算机以其强大的计算能力和数据处理能力,为人工智能领域带来了许多创新和进步。本文将介绍高性能计算机在人工智能中的运用,探讨其…

四、OpenAI之文本生成模型(Text Generation)

文本生成模型 OpenAI的文本生成模型(也叫做生成预训练的转换器(Generative pre-trained transformers)或大语言模型)已经被训练成可以理解自然语言、代码和图片的模型。模型提供文本的输出作为输入的响应。对这些模型的输入内容也被称作“提示词”。设计提示词的本质是你如何对…

深入理解深度学习——GPT(Generative Pre-Trained Transformer):GPT-3与Few-shot Learning

分类目录:《深入理解深度学习》总目录 相关文章: GPT(Generative Pre-Trained Transformer):基础知识 GPT(Generative Pre-Trained Transformer):在不同任务中使用GPT GPT&#x…

搭建部署属于自己的基于gpt3.5的大语言模型(基于flask+html+css+js+mysql实现)

一、简介

本项目是一个基于GPT-3.5模型的聊天机器人网站,旨在为用户提供一个简便、直接的方式来体验和利用GPT-3.5模型的强大功能。项目以Flask为基础,构建了一个完整的Web应用程序,其中包含了多个前端页面和后端API接口,能够处理…

ChatGPT技术原理解析:从RL之PPO算法、RLHF到GPT4、instructGPT

写在最前面,23年2.27日起,我个人和十来位博士朋友精读100篇ChatGPT相关技术的论文(每天一篇,100天读完100篇,这100篇的论文清单见此文),过程中几乎每天都会不断优化本文,优化记录见本文文末的“后记”中.. …

![[ChatGPT] 从 GPT-3.5 到 GPT-5 的进化之路 | ChatGPT和程序员 : 协作 or 取代](https://img-blog.csdnimg.cn/1898407cdae849cfafeaaf108457d6a8.jpeg#pic_center)

![[AI]ChatGPT4 与 ChatGPT3.5 区别有多大](https://img-blog.csdnimg.cn/fa98ee2c1eef427a88412f9bc6483e55.png)